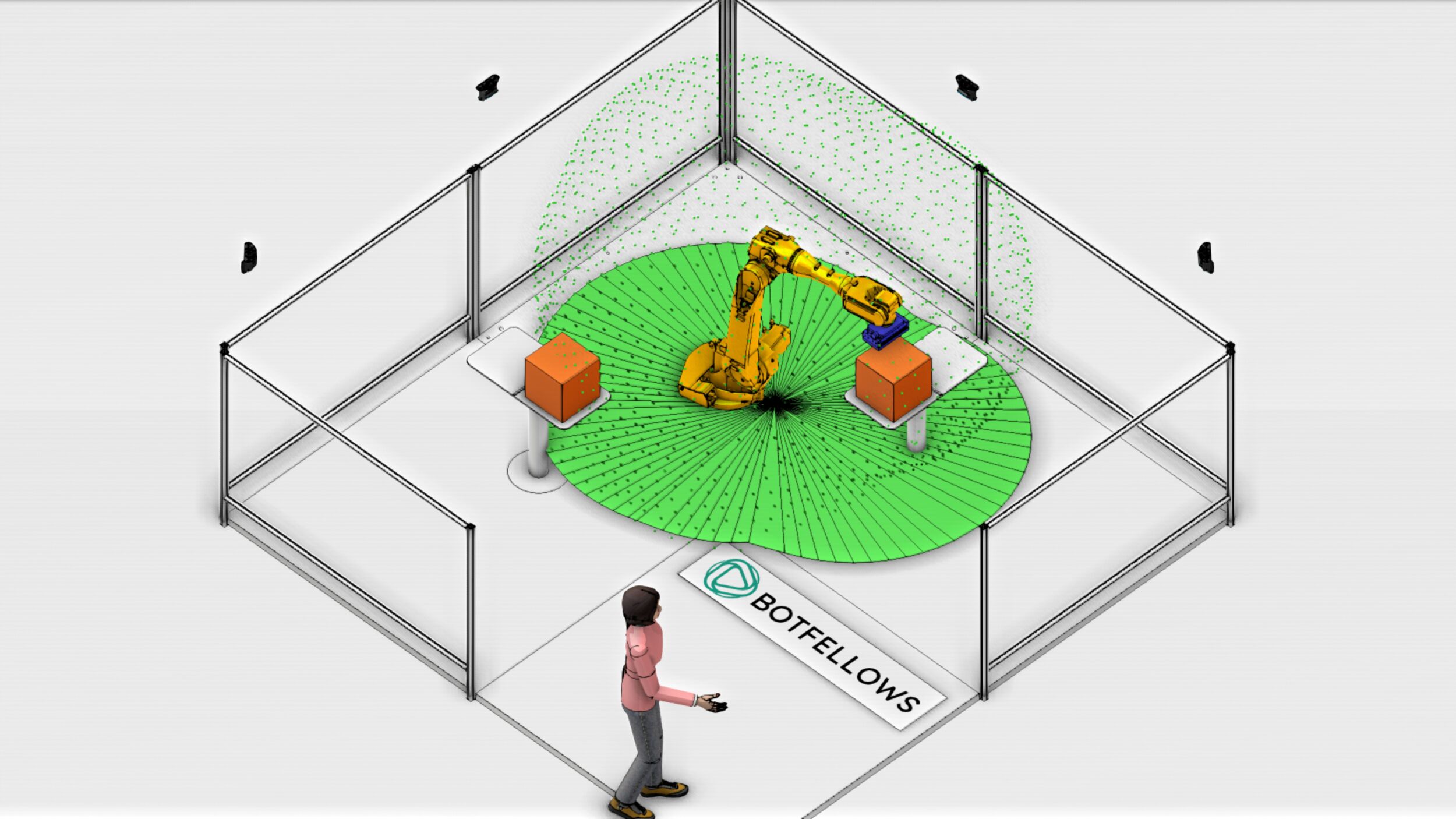

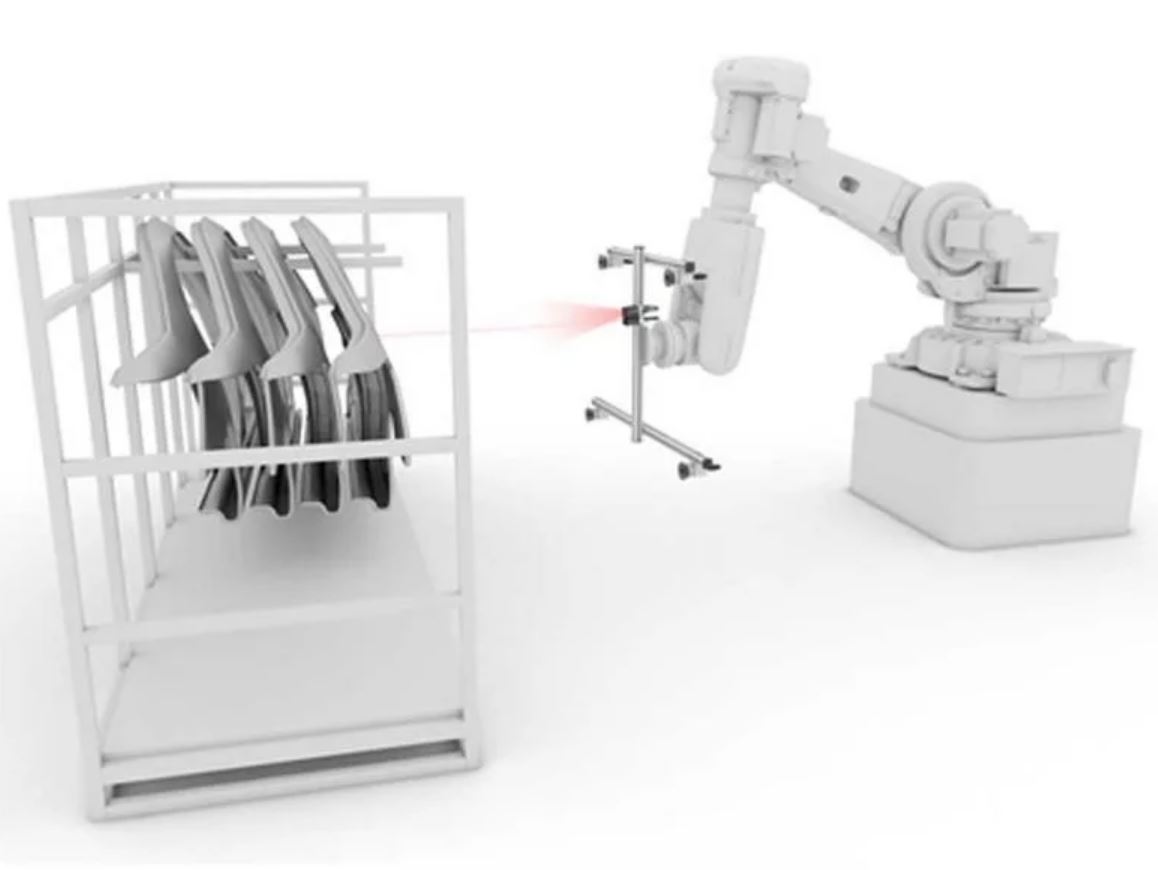

Die zentrale Fragestellung für das Team vom Fraunhofer IWU um Aquib Rashid, Ibrahim Al Naser und Mohamad Bdiwi in einem Anwendungsfall bei Seat war: Wie kann ein Roboter mithilfe zusätzlicher Augen seine Umgebung besser einschätzen und damit mehr Geschwindigkeit in seiner Bahn behalten? Dazu teilte das Team die Wahrnehmungsbereiche in smarte Zonen ein. Bei schnelleren Bewegungen wächst eine solche Zone, um ein Kollisionsrisiko mit Menschen auszuschließen. Für die Umfelderfassung kommt dabei Lidar-Sensorik, die über gepulstes Laserlicht Objekte erkennt und kategorisiert, ebenfalls zum Einsatz wie Kameras. Die Kombination von Reaktionszeiten (Lidar: 50ms, Kamera: 10ms) und Überwachungsbereichen erlaubt nun schnellere Bewegungen des Roboters. Um welchen Faktor genau sich die Prozesszeiten verkürzen lassen, hängt jeweils von der Tätigkeit und von der eingesetzten Hardware für Robotik und Lidar-Sensorik ab.

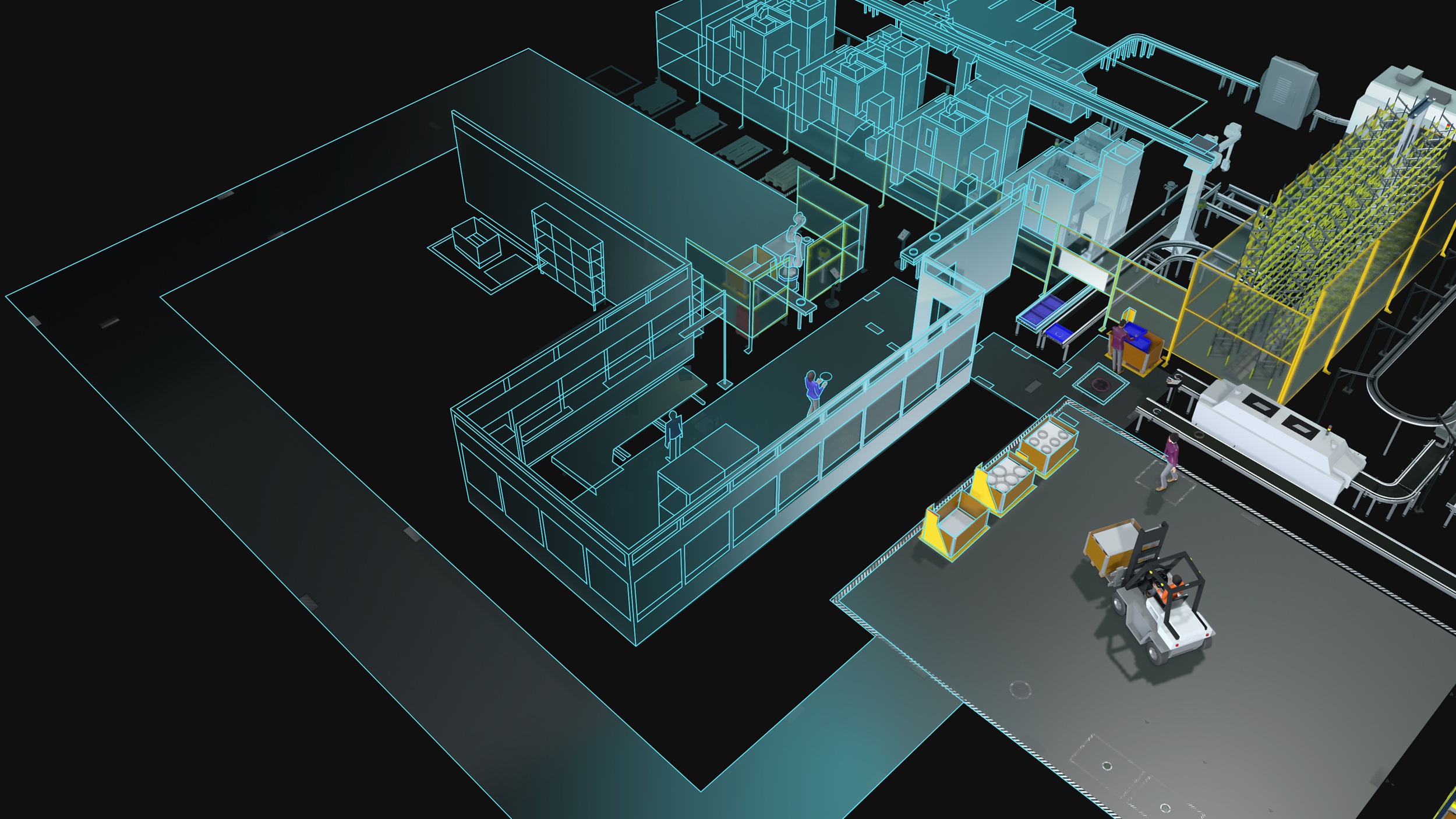

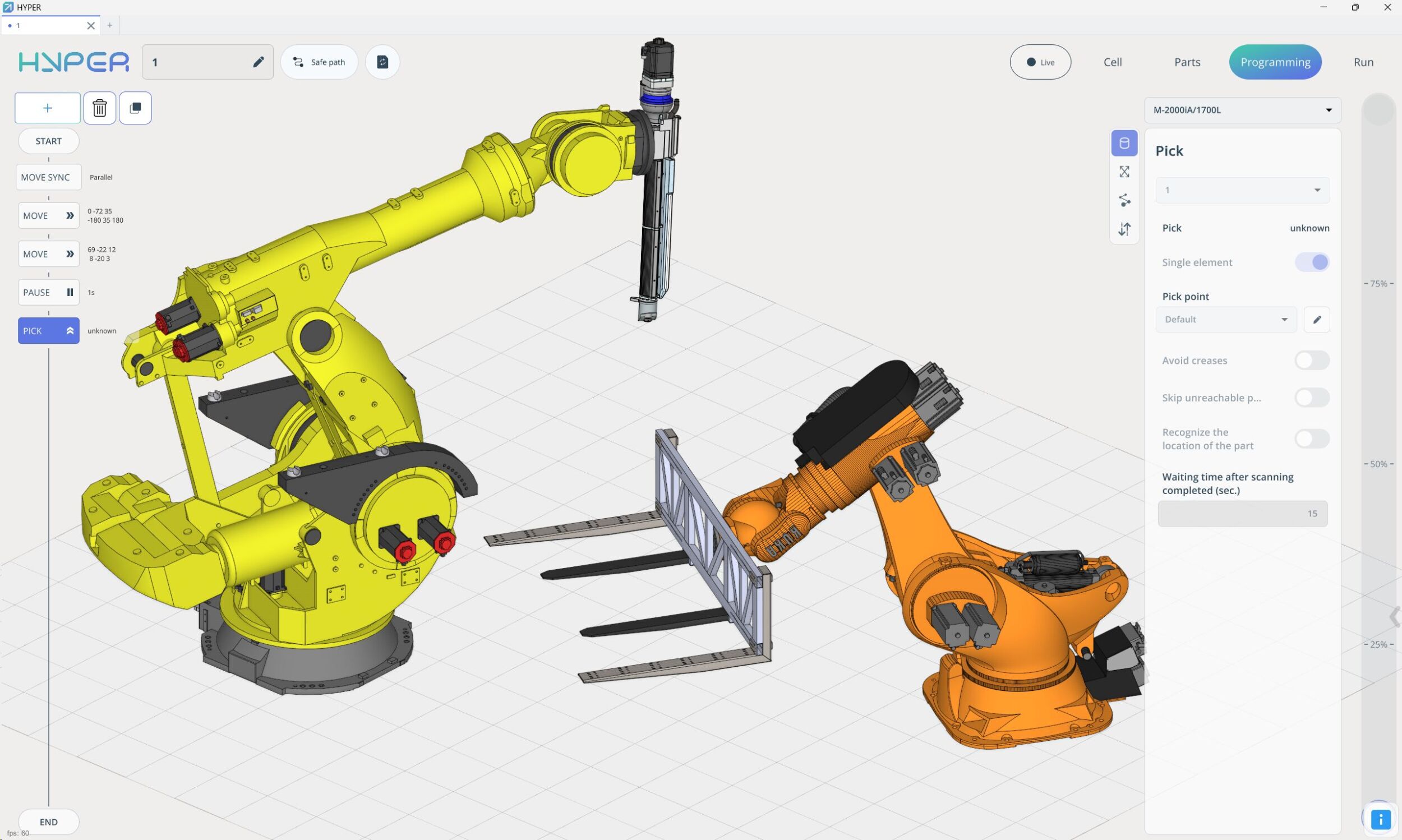

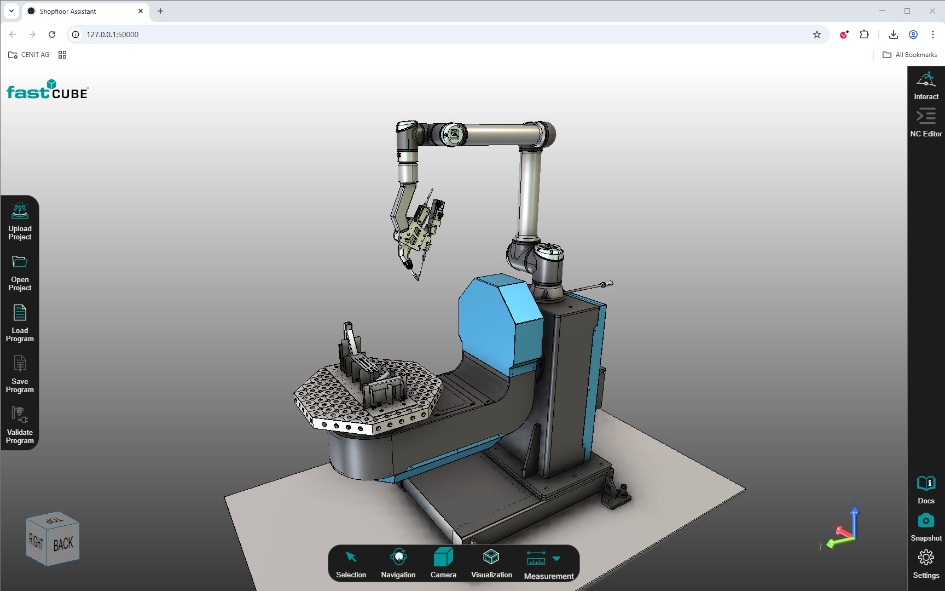

Teil des Softwarepakets ist auch ein Baustein für die Beurteilung aller Sicherheitsaspekte. Diese können so frühzeitig in der Anlagenplanung berücksichtigt, technisch dokumentiert und digital zertifiziert werden. Damit stehen im digitalen Abbild der Anlage alle relevanten Daten für spätere Änderungen zur Verfügung. Automatisierte Fertigungsanlagen stellen höchste Anforderungen an Sicherheit, Taktleistung und Integration. Erfahren Sie in diesem Whitepaper, wie Maschinenschutztore normgerecht geplant und effizient in automatisierte Anlagen integriert werden. ‣ weiterlesen

Whitepaper

Maschinenschutztore in Anlagen integrieren

Sichere und effektive Mensch/Roboter-Kollaboration

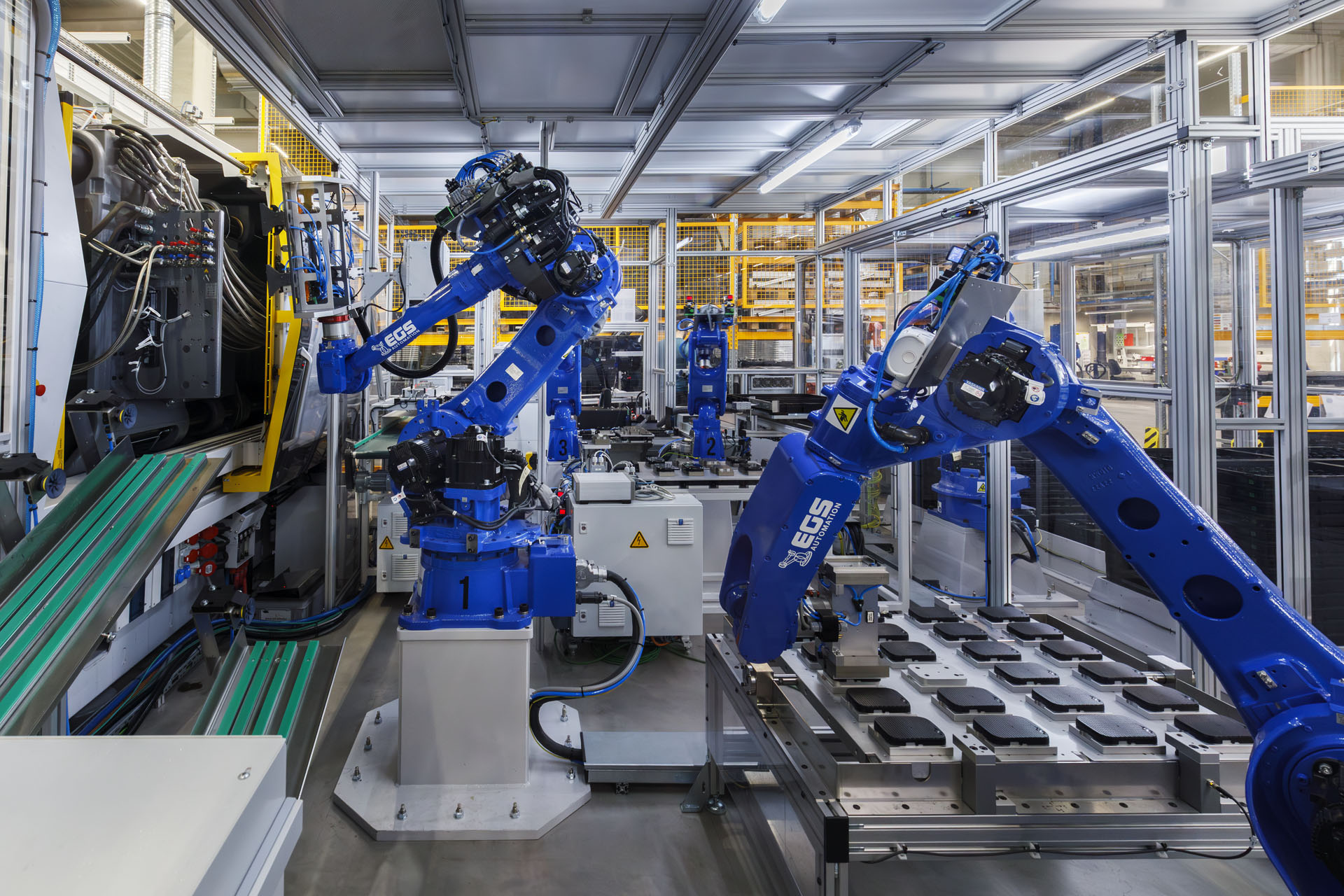

Diese Forschungsergebnisse sind Teil des EU-Projekts Sharework. Darin entwickelte ein europäisches Konsortium aus sechs Forschungseinrichtungen, 13 Firmen und einer Normierungsinstanz neue Lösungen für die Zusammenarbeit von Mensch und Roboter. Die verschiedenen Software- und Hardwaremodule ermöglichen insbesondere auch Schwerlastrobotern, mit Menschen zu interagieren, ohne dass physische Schutzbarrieren, wie Zäune, erforderlich sind. Ziel war es, im Sinne einer effektiveren Zusammenarbeit vorhandene Barrieren in der MRK zu überwinden.

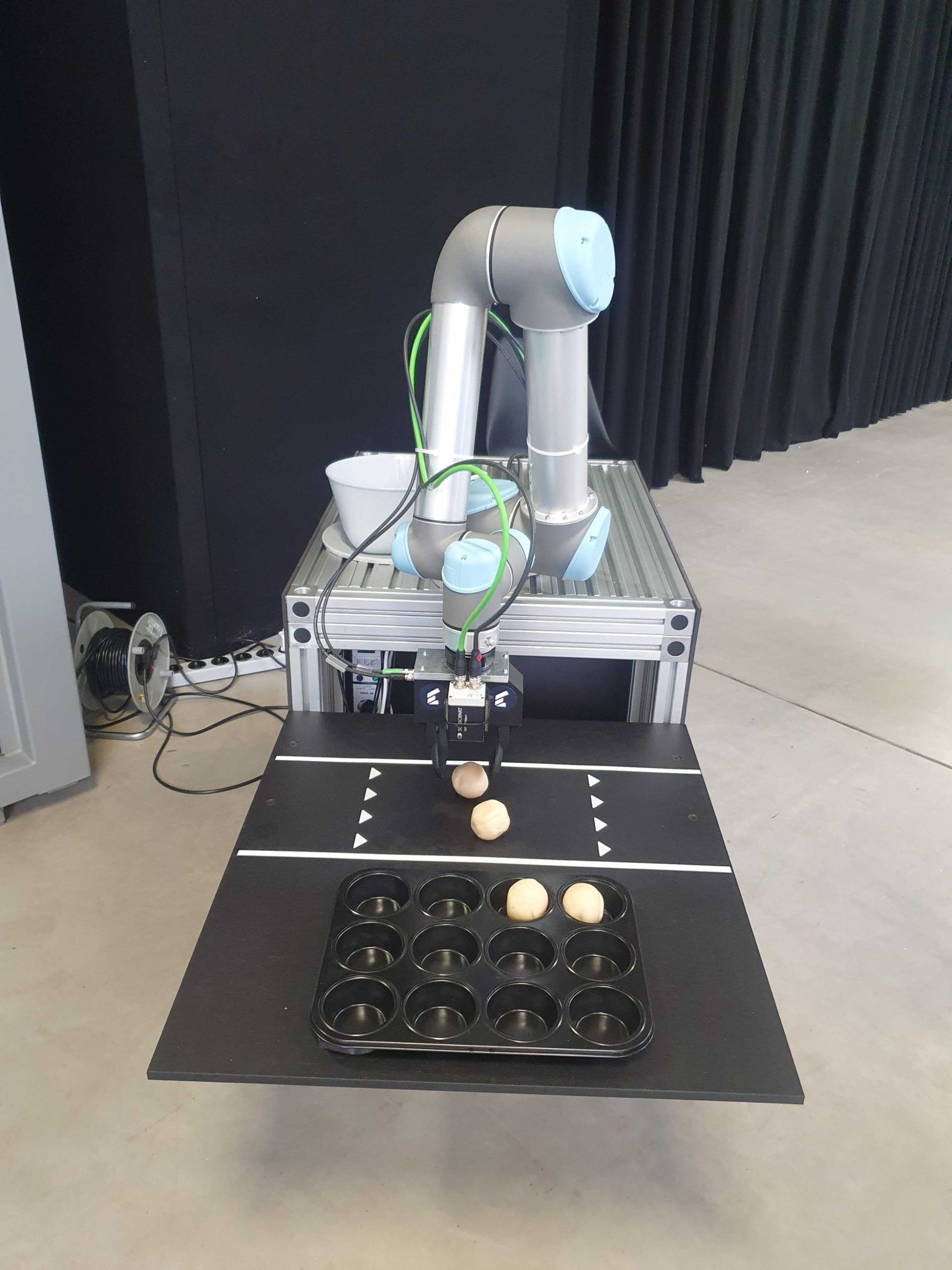

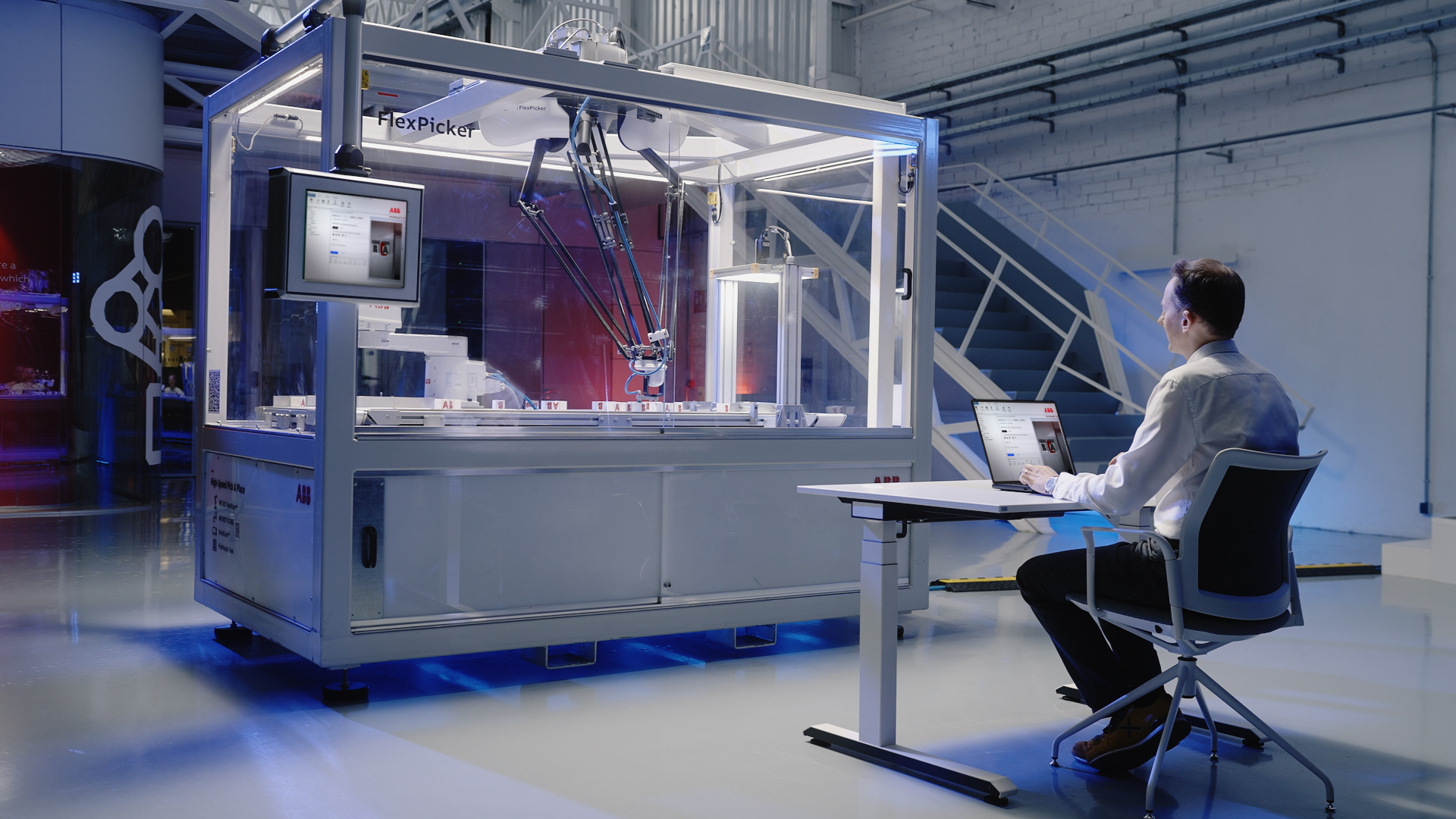

Das Ergebnis: ein modulares System, das in der Lage ist, die Umgebung eines Roboters und menschliche Handlungen durch Wissen und Sensoren, Vorhersagen über zukünftige Zustände, intelligente Datenverarbeitung, Augmented Reality sowie Gesten- und Spracherkennung zu verstehen.