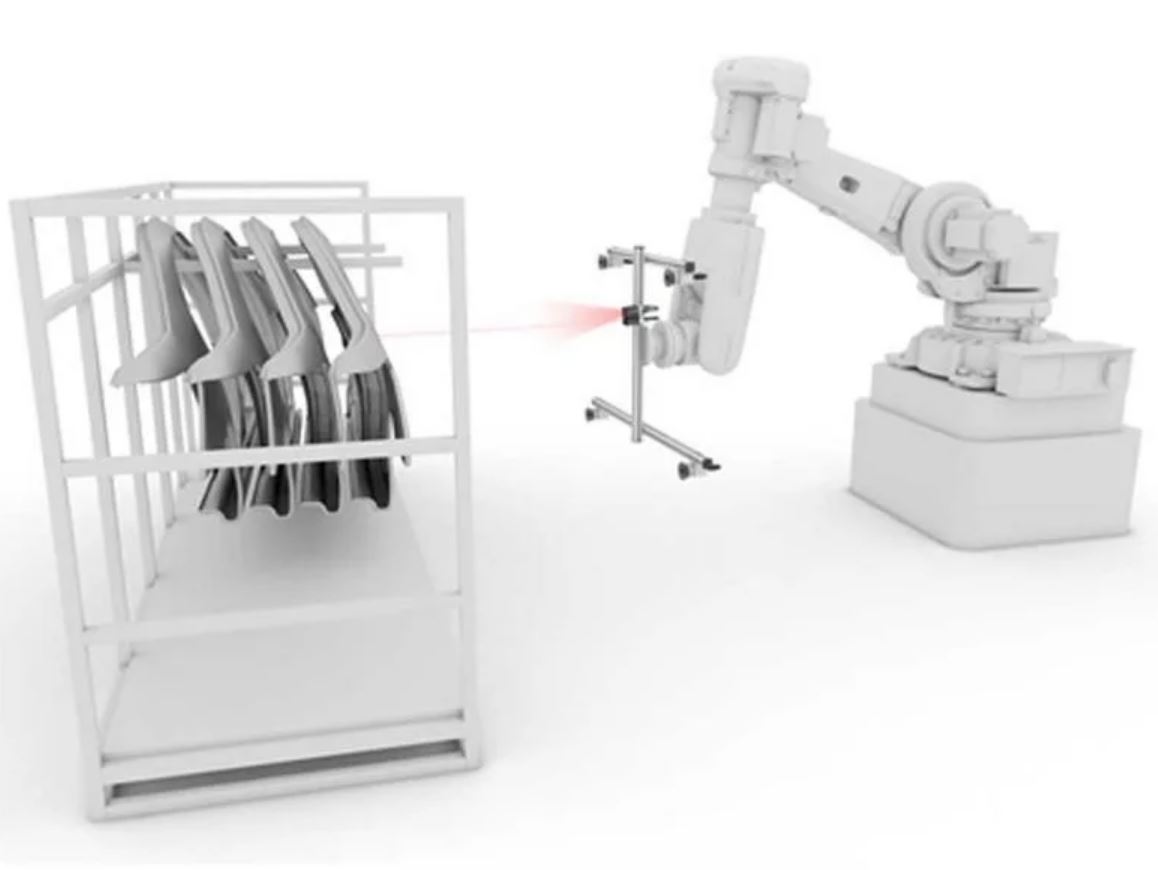

3D-Vision-Sensor mit Snap in Motion

Bilder aus der Bewegung

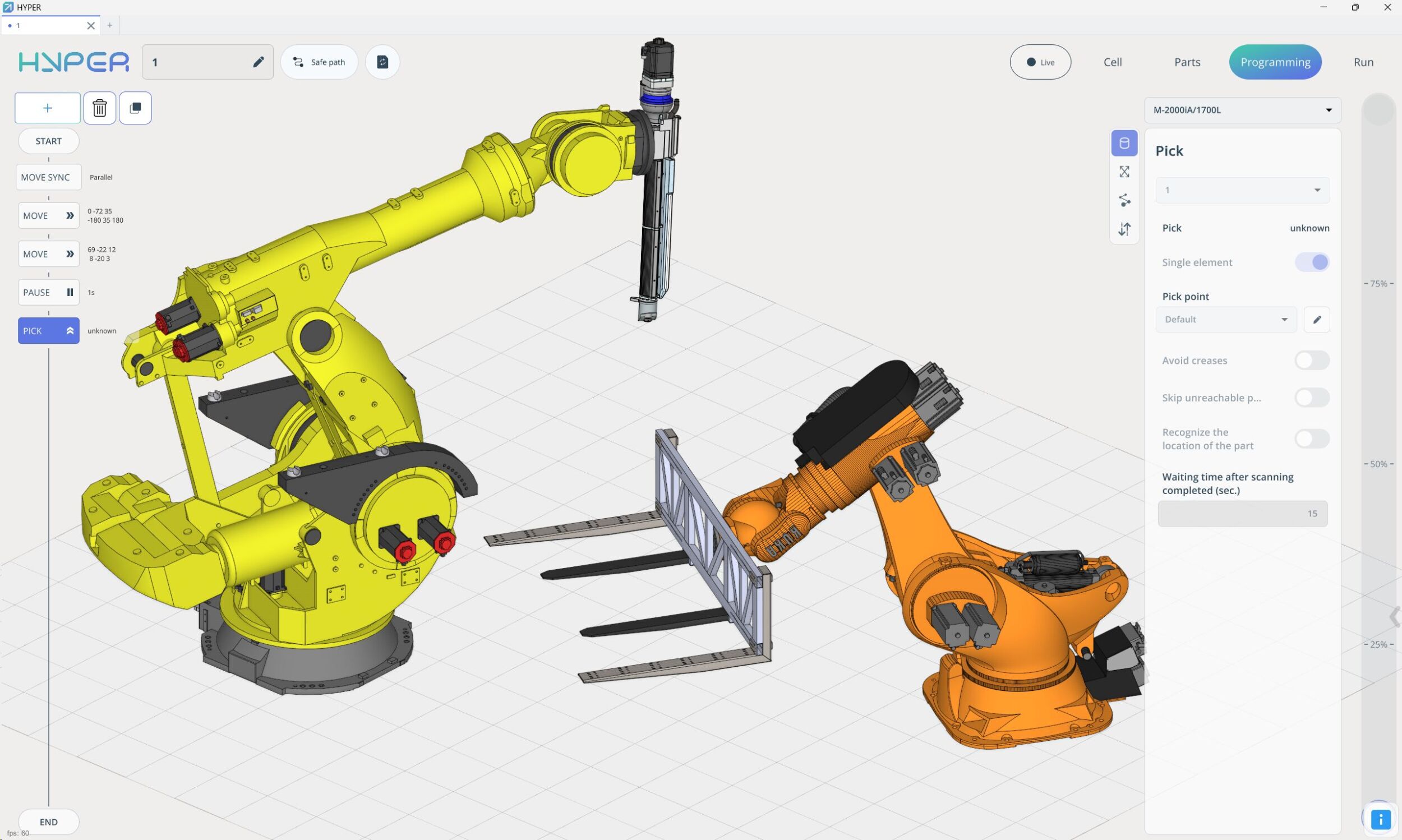

Mit dem neuen 3D-Vision-Sensor von Fanuc lassen sich Aufnahmen während der Bewegung eines Roboters erstellen, die zur Bestimmung der Greifposition dienen. Diese Snap-in-Motion-Funktion spart bei schnellen Greifvorgängen Zeit, weil der Roboter für eine Aufnahme seine Bewegung nicht unterbrechen muss.

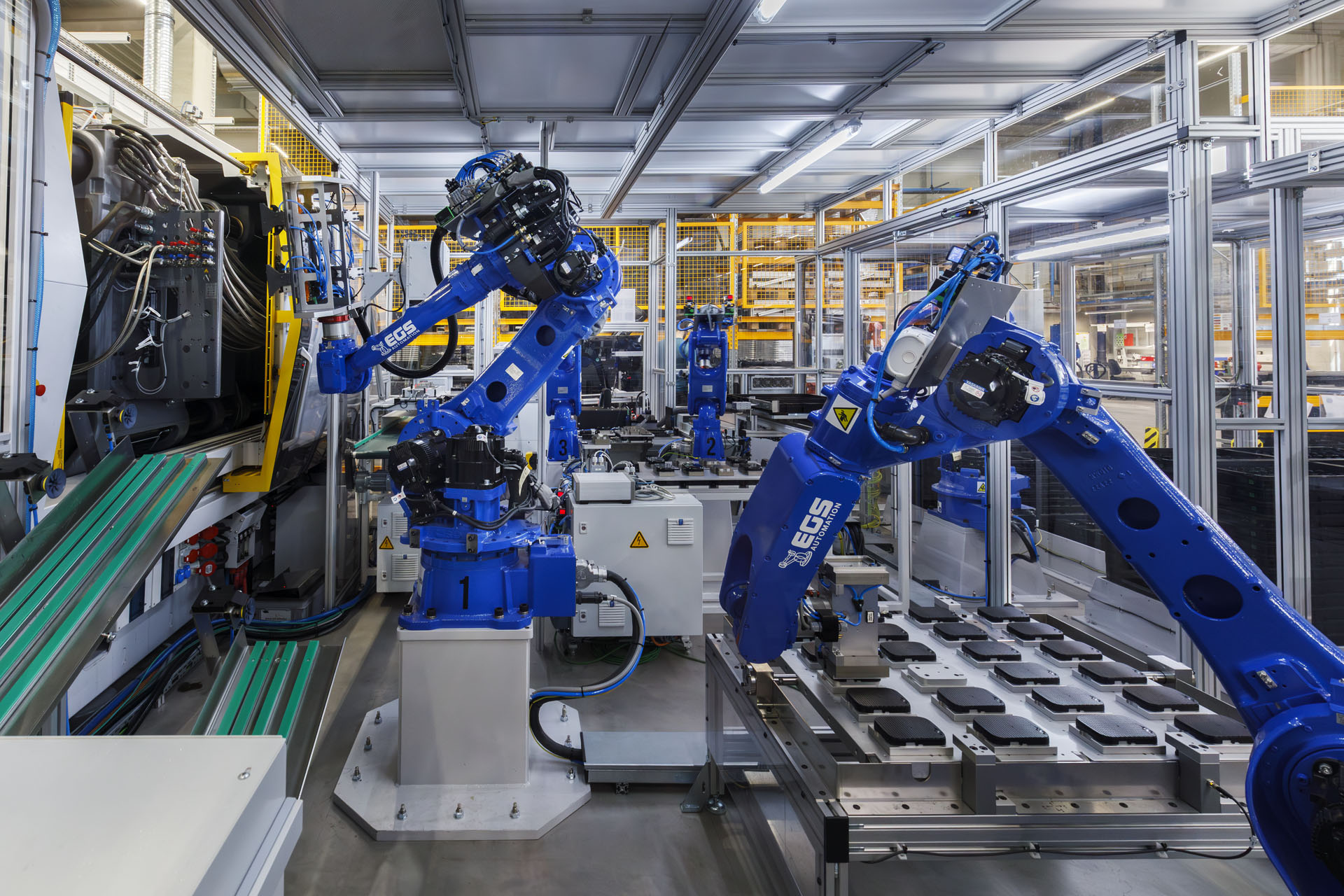

Der 3D-Vision-Sensor 3DV/400 von Fanuc arbeitet in einem Sichtfeld bis etwa 450x530mm mit einer Auflösung von 950×1204 Pixel. Michael Keller, Applikationsingenieur im Technical Center bei Fanuc Deutschland in Neuhausen dazu: „Die Robotersteuerung R-30iB Plus bringt sowohl von der Leistung als auch von den Speichermöglichkeiten gute Voraussetzungen für den Betrieb des 3D-Vision-Sensors mit.“ Der 3D-Vision-Sensor erzeugt eine Punktewolke. Die Bildinformationen der beiden zueinander geneigten Kameras im Gehäuse des Sensors werden direkt an die CPU des Roboter-Controllers geschickt und dort ausgewertet. Unter idealen Bedingungen dauert das ca. 100ms, unter widrigen Bedingungen, wenn Aufnahmen mit unterschiedlichen Belichtungszeiten erforderlich sind, bis 300ms. Automatisierte Fertigungsanlagen stellen höchste Anforderungen an Sicherheit, Taktleistung und Integration. Erfahren Sie in diesem Whitepaper, wie Maschinenschutztore normgerecht geplant und effizient in automatisierte Anlagen integriert werden. ‣ weiterlesen

Whitepaper

Maschinenschutztore in Anlagen integrieren

Snap in Motion

Der Sensor ist in der Lage, während der Roboterbewegung Bilder aufzunehmen (Snap in Motion) – ein Vorteil gegenüber statischen Systemen. Der Zeitpunkt der Aufnahme wird getriggert, das Bild erstellt und in der Steuerung die Positionsdaten errechnet. Keller: „So bekommen wir auch während der Bewegung des Roboters eine exakte Positionsbestimmung.“ Der Vorteil dieser Aufnahmetechnik liegt im Zeitgewinn. Der Roboter muss während der Aufnahme nicht mehr stoppen.

Schnelle Synchronisierung

Da Sensor und Roboter mit einer Steuerung arbeiten, läuft die Synchronisierung sehr schnell, was eine Folge der hohen Integration der einzelnen Komponenten ist. Im Prinzip kehrt Fanuc damit eine Technik um, die bereits von der Softwareoption iRPickTool bekannt ist und sich in zahlreichen Pick-Applikationen bewährt hat. Beim 3D-Vision-Sensor bewegt sich der Roboter und das zu erfassende Werkstück liegt still. Beim Einsatz des Tools bewegt sich ein Förderband mit den zu greifenden Werkstücken und die Roboter/Kamera-Einheit ist fest montiert. Die Einkabellösung hat für Anwender den Vorteil, nicht mit unterschiedlichen Kabeln oder Steckern arbeiten zu müssen. Über das Coax-Kabel wird gleichzeitig zur Bildübertragung die Spannungsversorgung sichergestellt. Selbst bei der Variante mit zusätzlicher LED-Beleuchtung ist kein zusätzliches Kabel erforderlich. Zudem ist so die Lagerhaltung einfacher. Michael Keller: „Es gibt nur ein Standardkabel und eine einheitliche Belegung der Stecker.“