Vision-Sensoren für Handling-Roboter

Eingespieltes Team

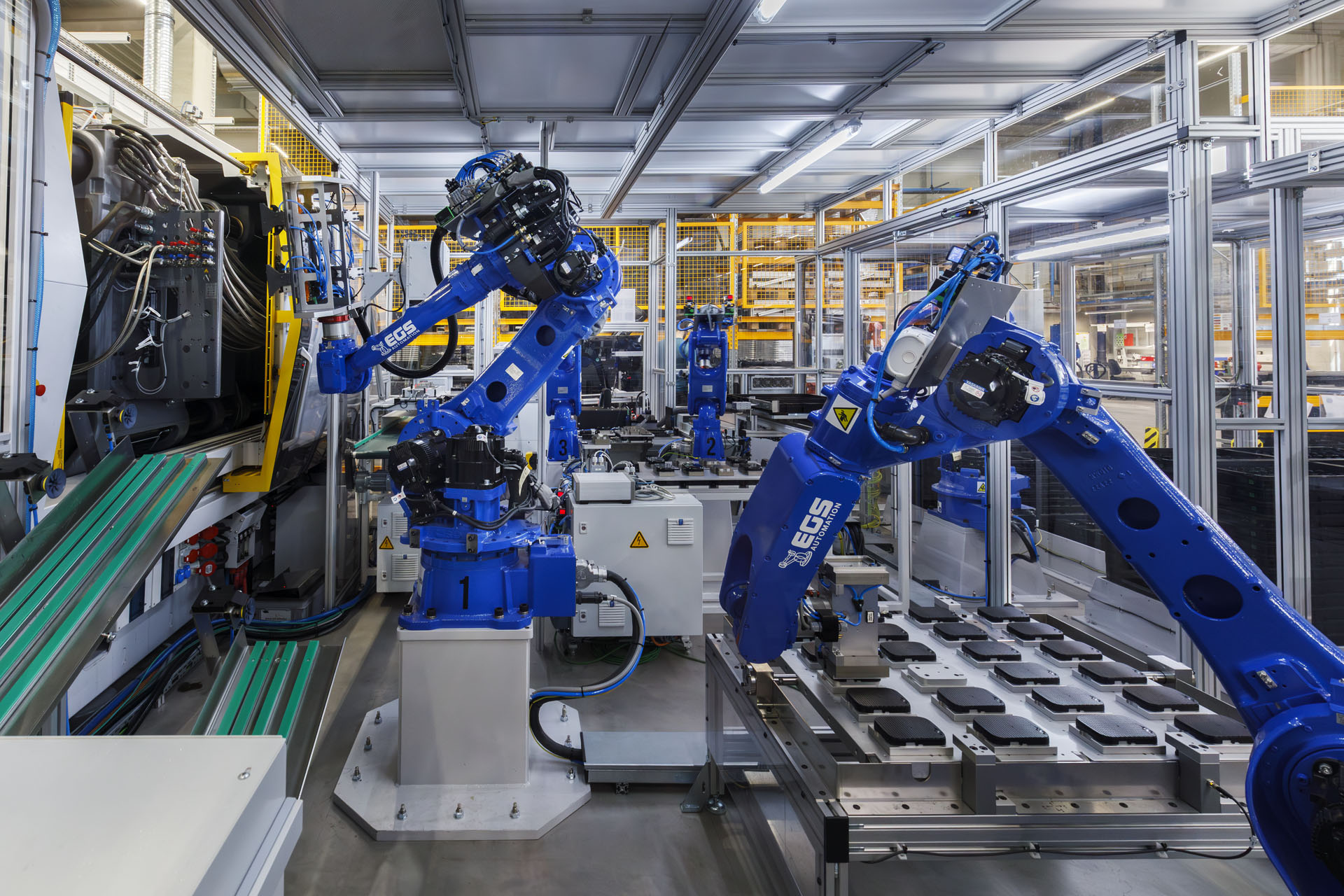

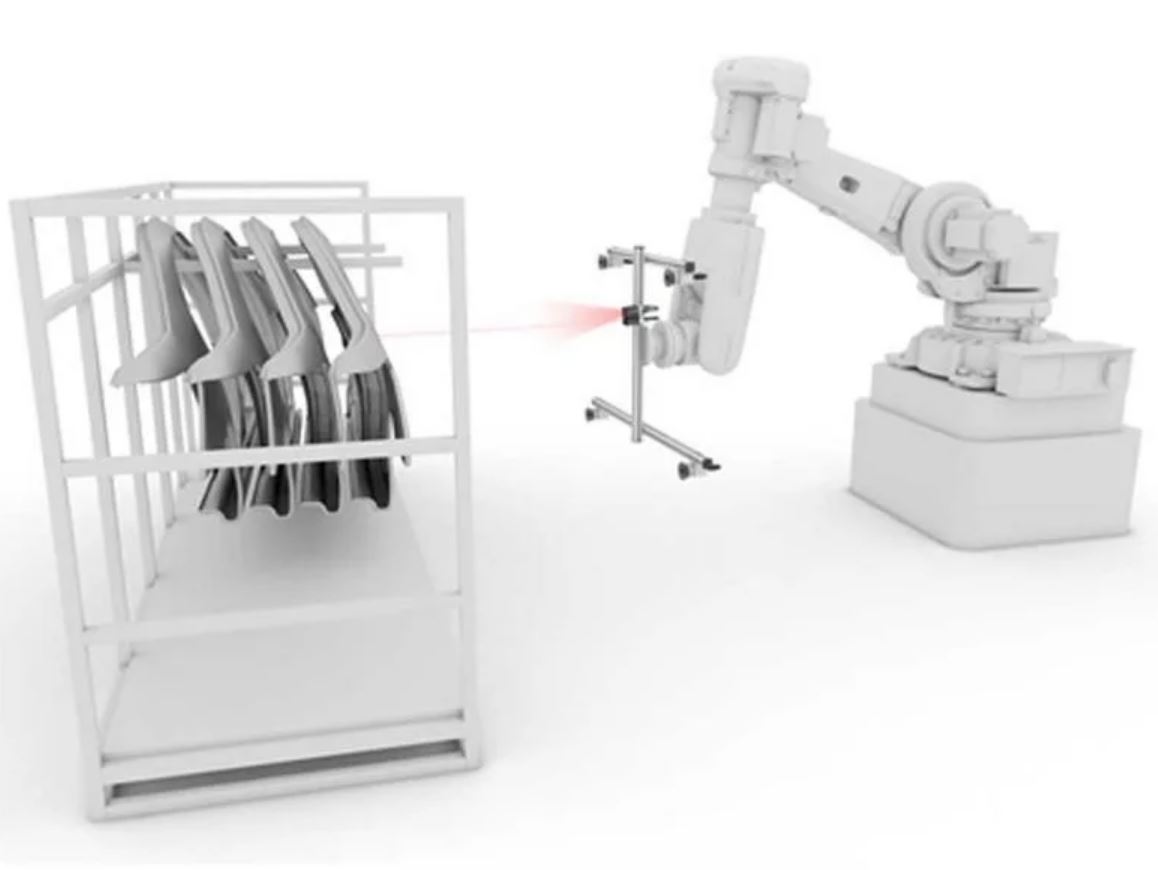

Ohne Roboter ist die Automatisierung in vielen Industriebranchen nicht mehr vorstellbar. Vision-Sensoren agieren dabei oft als Augen des Roboters und liefern ihm alle benötigten Informationen über die Teilepositionen, bereits umgerechnet in dessen eigenes Koordinatensystem, sodass der Roboter nur noch zugreifen muss. Spezielle Funktionen wie Greiferfreiraumprüfung und Greifpunktoffset ermöglichen zusätzliche Flexibilität bei der Automatisierung von Handling-Aufgaben.

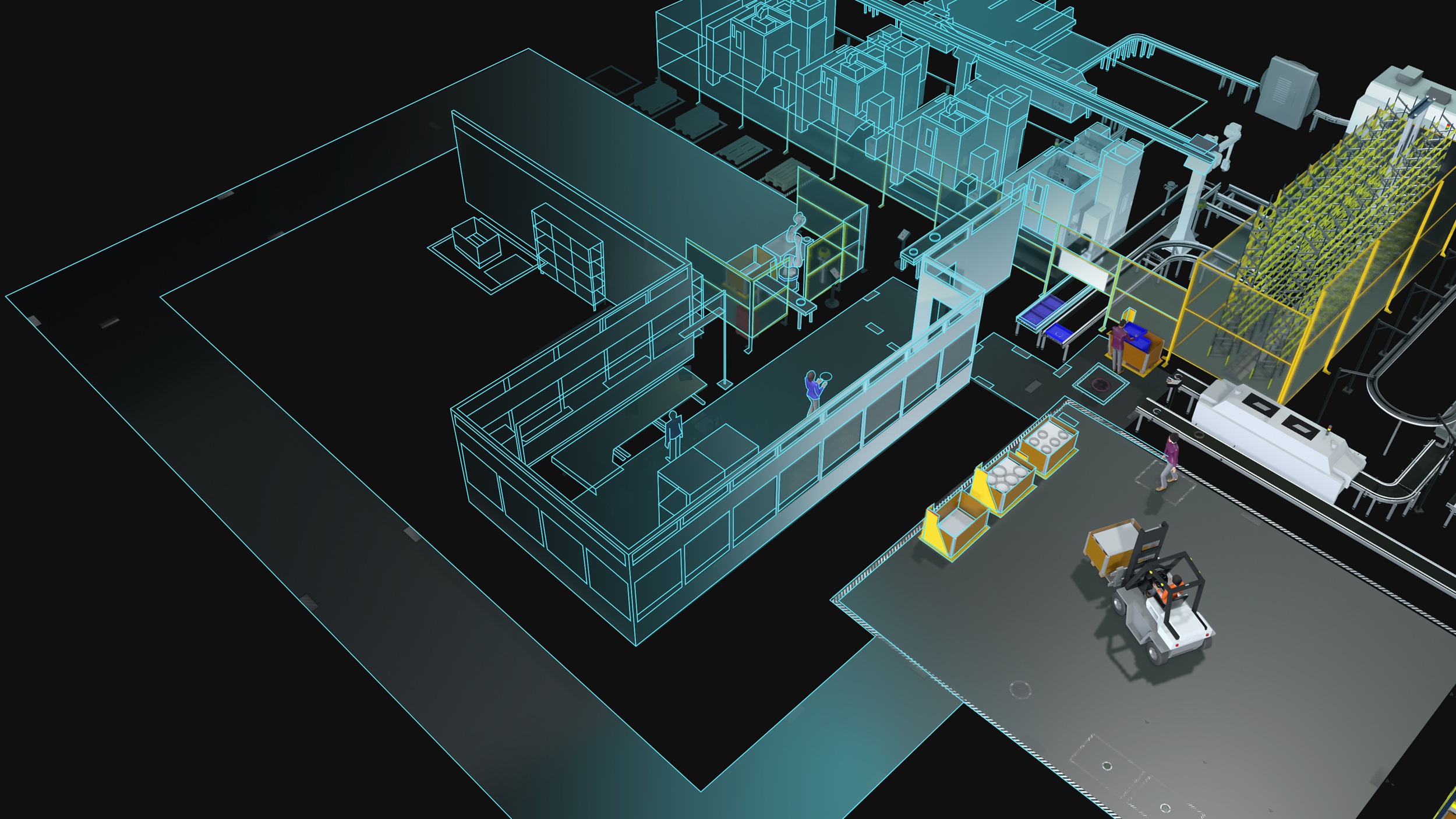

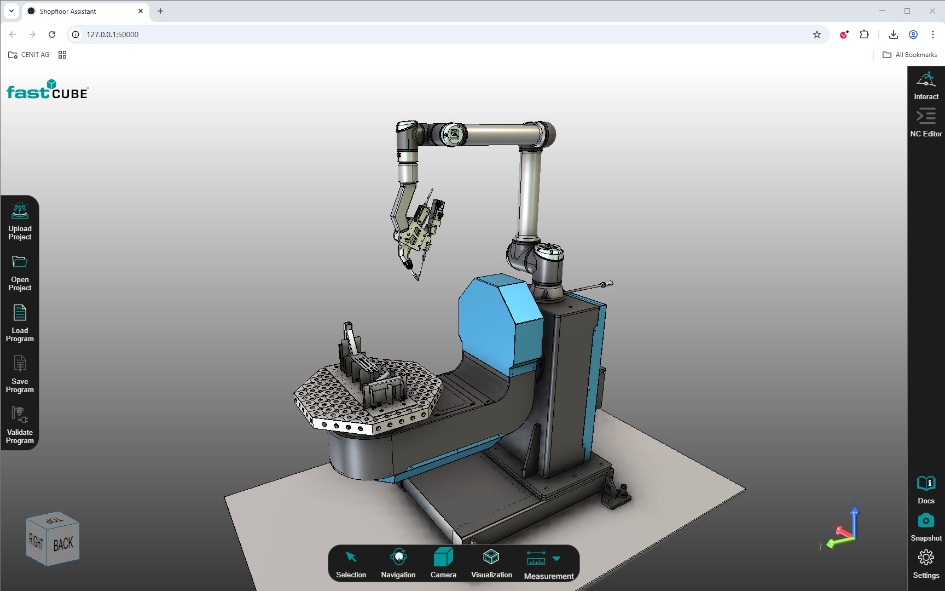

Sensopart beschäftigt sich schon lange mit dem Thema Industrielle Bildverarbeitung – erste Visionsensoren wurden bereits im Jahr 2005 in den Markt eingeführt. Heute sind die bildverarbeitenden Sensoren längst ein zentraler Baustein in der Fabrikautomation und Robotik geworden. Der Hauptvorteil von Visionsensoren besteht neben ihrer kompakten Bauform und dem guten Preis/Leistungsverhältnis auch bei wachsendem Funktionsumfang nach wie vor in der einfachen Bedienbarkeit. Ein Beispiel hierfür ist die Kalibrierfunktion der Baureihe Visor: Positionen und Abstände im Sensorbild lassen sich mit dieser Funktion einfach in Roboterkoordinaten umwandeln. Gleichzeitig werden perspektivische Verzerrungen durch schräge Blickwinkel oder Linsenverzeichnungen korrigiert. Bisher musste diese Umrechung erst mühsam in der Robotersteuerung programmiert werden; dieser Aufwand für den Anwender entfällt nun, die Kamera liefert alle Positionen direkt im gewünschten Koordinatensystem. Automatisierte Fertigungsanlagen stellen höchste Anforderungen an Sicherheit, Taktleistung und Integration. Erfahren Sie in diesem Whitepaper, wie Maschinenschutztore normgerecht geplant und effizient in automatisierte Anlagen integriert werden. ‣ weiterlesen

Whitepaper

Maschinenschutztore in Anlagen integrieren

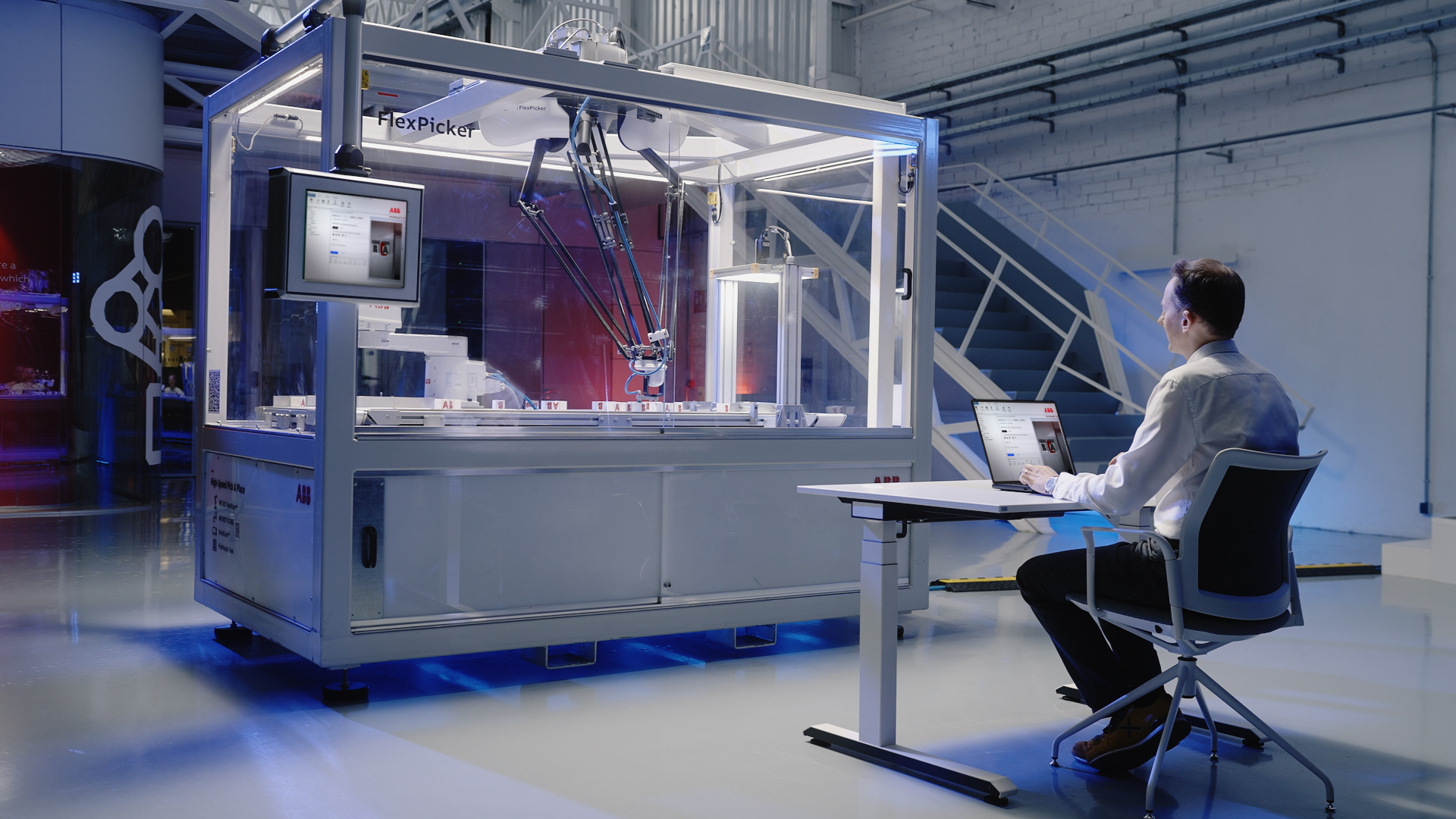

Kamerageführte Robotersysteme

Unterschiedlich geformte Teile lassen sich mit einem solchen System erfassen, ohne dass es erforderlich ist, Aufnahmen oder Greifer zu verändern. Ähnliches gilt für Transportbehälter und Förderbänder, die nicht mehr an bestimmte Teile und Baugruppen angepasst werden müssen. Der mechanische Anpassungsaufwand entfällt und verschiebt sich in die Software. Da der Sensorhersteller die entsprechende Programmierarbeit bereits erledigt hat, genügen dem Anwender ein paar Mausklicks, um seine Anwendung startklar zu machen. Jede Teileform wird im Visionsensor einmal eingelernt, anschließend gilt es nur noch, den passenden Job im Sensor aufzurufen. Was gerade transportiert wird und wie das aussieht, teilt der Sensor dem Roboter mit, sodass er jedes Teil richtig greifen kann. Das Sensor-Roboter-Team sorgt so für geringere Engineeringkosten und mehr Flexibilität bei Produktwechseln. Das Sensorauge ermöglicht es dem Roboter, auch komplexe Pick&Place-Aufgabenstellungen zu lösen. Mit einer leicht konfigurierbaren Freiraumprüfung rund um das aufzunehmende Teil lässt sich sicherstellen, dass genügend Platz für den Greifer vorhanden ist. Eine Greifpunktverschiebung ist ebenfalls möglich: Hier erhält der Roboter z.B. die Botschaft, das Teil nicht mittig, sondern seitlich zu greifen. Zusätzliche Funktionen des Visionsensors wie Codelesen oder Klarschrifterkennung (OCR) ermöglichen gleichzeitig ein Tracking der Teile auf ihrem Produktionsweg.

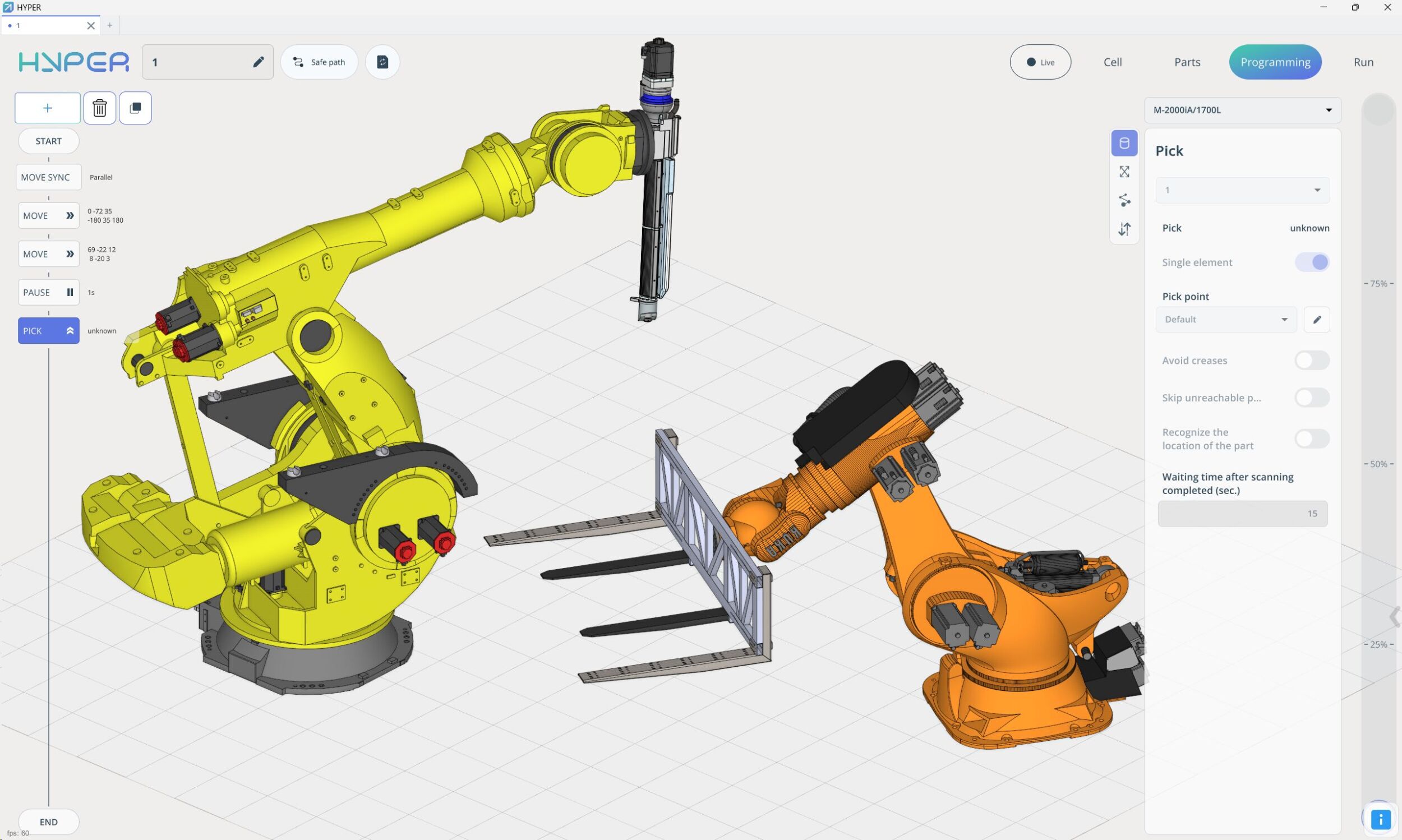

Einfacheres Einlernen per Konturerkennung

Um Teilepositionen einfach zu erfassen, gibt es verschiedene Möglichkeiten. So hat der Nutzer die Möglichkeit, eine Konturlagenachführung zu definieren, indem er das zu erkennende Teil im Livebild mit der Maus markiert. Dabei lassen sich bei Bedarf auch die bereits beschriebenen Optionen ‚Greiferfreiraumprüfung‘ oder ‚Greifpunktoffset‘ nutzen. Sie senden dem Roboter die Teileposition und sorgen dafür, dass sich zusätzlich weitere Prüfungen ausführen lassen. So lässt sich ein Code lesen, eine Markierung oder die lagerichtige Zuführung erfassen. Mit der aktuell erscheinenden Funktionserweiterung bietet der Sensor außerdem weitere Möglichkeiten zur Positionserkennung. Hierzu dient jetzt auch der Konturdetektor selbst. Er bietet die Möglichkeit, bis zu 200 Objektinstanzen in einem Bild zu erkennen. Dies ist z.B. für schnelle Handlingprozesse mit einem Sauggreifer von Nutzen.