Roboter lernt Hand/Auge-Koordination

Greifen lernen im neuronalen Netz

Ein zweimonatiges Experiment von Google Research hat es gezeigt: Aufgrund künstlicher neuronaler Netzwerke sind Roboter schon heute in der Lage, selbstständig zu lernen. 14 Roboterarme zeigten nach 800.000 Greifvorgängen erste Anzeichen für intelligentes, vorausschauendes Handeln.

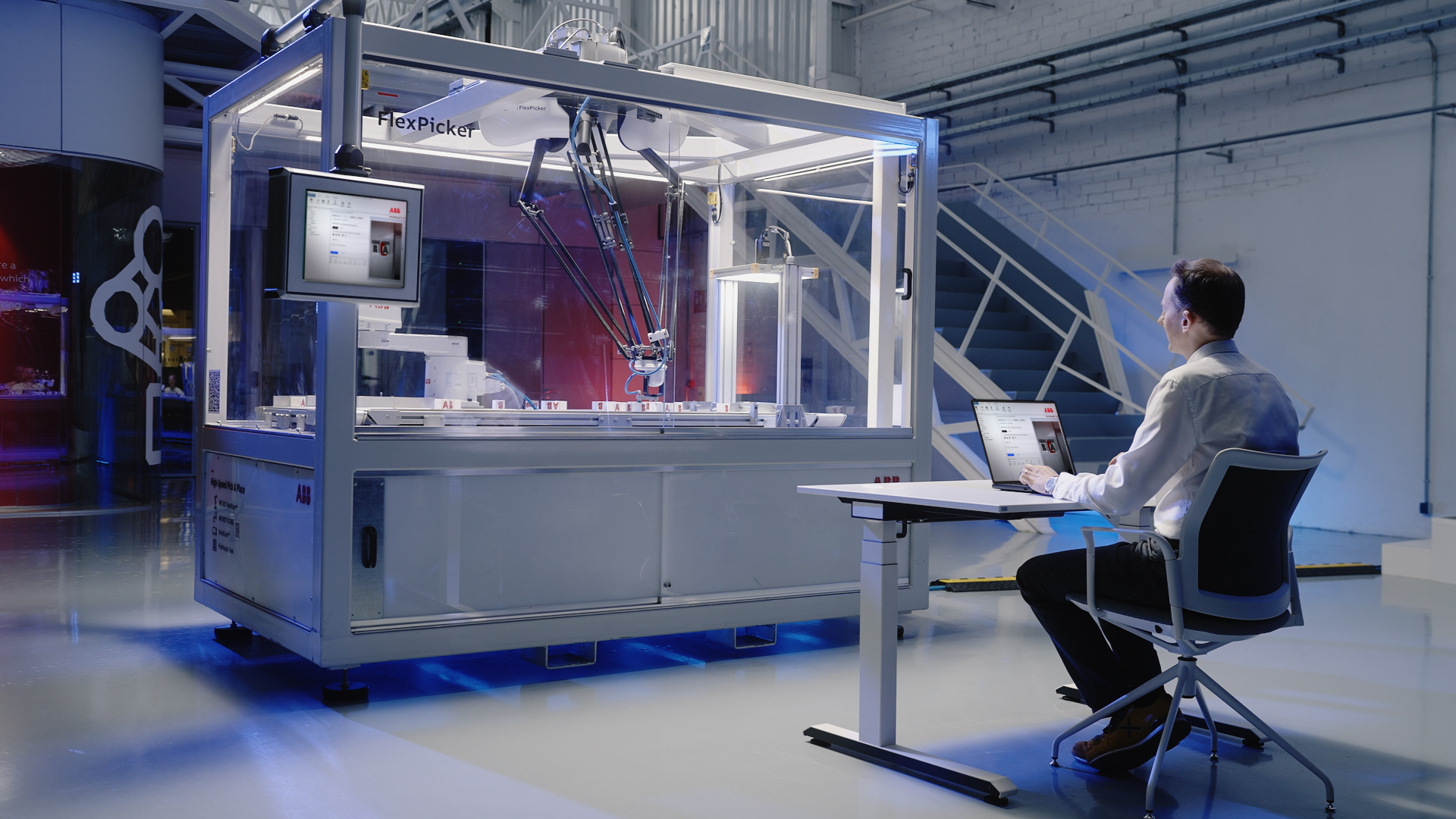

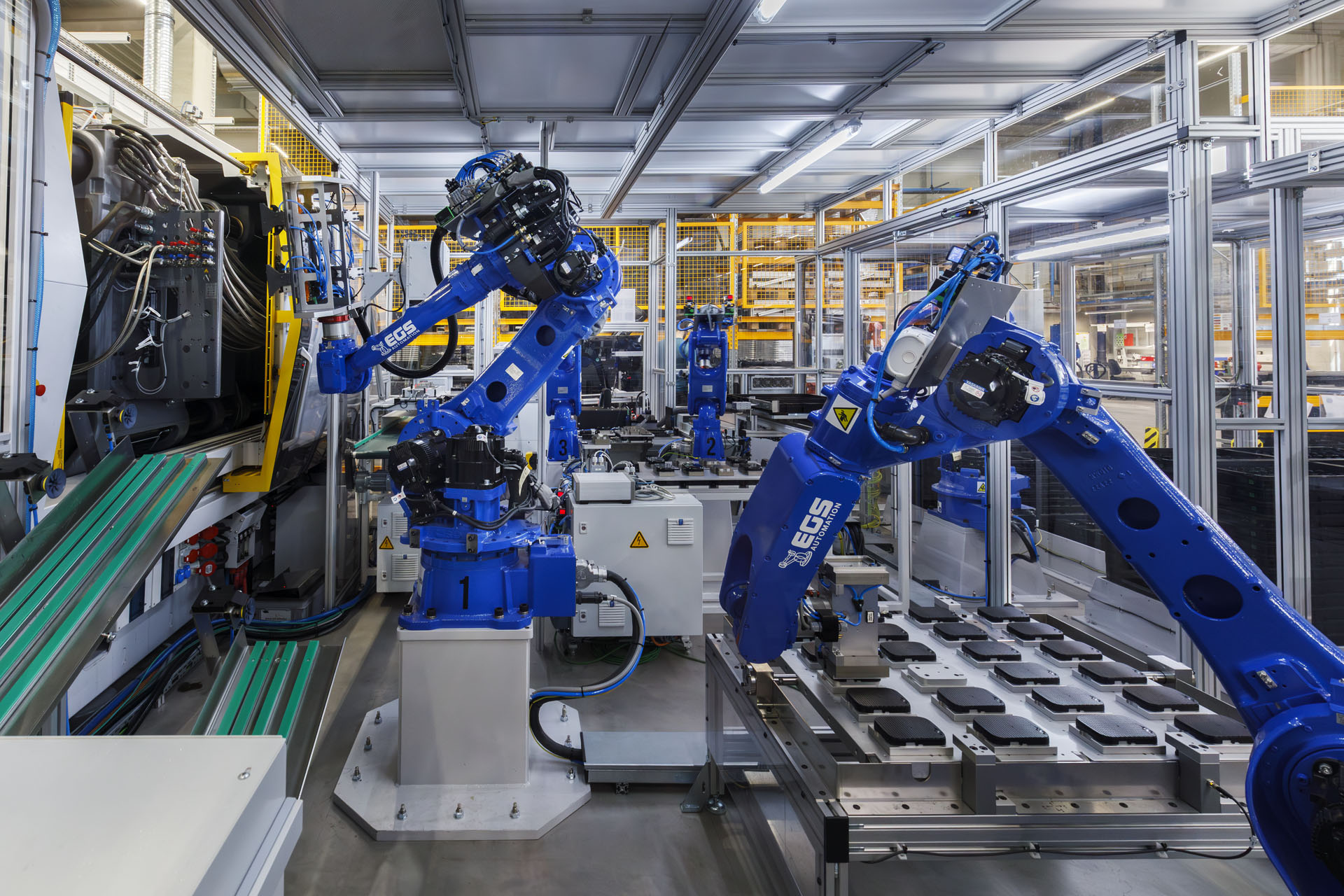

Noch immer klafft eine große Lücke zwischen den Fähigkeiten des Menschen und den Fähigkeiten heutiger Roboter, selbst wenn es um vermeintlich einfache Dinge wie das Greifen geht. Ein Kleinkind greift bereits nach wenigen Monaten gezielt nach Gegenständen und hat den Greifvorgang nach vier Jahren weitestgehend perfektioniert. Auch Roboter sollen jetzt (eigenständig) besser greifen lernen: In einem Experiment von Google Research ließen die Verantwortlichen 14 Roboterarme, ausgestattet mit Zweifingergreifern und einer monokularen RGB-Kamera, zwei Monate lang chaotisch angeordnete Gegenstände aus einem Behälter greifen. Bei den Gegenständen handelte es sich um Haushalts- und Büroartikel, wie Quietscheentchen, Plastikbecher, Tacker oder Bleistifte. Die Roboter waren dabei über ein künstliches neuronales Netzwerk miteinander verbunden und führten die Greifvorgänge parallel aus. Automatisierte Fertigungsanlagen stellen höchste Anforderungen an Sicherheit, Taktleistung und Integration. Erfahren Sie in diesem Whitepaper, wie Maschinenschutztore normgerecht geplant und effizient in automatisierte Anlagen integriert werden. ‣ weiterlesen

Whitepaper

Maschinenschutztore in Anlagen integrieren

Überwachung der Greifvorgänge

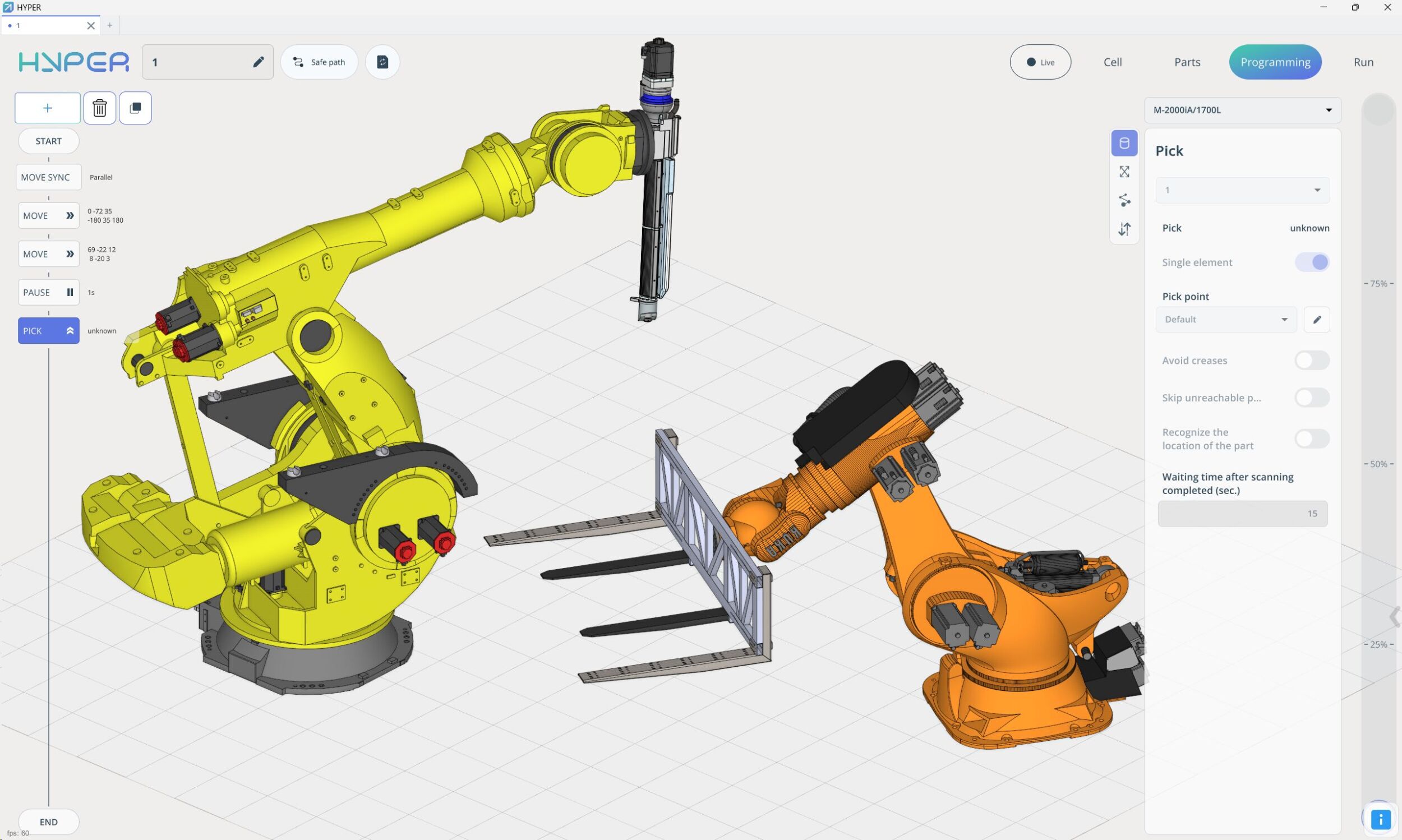

Anfangs führten die Roboter die Greifvorgänge völlig beliebig aus, nur wenige waren erfolgreich. Doch dann ließen die Google-Mitarbeiter die Ergebnisse der Greifvorgänge in das neuronale Netz einfließen. Die Analyse aus Kamerabild und Greifbewegung wurde in den Inner Loop der Servosteuerung eingespeist. Daraufhin justierten die Roboter ihre Bewegungen in Echtzeit und vergrößerten so die Chance auf einen erfolgreichen Greifvorgang. Durch die eigene Überwachung ihrer Greifvorgänge lernten die Roboter nach und nach, diese immer weiter zu verbessern, und entwickelten eine eigene Hand/Auge-Koordination.

Vorausschauendes Verhalten

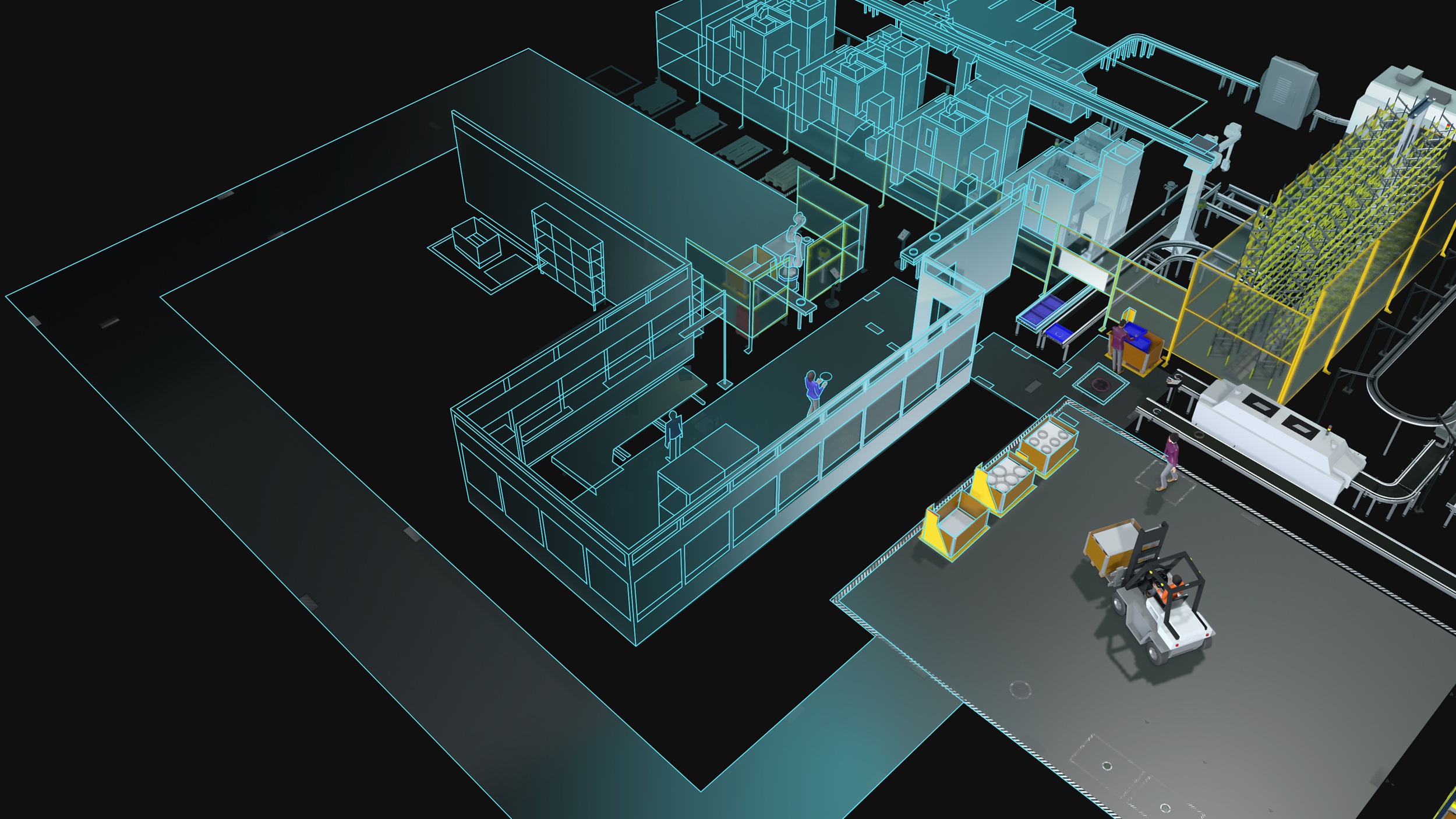

Nach 800.000 Greifvorgängen und 3.000 Roboterstunden kamen erste Anzeichen von intelligentem, vorausschauendem Handeln zum Vorschein. So zeigten die Roboter interessante Verhaltensweisen noch vor dem eigentlichen Greifvorgang. Sie schoben beispielsweise einen Gegenstand erst zur Seite, um einen anderen besser greifen zu können, oder änderten die Position eines Gegenstandes. Die Fehlerrate bei den Greifvorgängen sank daraufhin auf 18 Prozent. Vergleichbare Open-Loop-Anordnungen verfügen dagegen über eine Fehlerrate von 34 Prozent. Das Experiment von Google Research bedeutet somit einen ersten Schritt in die Richtung von Robotersystemen, die die Auswirkung ihres Handelns selbst verstehen können. Diese Form des Large-Scale Mashine Learning wird möglicherweise die Entwicklung im Bereich Robotik und Automation weiter voranbringen und den Weg für neue Roboterapplikationen ebnen. (fiz)