Smarte 3D-Robot-Vision

Reibungslose Systemintegration

Bei der Integration von Robotern in Produktionslinien muss nicht nur der Produktionsfluss neu geplant werden, sondern auch die effektive Zusammenarbeit von Robotern und 3D-Sensoren muss gut durchdacht sein, um so eine schnelle und effiziente Produktion zu erreichen. Ein Vorteil von 3D-Smart-Sensoren gegenüber herkömmlichen Sensoren ist die direkte Kommunikation mit dem Roboter. Außerdem kann die Kinematik mit smarter 3D-Sichtführung dynamische Bewegungen basierend auf den Sensorinformationen ausführen.

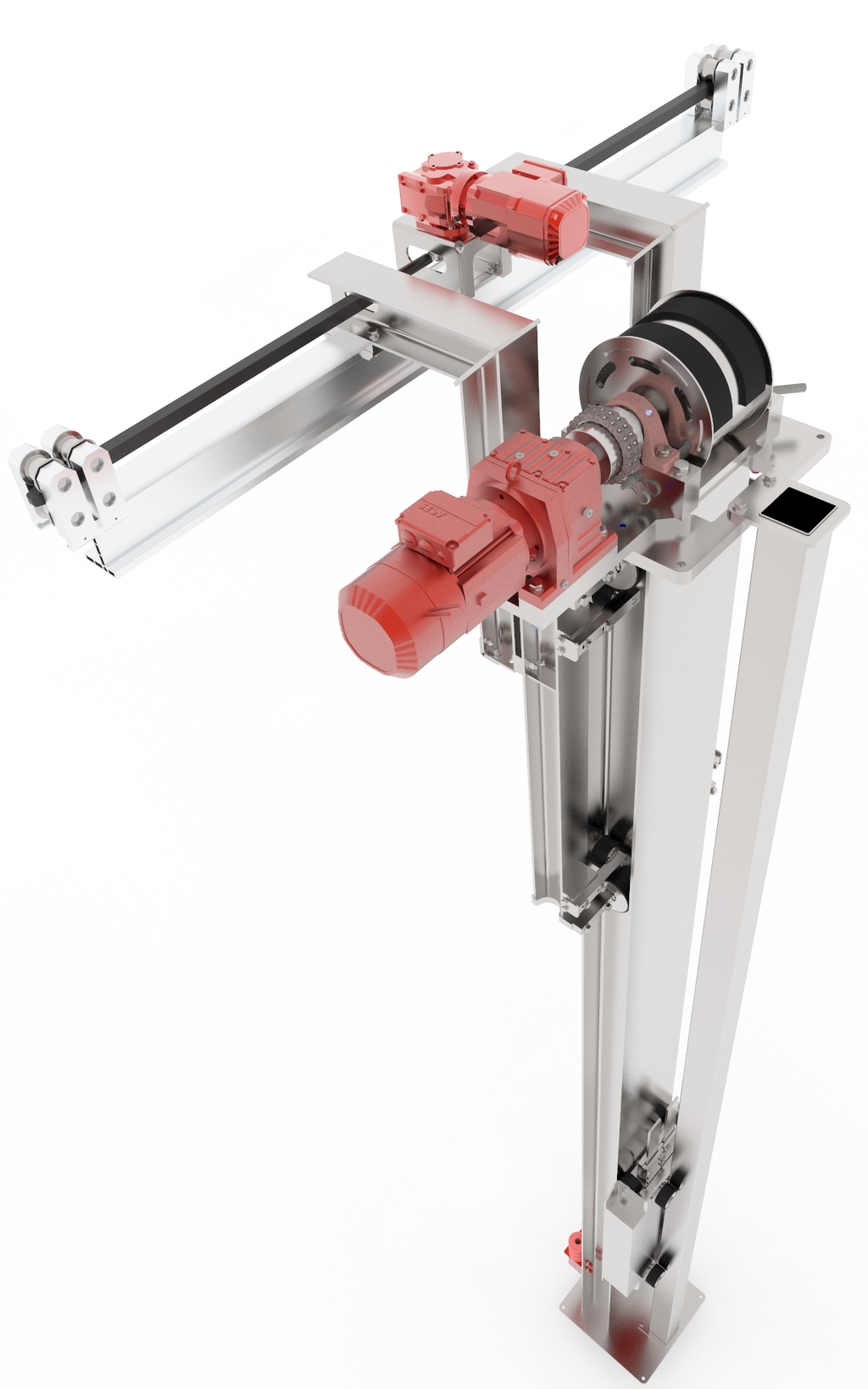

Ein smartes 3D-Robot-Vision-System eignet sich für viele Anwendungen, wie z.B. für semistruktiertes Bin Picking. (Bild: LMI Technologies GmbH)

Es gibt zwei typische Ansätze für die Konfiguration von 3D-Sensoren mit Robotern: fest in der Anlage montiert oder montiert an einem Roboter. Bei fest in der Anlage montierten Systemen befindet sich der Sensor in einer festen, vom Roboter getrennten Position. Der Sensor scannt einen Arbeitsbereich ab, um ein Objekt zu lokalisieren und übermittelt die Positionsdaten an den Roboterarm. Eine Kalibrierung ist erforderlich, um die Beziehung zwischen dem Sensorkoordinatensystem und dem Roboterkoordinatensystem herzustellen, damit in einer 3D-Punktwolke identifizierte Objekte von einem Roboter aufgenommen werden können.

Ein 3D-Smart-Sensor führt die Kalibrierung, Punktwolkenerfassung, Teilelokalisierung und Roboterkommunikation durch. Der Roboter führt die Pfadplanungslogik aus, die den Endeffektor präzise und effizient bewegt, um ein Objekt aufzunehmen. Die Montage von Sensoren an einem Rahmen ist bei Bin-Picking-Anwendungen üblich. Dabei zeigen die Scandaten eine 3D-Punktwolke mit vielen zufällig gestapelten Teilen desselben Objekts in einem Behälter. Intelligente Lokalisierungssoftware verarbeitet die Punktwolke, um das nächste zu entnehmende Teil (das normalerweise oben auf dem Stapel liegt) zu identifizieren und in einen Fertigungsprozess einzuspeisen. Zusätzlich zur Objekterkennung bei Pick&Place-Anwendungen, kann der Sensor auch für Messungen und die Qualitätskontrolle von Objekten verwendet werden, bei denen der Roboter dem Sensor das Messobjekt zur Inspektion präsentiert und dann eine Pass/Fail-Entscheidung gefällt wird.

Hand-in-Auge-Kalibrierung

In dieser Konfiguration ist der Sensor am Roboterendeffektor montiert und führt den Roboter zur Echtzeitpositionierung sowie bei kritischen Aufgaben wie der Schweißnahtverfolgung oder Montage. Die Kalibrierung von Systemen, bei denen ein Roboter am Sensor montiert ist, wird oft als Hand-in-Auge-Kalibrierung bezeichnet. Hand-in-Auge-Systeme stellen nicht nur die Genauigkeit sicher, sondern sind auch sehr flexibel und können die Einschränkungen einer festen Arbeitsumgebung überwinden. Somit sind diese Systeme in der Lage die Inspektion großer Objekte mit vielen verdeckten Bereichen durchzuführen.

Verschiedene Ansätze: Nicht Smart vs. Smart

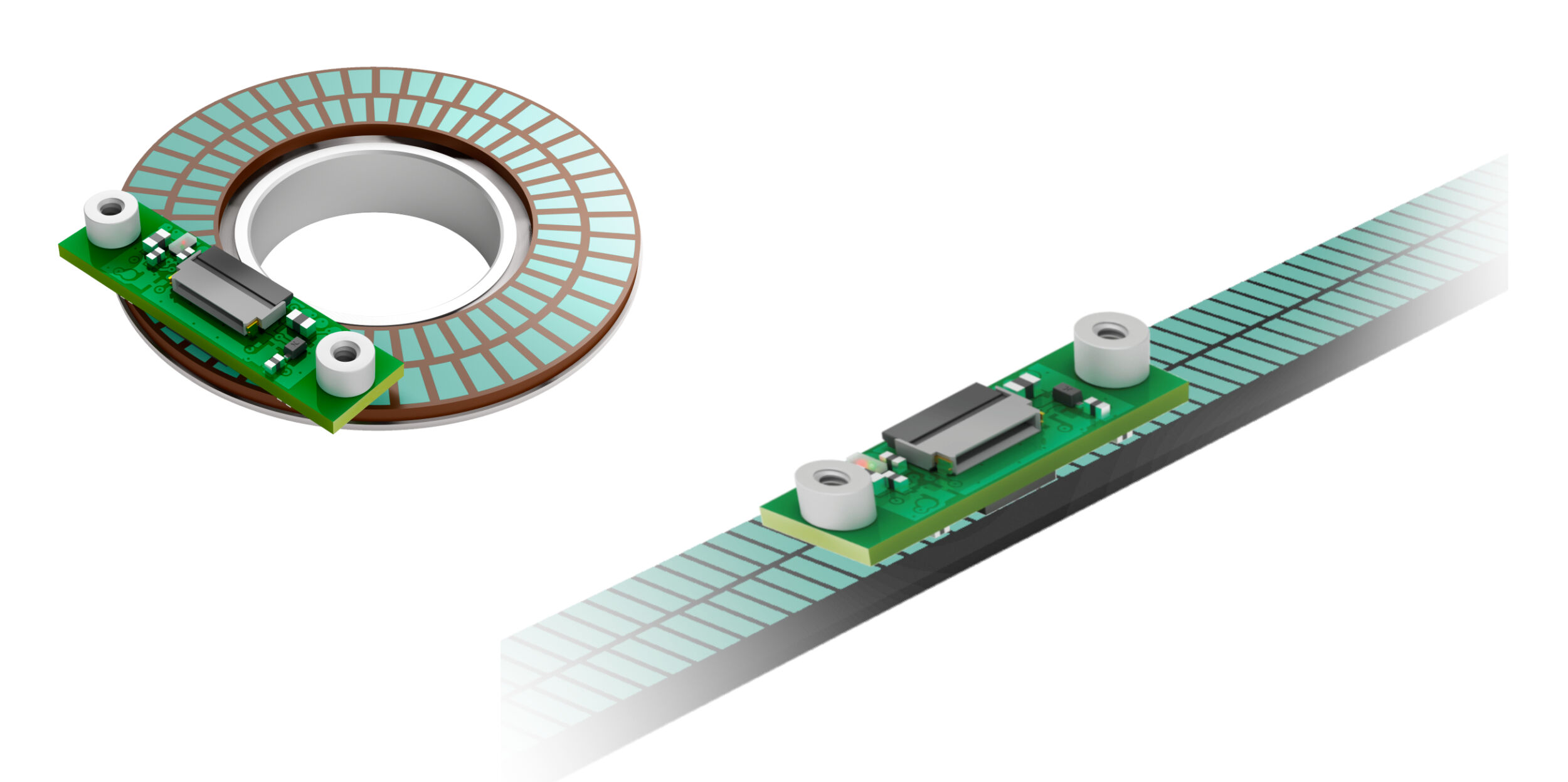

Der erste wesentliche Vorteil von 3D-Smart-Sensoren gegenüber herkömmlichen Sensoren ist die direkte Kommunikation mit dem Roboter. Standardsensoren kommunizieren normalerweise über einen Host-PC mit dem Roboter, was sowohl die Latenzzeit als auch die Systemkosten und die Komplexität der Integration erhöht. Das Ziel der Sensor/Roboter-Kalibrierung ist es, eine Beziehung zwischen dem Koordinatensystem des Sensors und dem Roboterkoordinatensystem herzustellen. Das führt zu einer Transformation, bei der ein Teil aus einer 3D-Punktwolke (Sensorkoordinaten) in eine Bewegung umgewandelt wird, die ein Roboter mit seinem Bewegungs-/Encoder-Subsystem aufnehmen kann (Roboterkoordinaten). Eine Kalibrierroutine erfordert in der Regel einen kurzen Trainingsaufbau, bei dem ein bekanntes Objekt dem Sensor (z.B. ein Kugelstab) in verschiedenen Orientierungen präsentiert wird. Die resultierenden Scans werden analysiert, um Positionsdaten zu extrahieren und eine 6-DOF-Transformation zu erstellen, die die Kugelstabposition von einem 3D-Scan in eine entsprechende Roboterposition konvertiert.

3D-Smart-Sensoren verfügen über integrierte Messwerkzeuge und Steuerungsentscheidungen, sodass Robotersysteme Objekte messen und prüfen können. Sensoren ohne Smartfunktionen können die gleichen Prüffunktionen nur mit teurer Software von Drittanbietern und einem externen PC erreichen. Außerdem benötigen 3D-Smart-Sensoren keine Kalibrierung, Drittanbietersoftware, PCs oder die Entwicklung von Roboterprogrammen. Somit führt der Einsatz von 3D-Smart-Sensoren zu einer schnellen Bereitstellung von Lösungen.

Vorteile von Robotersichtführung

Normalerweise bewegt sich ein Roboter blind und wiederholgenau zu einer bekannten Position innerhalb seines Arbeitsbereichs. Mit smarter 3D-Robotersichtführung kann der Roboter nun dynamische Bewegungen basierend auf den Sensorinformationen ausführen. Das führt zu einer Steigerung der Wertschöpfung des Roboters in einem Fertigungsprozess. Robotersichtführung wird in vielen Industriezweigen eingesetzt, z.B. in der Verpackungs- und Logistikbranche, in der Automobil-, Pharma-, Medizin- und Elektronikindustrie sowie in der Lebensmittel- und Getränkeindustrie. Der Wechsel zwischen Produkt- und Serienfertigung erfolgt softwaregesteuert und sehr schnell, ohne dass eine mechanische Anpassungen erforderlich ist.

Beispiele für Industrieanwendungen

Die häufigste Sichtführungsanwendung ist das Pick&Place-Verfahren, bei dem ein Sensor über einem Arbeitsbereich montiert wird, in dem der Roboter eine Pick&Place-Bewegung ausführt (z.B. das Umladen von Objekten von einem Förderband in eine Kiste). Eine weitere typische Sichtführungsanwendung ist die Inspektion von Bauteilen. Dabei führt der Roboter den Sensor an verschiedene Positionen, um das Messobjekt zu prüfen (z.B. Spalt- und Bündigkeitsprüfung an einer Autokarosserie oder Prüfung von Loch- und Bolzenabmessungen). Die anspruchsvollste Art von Sichtführungsanwendungen ist, wenn der Manipulator an einem Roboter eine Vorrichtung aufnimmt, die eine Reihe von Sensoren aufweist, und dann so programmiert ist, dass er ein Werkstück aufnimmt und mit Hilfe von Sensor-Feedback in eine größere Baugruppe einführt (z.B. Einführen von Türverkleidungen oder Windschutzscheiben).