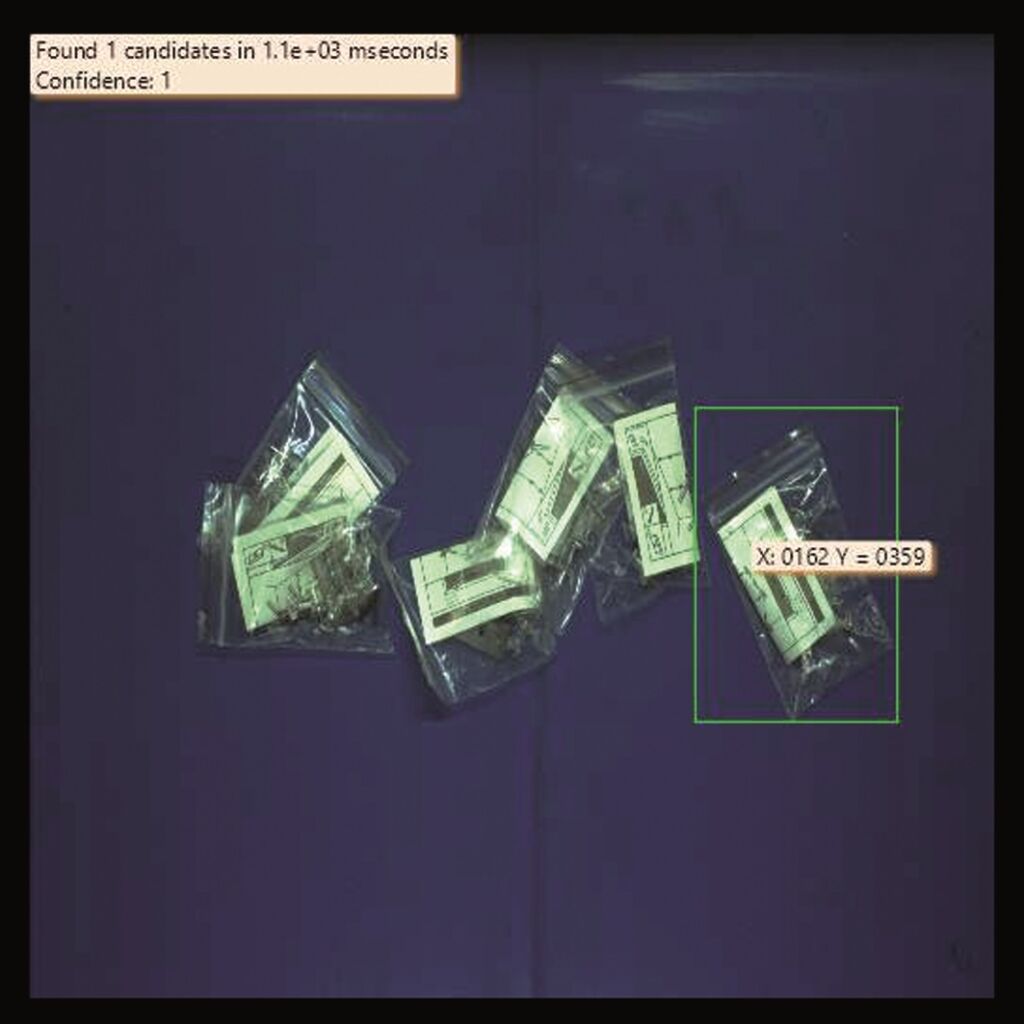

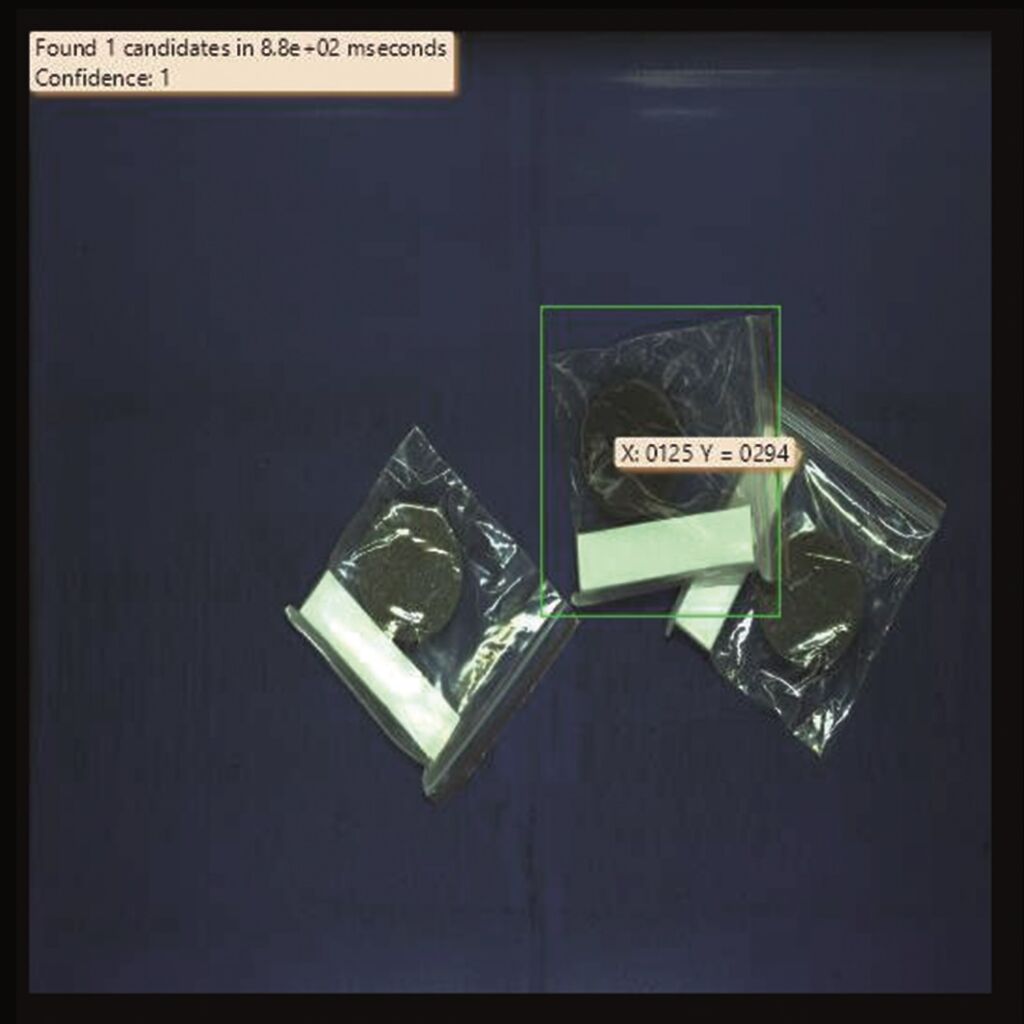

Plastikbeutel mit Montagezubehör können viele verschiedene Formen aufweisen. In industriellen Prozessen kommt es daher oft zu Schwierigkeiten beim präzisen Identifizieren und automatisierten Greifen solcher Beutel, vor allem wenn sie ungeordnet liegen und/oder aus durchscheinendem Material bestehen. Infolgedessen leidet die Produktivität, z.B. bei Pick&Place-Tätigkeiten. Genau dieser Herausforderung widmet sich nun eine Lösung von Tekvisa. Entsprechende Prozesse können damit zuverlässig und durchgängig automatisiert und somit beschleunigt werden – und zwar mit Machine Vision.

Tekvisa Engineering mit Standorten in Spanien und Portugal ist spezialisiert auf digitale Inspektionssysteme für die Qualitätskontrolle und Prozessautomatisierung im industriellen Umfeld. Die Lösungen basieren auf industrieller Bildverarbeitung. Dabei verfolgt Tekvisa seit seiner Gründung das Ziel, besonders benutzerfreundliche und fortschrittliche Systeme für verschiedene Branchen wie die Automobil- und Lebensmittelindustrie zu entwickeln und auf den Markt zu bringen. Das Unternehmen verfügt über mehr als 14 Jahre Erfahrung mit Machine-Vision-Systemen. Neben Deep-Learning-basierten Inspektionslösungen entwickelt Tekvisa u.a. auch anspruchsvolle Robotik- und Bin-Picking-Anwendungen.

Zubehörbeutel identifizieren und positionieren

Für einen Hersteller von Wandtafeln für Büros hat das Unternehmen ein robotergestütztes Kommissioniersystem entwickelt, das auf industrieller Bildverarbeitung mit Deep-Learning-Algorithmen basiert. Die Lösung hat die Aufgabe, Kunststoffbeutel mit Zubehör für die Wandtafeln präzise zu detektieren, damit Roboter sie sicher greifen können. Bislang wurde diese Aufgabe rein manuell durchgeführt, was jedoch einen hohen Zeitaufwand verursachte und damit den gesamten Prozess in die Länge zog. Um die Produktivität zu steigern, sollte der gesamte Workflow durchgängig automatisiert werden. Ziel dabei war es auch, die Mitarbeiter von der monotonen Routineaufgabe des Positionierens der Beutel zu entlasten, damit sie sich anspruchsvolleren Tätigkeiten widmen können.

Bei der Entwicklung einer entsprechenden Automatisierungslösung war eine Besonderheit zu beachten: Die Beutel enthalten eine Vielfalt verschiedener Arten von Zubehör. Dazu zählen z.B. Befestigungsmaterial wie Schrauben, Muttern und Dübel, Stifte und Textmarker zum Beschriften der weißen Wandtafeln, Pinnadeln für die Korkwandplatten oder auch Schwämme zum Abwischen der Wandoberflächen. Folglich können die Beutel in Größe und Gewicht variieren sowie viele unterschiedliche Erscheinungsformen aufweisen. Darüber hinaus sind sie willkürlich geformt und aufgrund ihrer Elastizität möglicherweise zusätzlich auch zusammengedrückt, auseinandergezogen oder auf eine andere Art verformt.

Hohe Produktvarianz als Herausforderung

Die enorm hohe Produktvarianz stellte die Ingenieure bei Tekvisa vor große Herausforderungen: Ziel war die Entwicklung einer flexiblen Lösung auf Basis von Machine Vision, die alle erdenklichen Arten und Ausprägungen von Zubehörbeuteln verlässlich erkennt und damit sichere Greifprozesse ermöglicht. Wichtig dabei: Das System sollte jeweils diejenigen Beutel auf dem Förderband identifizieren, die sich aufgrund ihrer Position und Ausrichtung am besten vom Roboterarm aufnehmen lassen. „Für uns war von vornherein klar, dass die Lösung nur in einer geschickten Kombination aus klassischen Bildverarbeitungsmethoden und Lösungen auf Basis von künstlicher Intelligenz wie Deep Learning bestehen kann“, erklärt Paulo Santos, Mitbegründer und CTO von Tekvisa.

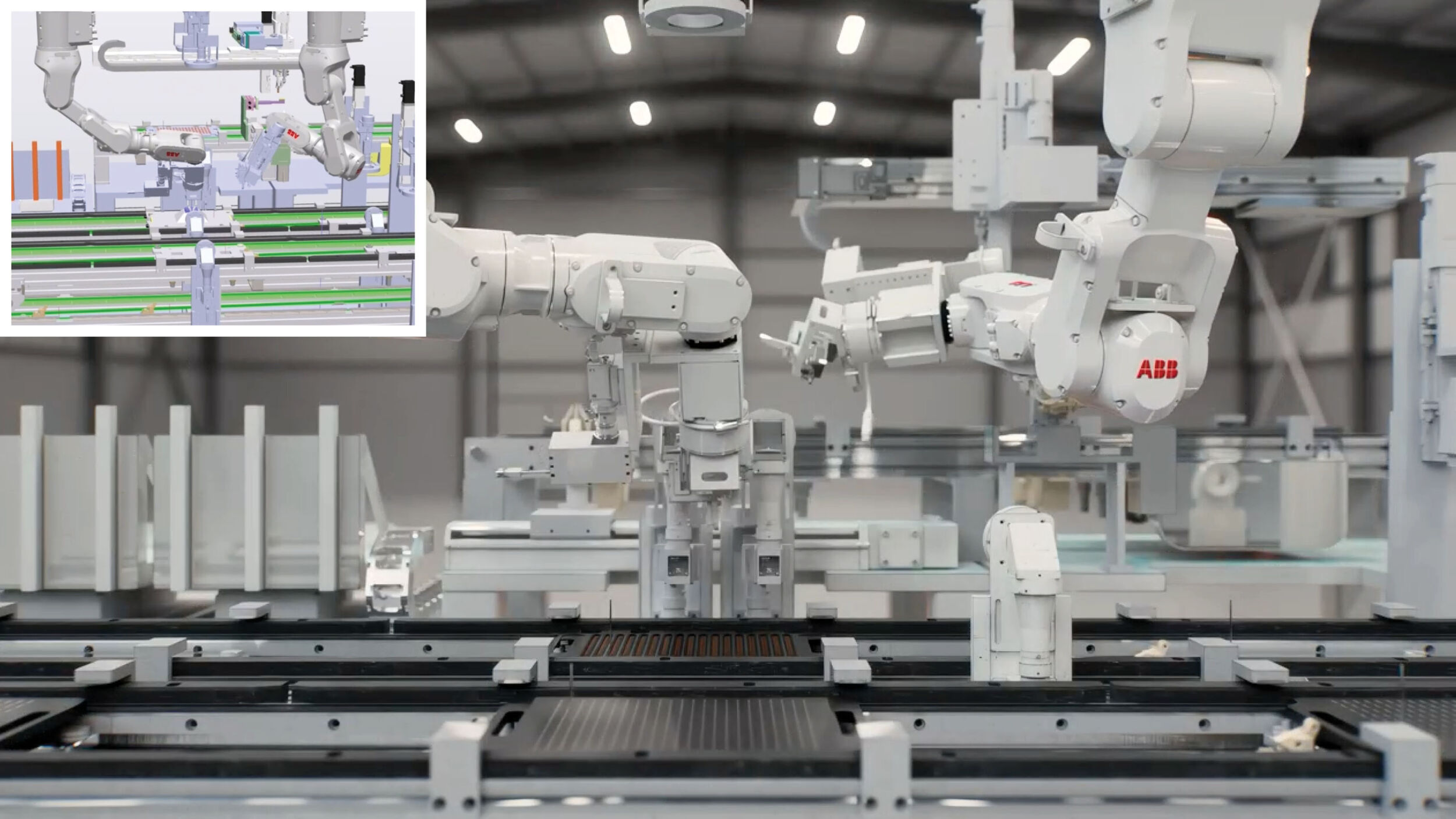

Das komplette Setup besteht aus einer hochauflösenden Farbflächenkamera und einer speziellen Beleuchtung, die die Reflexionen reduziert und damit den Weg für die präzise Erkennung des jeweiligen Beutelinhalts ebnet. Herzstück der Anwendung ist ein Machine-Vision-System. Es identifiziert die auf dem Förderband liegenden Kunststoffbeutel zielgenau, sodass ein Roboter sie exakt greifen kann. Dieser platziert sie dann kurz vor dem finalen Verpackungsprozess mit hoher Präzision auf der zu verpackenden Wandtafel.

Klassische Bildverarbeitung und Deep Learning

Anhand der vielen verschiedenen Erscheinungsformen und Positionen der Beutel wählt die Bildverarbeitungslösung die jeweils passenden Kandidaten für die Kommissionierung aus. Zum Einsatz kommt dabei die Machine-Vision-Standardsoftware MVTec Halcon. Die Software verfügt über eine Bibliothek mit über 2.100 Operatoren. Für die Anforderungen von Tekvisa ist vor allem die Deep-Learning-Methode Object Detection von großem Nutzen. Mittels der darin enthaltenen Deep-Learning-Algorithmen wird das System zunächst mit Beispielbildern umfassend trainiert. So lernt die Software, welche verschiedenen Ausprägungen die Beutel aufweisen können. Das führt zu einer sehr robusten Erkennungsrate – auch bei einer schier unendlichen Varianz der Objekte. Die nicht zum Greifen ausgewählten Beutel werden aussortiert und dem System dann erneut zugeführt. Durch die Neupositionierung nehmen sie dann eine günstigere Position auf dem Förderband ein, sodass der Roboter sie besser aufnehmen und für den Versand platzieren kann. Auf diese Weise lassen sich auch überlappende und übereinander liegende Beutel greifen und kommissionieren. Dabei ist das System in der Lage, bis zu 60 Beutel pro Minute mithilfe der integrierten Bildverarbeitungssoftware zu analysieren und zu identifizieren.

Hand/Auge-Kalibrierung

Für die robusten Erkennungsraten sind neben den Deep-Learning-Lösungen auch klassische Bildverarbeitungsverfahren verantwortlich, die ebenfalls integraler Bestandteil von Halcon sind. Neben dem Bildeinzug und diverser Werkzeuge zur Vorverarbeitung der Bilder, ist die Hand/Auge-Kalibrierung hier ein wichtiges Feature. Sie ist vorab erforderlich, damit der Roboter im laufenden Betrieb die Beutel, die von einer stationären 2D-Kamera beobachtet werden, exakt greifen und platzieren kann.

![Die [me] - mechatronik & engineering wird digital 19 Die [me] – mechatronik & engineering wird digital](https://cdn.tedo.be/tedo-mu/wp_uploads/sites/20/2026/03/Unbenannt.jpeg)