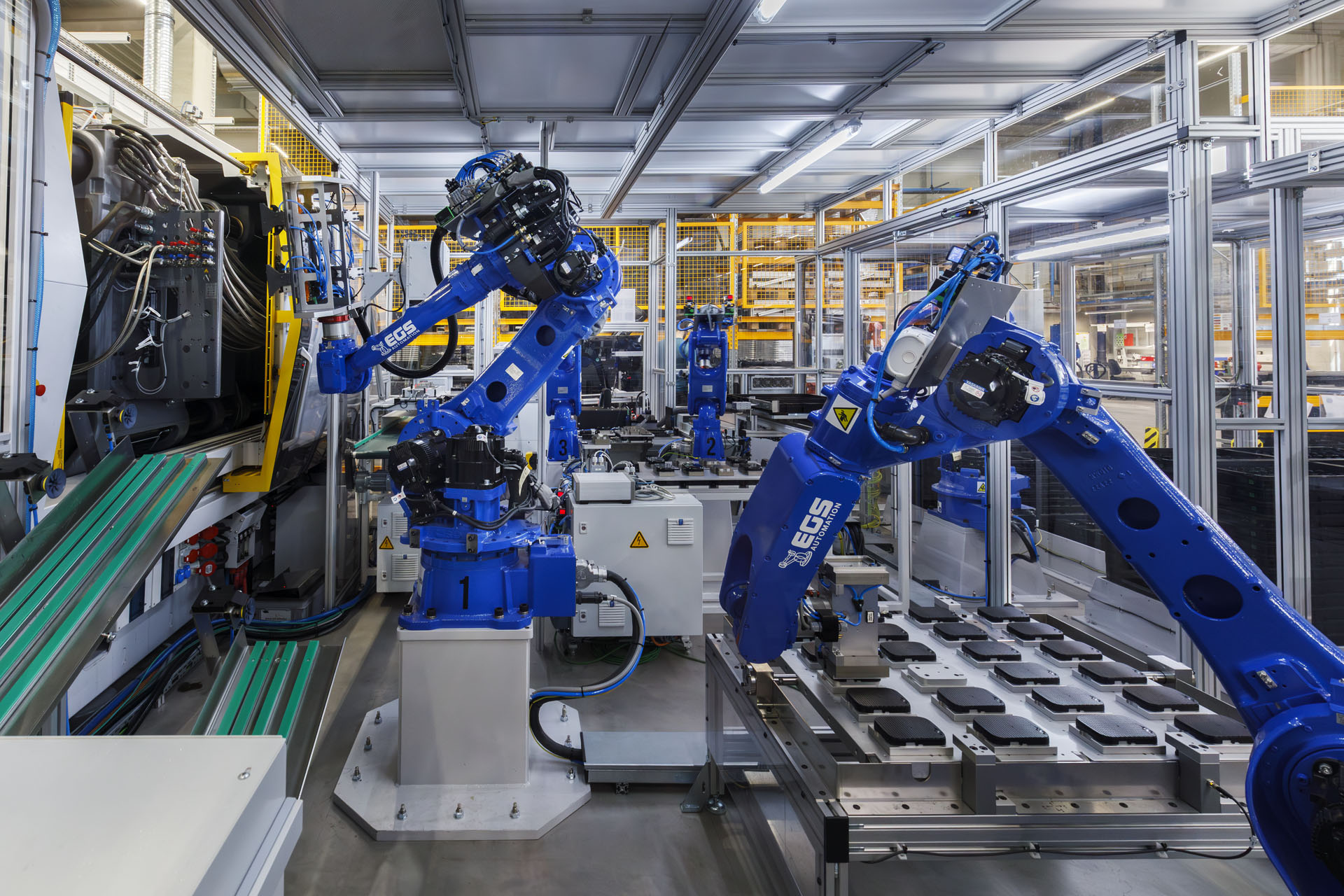

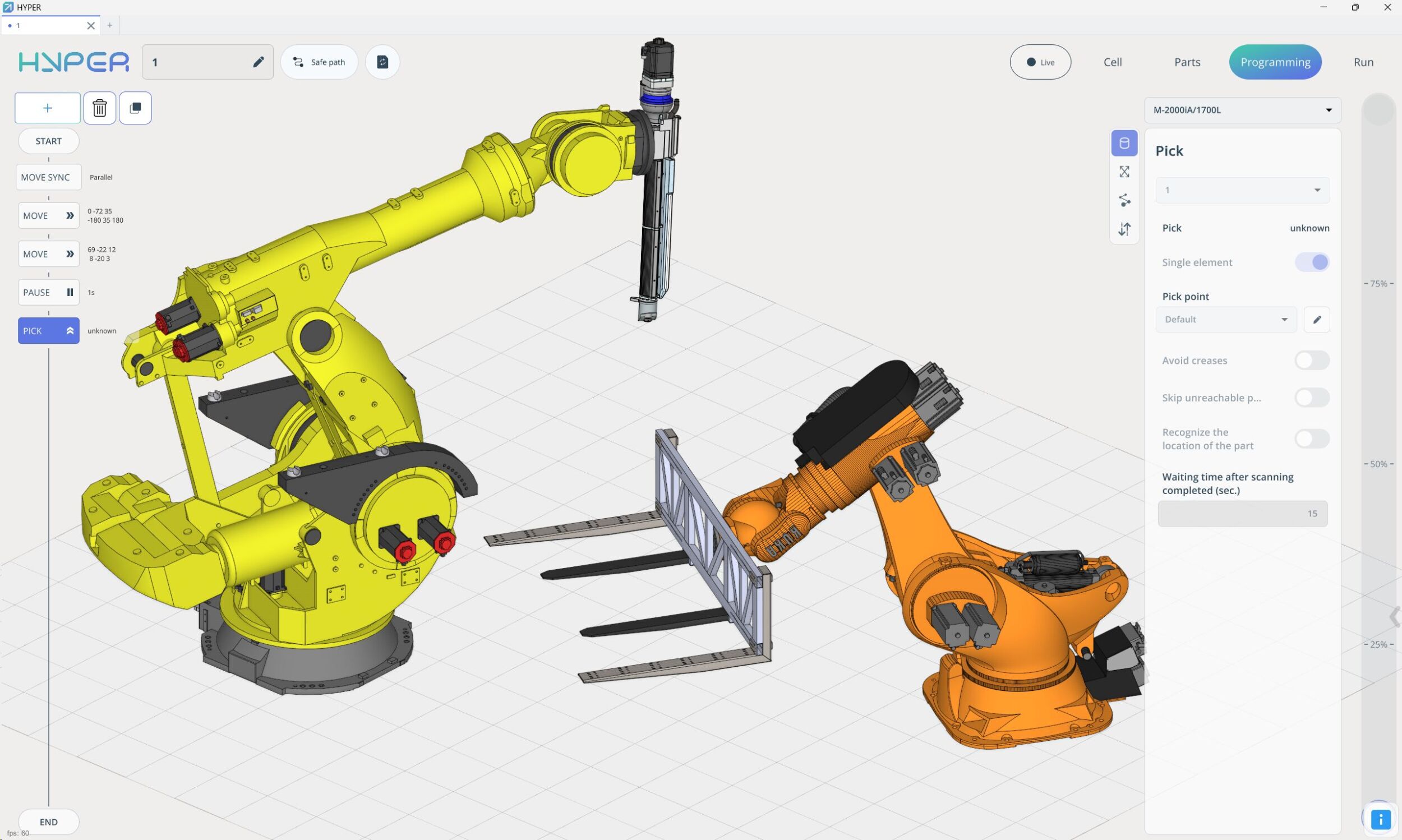

Die Lage ist anspruchsvoll: Ob Produkte geordnet im Tray stehen oder lose chaotisch auf dem Transportband liegen, stets müssen Roboter – z.B. Pick&Place-Systeme -wissen, was ihnen vorgesetzt wird und was sie damit tun sollen. Wissen ist im maschinellen Kontext mit Vorsicht zu betrachten: Ein Roboter weiß Dinge nicht wie wir Menschen. Dennoch kann man ihm Informationen vermitteln, auf die er bei seiner schnellen, sehr akkuraten Tätigkeit zurückgreift.

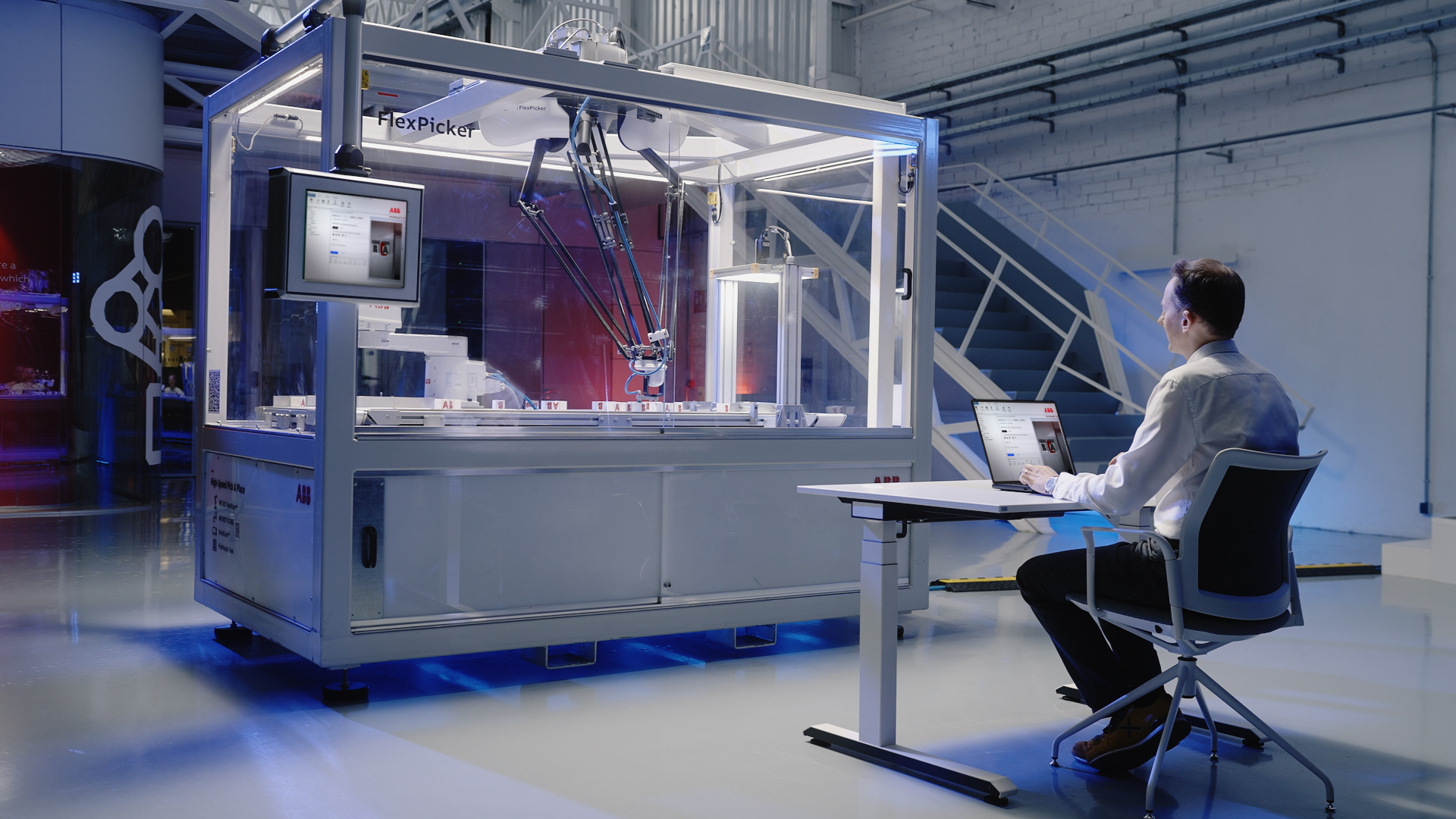

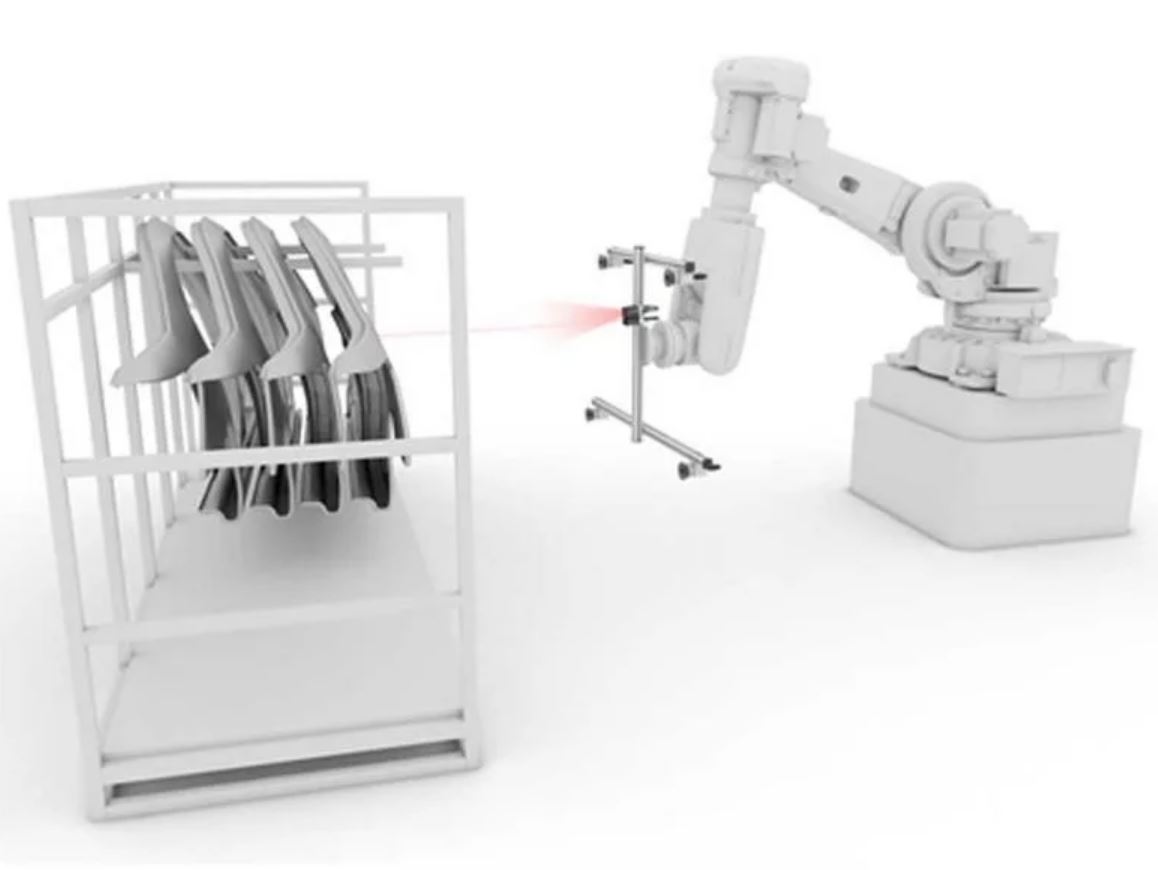

Es geht um den Produkttyp, seine Lage im Raum und die Tiefe. Spezialisierte Bildverarbeitung erfasst diese Werte mit Mono-Kameras und übergibt sie an Kinematiken wie Scara oder Delta, die die Produkte gezielt greifen und ablegen. Deshalb werden nicht die Roboter selbst, sondern ihre Vision-Systeme vorbereitet – durch Training mehrerer neuronaler Netze, jeweils eines für jeden der oben genannten Parameter.

Lernen mit Bildern

Für das Training kommen Gewichte zum Einsatz – nicht in Form schwerer Gegenstände, sondern als numerische Parameter innerhalb des neuronalen Netzes, die während des Lernprozesses angepasst werden. Diese Gewichte bestimmen, wie stark verschiedene Eingaben die Ausgabe beeinflussen. Um diese Gewichte zu trainieren, benötigt das System Datensätze – Trainingsdaten, die das Netz erhält, damit es bestimmte Aktionen ausführen kann. Vereinfacht gesagt legen Datensätze fest, was ein bestimmter Anwender konkret vom Netz erwartet. Automatisierte Fertigungsanlagen stellen höchste Anforderungen an Sicherheit, Taktleistung und Integration. Erfahren Sie in diesem Whitepaper, wie Maschinenschutztore normgerecht geplant und effizient in automatisierte Anlagen integriert werden. ‣ weiterlesen

Whitepaper

Maschinenschutztore in Anlagen integrieren

Beispiel Objekterkennung

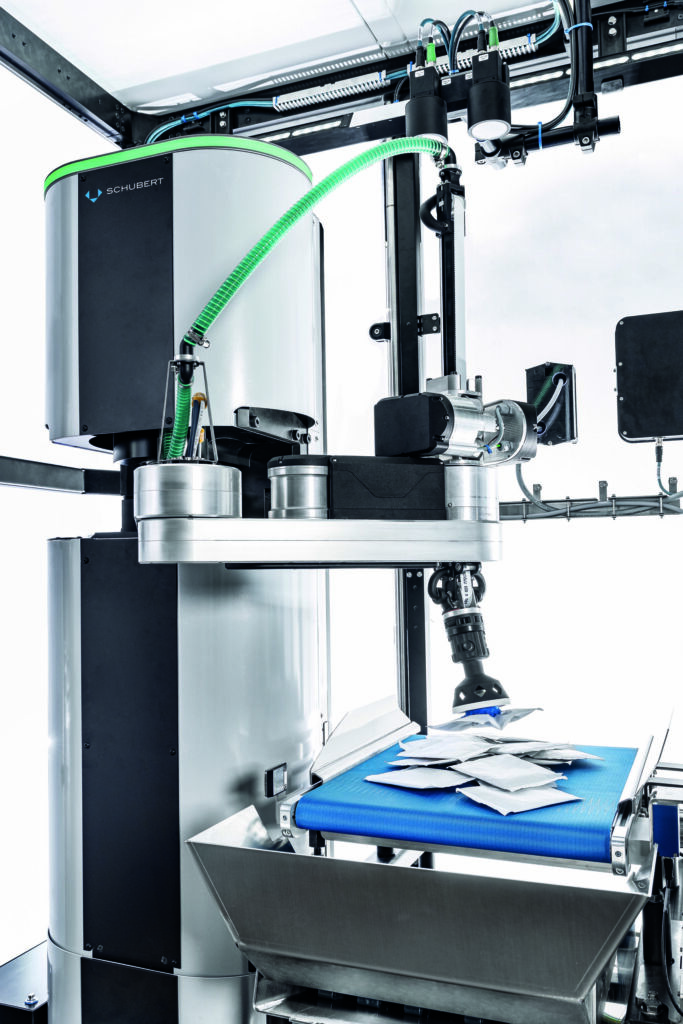

Das entsprechende neuronale Netz einer Pick&Place-Linie enthält Informationen über pickbare Produkte – ihre Art, Form und Größe – z.B. Flaschen, Pouches oder Sachets. Das Wissen über die jeweiligen Verpackungen, die es später erkennen soll, stammt jedoch nicht von ungefähr. Damit das Netz weiß, welche Produkte in diese Kategorie fallen und welche nicht, wo sich die pickbaren Produkte im Roboter-Kamera-Bild befinden und wie sie orientiert sind, erhält es vorab viele Bilddaten – digital erzeugt mit einem speziellen Generator von Schubert.

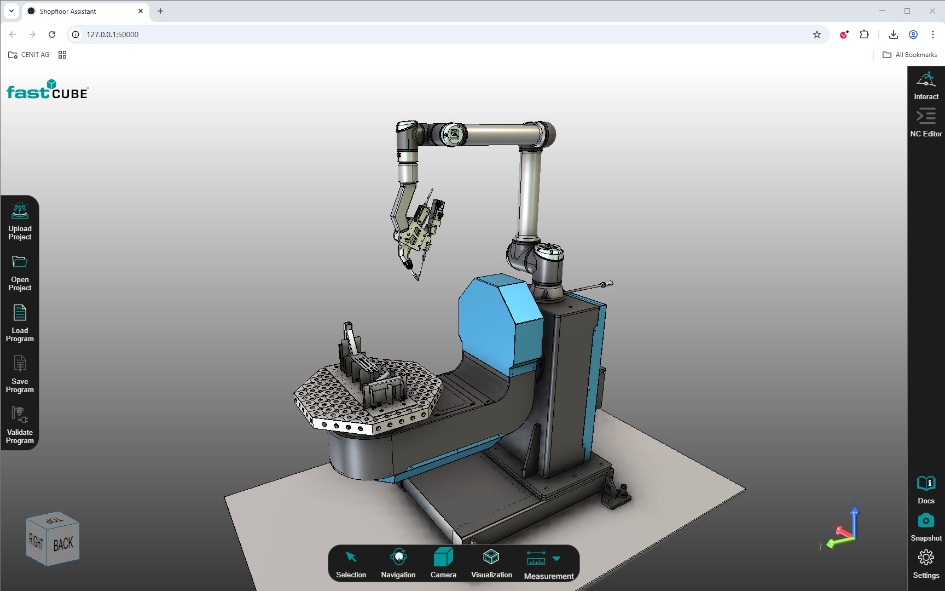

Im Gegensatz zur manuellen Datenerfassung, bei der Menschen für jedes Bild die Position, Kategorie und Orientierung der pickbaren Produkte definieren müssen – ein fehleranfälliger Prozess, der bei 8.000 Bildern 600 Stunden dauert – erzeugt der Datensatzgenerator automatisch fehlerfreie Datensätze. Er simuliert die komplette Roboterzelle mit Förderband und Kameras und benötigt nur Produkttexturen oder ein 3D-Modell. So entstehen realistische Bilder mit authentischen Produktverformungen und variierenden Lichtverhältnissen unterschiedlicher Produktionshallen. Alle erwarteten Ergebnisse werden durch die voll simulierte Szene automatisch und fehlerfrei mitgespeichert – ohne Zusatzaufwand.

Supervised Learning

Je mehr Bilder der Generator erzeugt, desto genauer identifiziert das Vision-System pickbare Objekte – genau darin besteht das eigentliche Training, das als Supervised Learning bezeichnet wird. Der generierte Datensatz enthält neben realistischen Szenen verteilter Produkte auf dem Präsentierband auch die gewünschte Ausgabe: Position und Orientierung pickbarer Produkte im Bild und deren Lage im 3D-Raum.