Robotergestützte Handhabung von Textilien mithilfe von Computer-Vision und KI

Erstmals automatisiert

Die Automatisierung von Handhabungsprozessen, bei denen es um forminstabile Materialien geht, ist nicht einfach zu bewerkstelligen. Denn durch die weiche Konsistenz, z.B. von Textlilien, verändert sich die Geometrie des zu greifenden Objekts bei jeder Berührung durch den Roboter. Zusammen mit Tim Doerks, Mitgründer des Robotik-Startups Sewts, und Michael Mayr von Dassault Systèmes ist ROBOTIK UND PRODUKTION tief in die Welt der Textilien eingetaucht und hat sich das Velum-System von Sewts einmal genauer angesehen. Denn hier wurde ein Prozess, der sonst dem menschlichen Mitarbeiter vorbehalten war, erstmals automatisiert.

ROBOTIK UND PRODUKTION: Zu Beginn erst einmal ganz allgemein gefragt: Welche Herausforderungen gibt es bei Greifanwendungen mit forminstabilen Materialien, wie z.B. Textilien, zu beachten?

Tim Doerks, Sewts: Die große Herausforderung im Robotikbereich ist, dass wir bei forminstabilen Materialien eine ständig veränderte Geometrie haben. Formfeste Bauteile kann ein Roboter ziemlich einfach von A nach B bewegen, wenn er den passenden Greifpunkt findet. Bei forminstabilen Materialien haben wir das Problem, dass quasi nie zwei gleiche Teile vorhanden sind, denn allein durch die Bewegung des zu greifenden Objekts, z.B. ein Handtuch, ändert sich die komplette Geometrie. Das macht den gesamten Greif- und Handhabungsprozess wesentlich komplexer.

„Wir haben eine vision-basierte Deep-Learning-Anwendung entwickelt. Durch Simulationen können wir darin neue Eigenschaften flexibel nachtrainieren, ohne erneut Daten zu labeln.“

Tim Doerks, Sewts

ROBOTIK UND PRODUKTION: Was ist das Besondere an Ihrem Velum-System? Wie wurde hier ein Arbeitsschritt automatisiert, der zuvor als nicht automatisierbar galt?

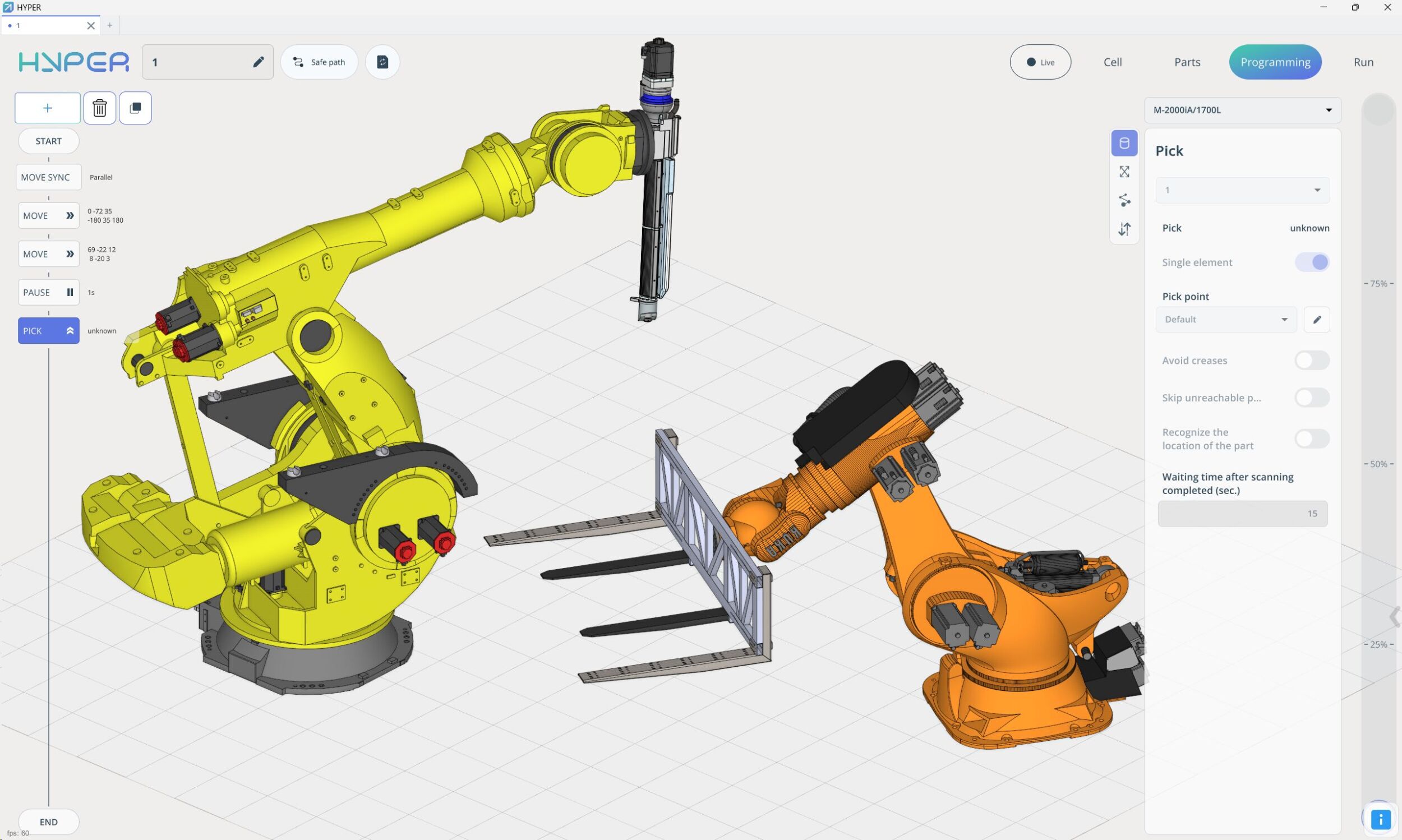

Doerks: Wir haben eine Deep-Learning-Anwendung entwickelt, die vision-basiert funktioniert. Konkret heißt das, wir machen eine Bildaufnahme vom Textil und können daraus die Greifpunkte für den Roboter extrahieren. Damit liefern wir einen passenden Handhabungspunkt, um mit dem Greifvorgang anzusetzen.

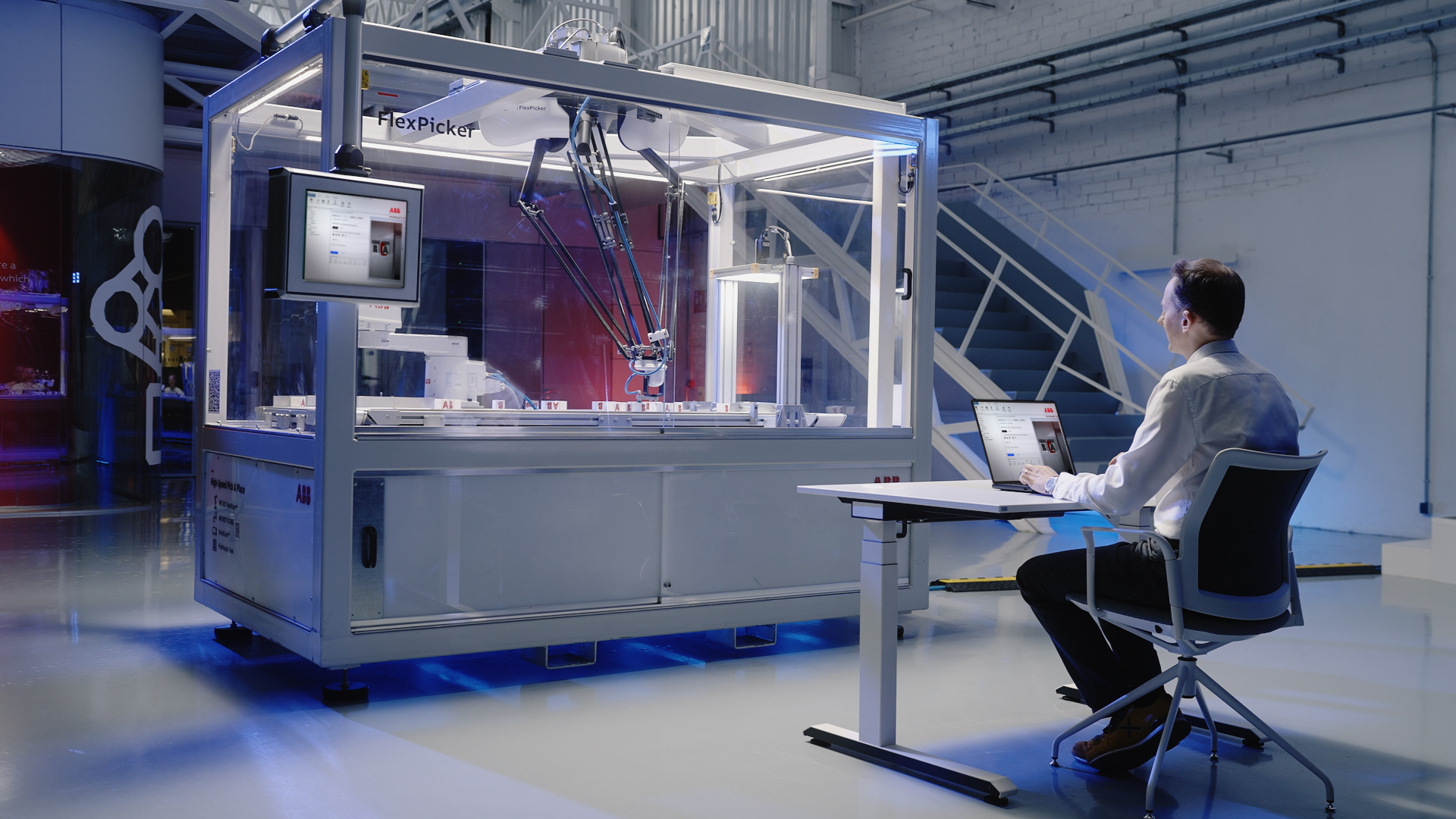

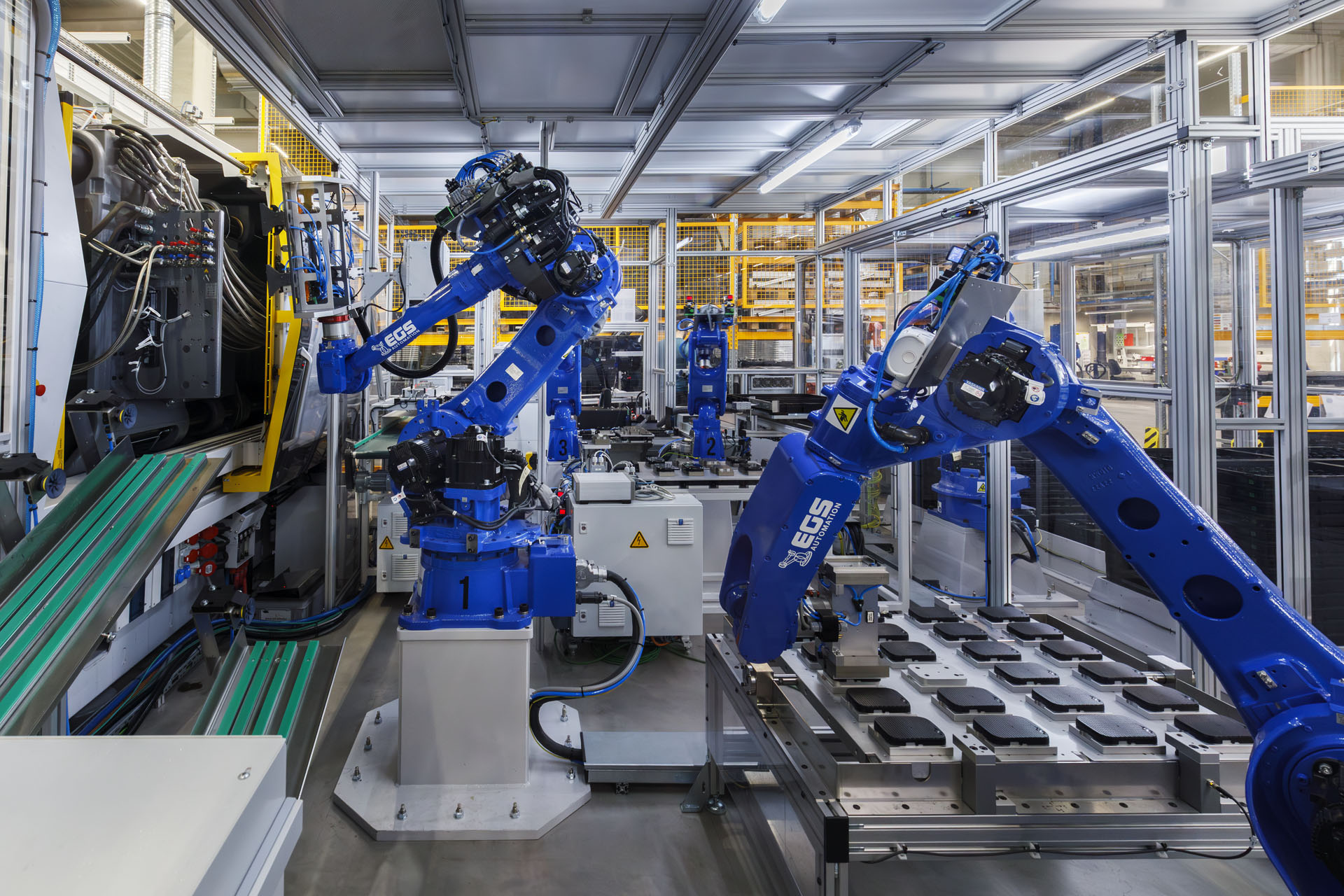

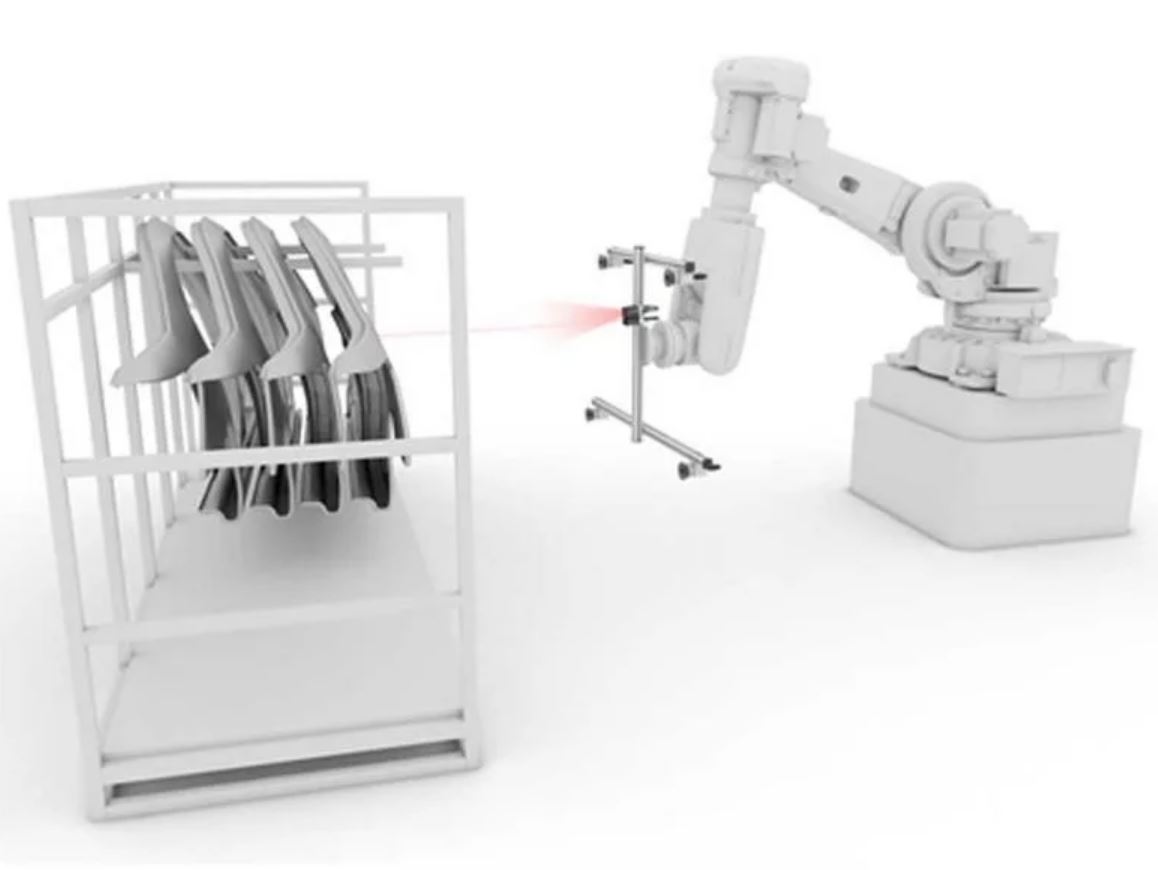

Unser erstes Produkt ist das Velum-System, eine Anwendung, die Handtücher aus Wannen pickt und in automatisierte Faltanlagen einlegt. Das System beinhaltet zwei Fanuc-Roboter, die jeweils mit einem 2D- und einem 3D-Kamerasensor ausgestattet sind. Die Greifpunkte für den Roboter werden aus der Topologie, die sich aus den 2D- und 3D-Daten der Sensoren ergibt, berechnet. Nach dem ersten Pick kommt das Vision-System noch einmal zum Einsatz, um den nächsten Greifpunkt für den zweiten Pick zu bestimmen. Durch den wiederholten Pick-Vorgang erhöhen wir die Wahrscheinlichkeit, den Saum des Handtuchs sauber zu greifen. So wird der Prozess insgesamt stabiler. Dieses iterative Verarbeiten von Textilien plus KI plus Prozessdesign ist der Kern unserer Entwicklung. Automatisierte Fertigungsanlagen stellen höchste Anforderungen an Sicherheit, Taktleistung und Integration. Erfahren Sie in diesem Whitepaper, wie Maschinenschutztore normgerecht geplant und effizient in automatisierte Anlagen integriert werden. ‣ weiterlesen

Whitepaper

Maschinenschutztore in Anlagen integrieren

ROBOTIK UND PRODUKTION: Mit welchen Roboter- und Greiferherstellern arbeiten Sie bisher zusammen?

Doerks: Zunächst haben wir die Leichtbauroboter von Universal Robots eingesetzt, weil sie einfach zu bedienen sowie relativ kostengünstig sind und über ein offenes System verfügen. Sie konnten aber unsere Anforderungen in Bezug auf Reichweite, Geschwindigkeit, Zuverlässigkeit und Taktzeit nicht mehr erfüllen. Daher sind wir zu den Modellen M-10iD/12 von Fanuc mit einer Reichweite von 1.400mm gewechselt. Mittlerweile sind wir aber in der Lage, mit fast jedem Industrieroboter zu arbeiten. In Bezug auf den verwendeten Greifer haben wir lange mit Schunk-Greifern, wie dem WSG50, gearbeitet, haben uns aber auch Vakuum- und Volumenstromgreifer von Schmalz angeschaut. Im Serienprodukt werden wir aus Kostengründen einen Pneumatikgreifer einsetzen. Der Hauptfokus liegt bei unserer Anwendung aber nicht auf einem speziellen Greifer, sondern mehr auf der Robotertrajektorie, die um den Greifprozess herum entwickelt werden muss.

ROBOTIK UND PRODUKTION: Welche Rolle hat die 3DExperience-Plattform von Dassault bei der Produktentwicklung gespielt?

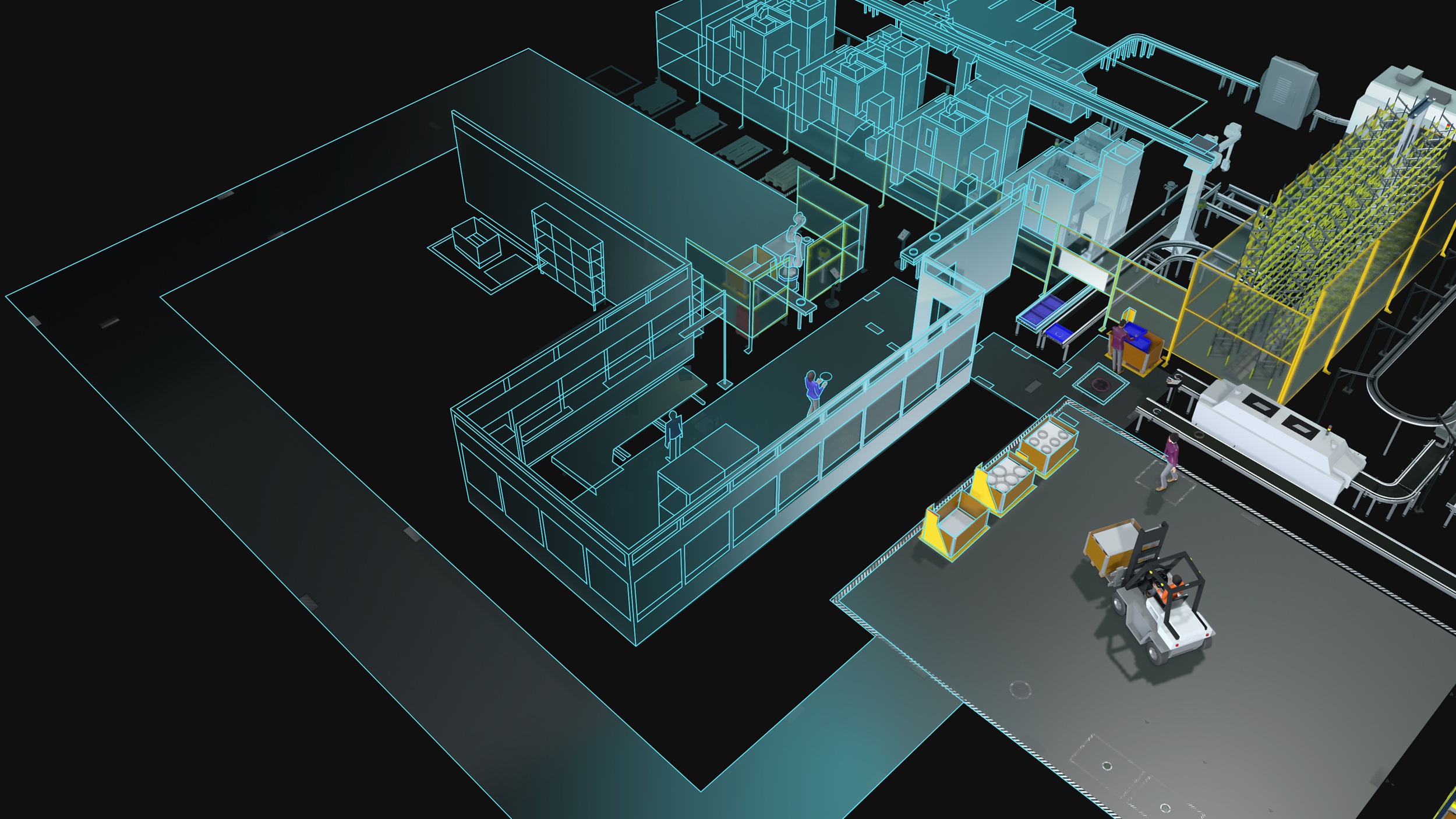

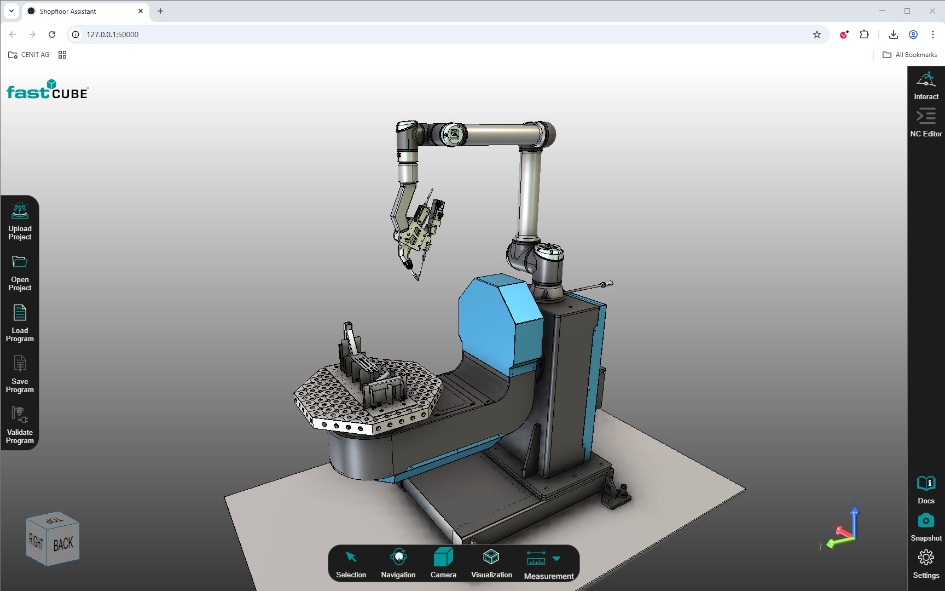

Michael Mayr, Dassault Systèmes: Die Kooperation mit Sewts ist innerhalb unseres Förderprogramm für Startups über die Firma Cenit entstanden. Dassault Systèmes hilft mit diesem Programm jungen Firmen, ein Produkt schnell zur Marktreife zu bringen. Wichtiges Werkzeug dabei ist unsere 3DExperience-Plattform. Sie bietet Sewts eine Infrastruktur, mit der alle Prozesse, von der Ideenfindung, dem Requirements Management über die Portfoliodefinierung, dem Design des Produkts, der Validierung, der Simulation bis hin zum Produktions-Engineering und dem Service, auf einer einheitlichen Datenbasis als virtueller Zwilling abgebildet werden können. Für Startups ist besonders interessant, dass sie hier alle Entwicklungsbereiche zusammenbringen können, die direkt über die Plattform miteinander kommunizieren können. So arbeiten alle Mitarbeiter auf dem gleichen Daten- und Entwicklungsstand. Mithilfe der Simulationsmöglichkeiten der 3DExperience-Plattform lassen sich bis zu 30 bis 40 Prozent an Kosten und Zeit in der Entwicklung von Prototypen einsparen. Durch die Anbindung an unsere unternehmenseigene Cloud haben die Firmen, die die Plattform nutzen, außerdem jederzeit Zugriff auf Updates aller Plattform-Tools und Apps und können ihre Computing-Ressourcen entsprechend den Anforderungen jederzeit weiter ausbauen.

„Mithilfe der 3DExperience-Plattform lassen sich bis zu 30 bis 40 Prozent an Kosten und Zeit in der Entwicklung von Prototypen einsparen.“

Michael Mayr, Dassault Systèmes

Doerks: Wir haben mit der 3DExperience-Plattform anfangs hauptsächlich konstruktiv gearbeitet. Derzeit arbeiten wir mit einem digitalen Zwilling, was die mechanischen Komponenten angeht. Für die pneumatischen Komponenten sind wir gerade dabei, einen digitalen Zwilling fertigzustellen. Einen Digital Twin der Robotertrajektorie sowie des SPS-Codes haben wir derzeit noch nicht auf der Plattform. Darüber hinaus nutzen wir die Plattform aber auch, um FEM-Simulationen durchzuführen. So können wir das Verhalten der Textilien simulieren und synthetische Bilddaten für unsere KI-Modelle generieren. Denn diese werden teilweise mit echten und teilweise mit synthetischen Daten trainiert. Der nächste Schritt wäre dann, eine Simulation zu erreichen, über die wir den Bewegungsablauf für das Textil definieren können. So ließe sich statistisch abbilden, was wir per Simulation über mögliche Greifpunkte erfahren können, um die daraus entstehenden Trajektorien für die Roboterprogrammierung zu nutzen. Das würde die Möglichkeiten, Prototypen digital zu entwickeln, enorm erweitern.

ROBOTIK UND PRODUKTION: Sie sprechen auf Ihrer Website davon, dass Sie Robotern mittels künstlicher Intelligenz und Vision-Technik beinahe menschliche Wahrnehmungsfähigkeiten und kognitive Eigenschaften verleihen. Inwieweit ist das bereits in das Velum-System eingeflossen?

Doerks: Neuronale Netze lernen unter anderem über gelabelte Daten. Hier gehen wir einen Schritt weiter: Gerade im textilen Bereich verändern sich die zu greifenden Objekte sehr stark, z.B. durch den Einsatz von unterschiedlichen Farben oder reflektierenden Materialien wie Pailletten, sodass KI hier schnell an ihre Grenzen kommt und Fehler macht. Durch unsere Simulation können wir allerdings Falleigenschaften mit unterschiedlichen Farbgebungen kombinieren. Um neue Produkte im Vorhinein zu simulieren, öffnen wir einen Teil des neuronalen Netzes wieder und trainieren die neuen Eigenschaften nach, ohne erneut Daten zum Labeln zu geben.

Bei ungeordnet liegenden Textilien muss die Trajektorie für jeden Greifvorgang neu berechnet werden. Das geschieht durch die KI automatisch. Bei unserem Velum-System lesen wir zusätzlich die Daten des Greifers aus und ermöglichen damit dem Roboter eine gewisse menschliche Feinfühligkeit. Über den Motorstrom in den Greifern ermitteln wir die Greifkraft und können so feststellen, ob z.B. der Robotergreifer gerade über einen Saum gefahren ist.

ROBOTIK UND PRODUKTION: Und zum Abschluss interessiert unsere Leser natürlich: Wann rechnen Sie mit der Marktreife Ihres Prototypen? Wie sieht die weitere Roadmap aus?

Doerks: Wir wollen bis Mai oder Juni dieses Jahres bei unserem ersten Kunden vor Ort sein. Die eigentliche Entwicklung des Produkts an einem Prototypen mit Industrierobotern hat im Februar 2021 begonnen. Den Proof of Concept haben wir bereits Mitte 2019 entwickelt. Als nächste Produkte planen wir ein ähnliches Followup-Produkt für den Industrial-Laundry-Markt sowie eine Neuentwicklung für den Bereich E-Commerce. Hier wollen wir einen Teil des Return Handlings für Textilien automatisieren. So müssen die retournierten Artikel nicht mehr über günstige Standorte in Osteuropa geschleust werden, sondern können vor Ort automatisiert inspiziert und schnell zurück in den Umlauf gebracht werden.

Tim Doerks ist Mitgründer und CTO von Sewts, Michael Mayr ist Director Sales and Business Development Robotics and Machining bei Dassault Systèmes.