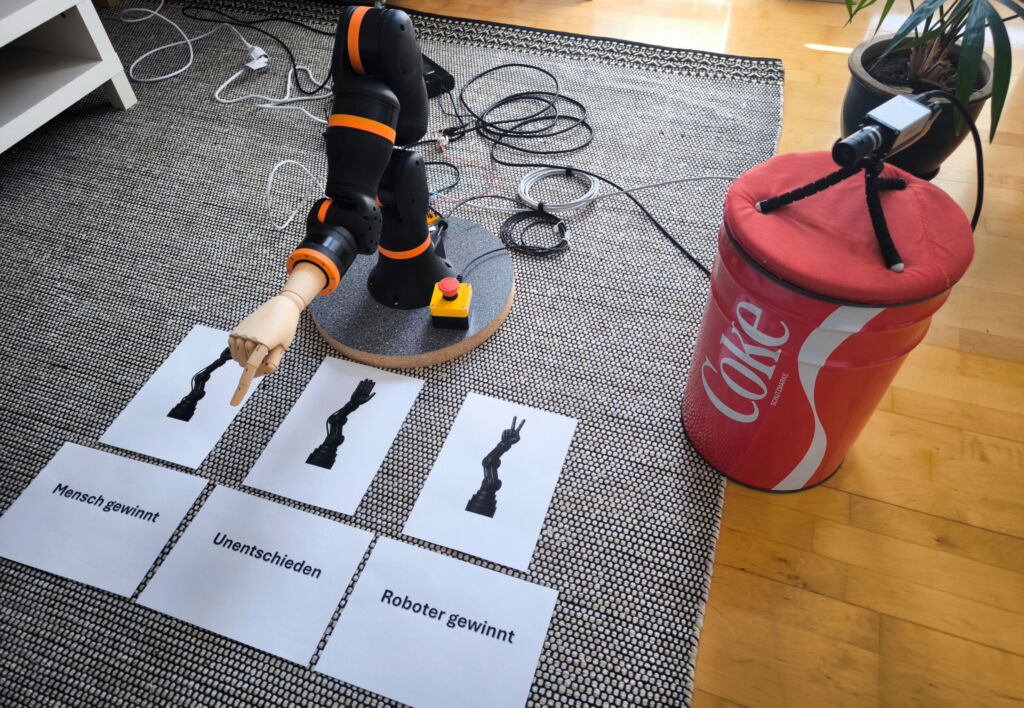

Die Spielrunde verläuft in fünf Phasen: Erfassung der menschlichen Hand durch die Kamera, KI-basierte Bildauswertung, Roboterkommunikation und -bewegung, Ermittlung des Ergebnisses, Roboterkommunikation und -bewegung. – Bilder: ©Sebastian Trella

Auf der Suche nach der geeigneten Kamera stieß Blogger Sebastian Trella auf IDS NXT, ein Komplettsystem für den Einsatz von intelligenter Bildverarbeitung. Die Auswertung der Aufnahmen sowie die Kommunikation der Ergebnisse erfolgen hier direkt auf der bzw. durch die Kamera, ohne zusätzlichen PC. Das IDS NXT Experience Kit brachte außerdem bereits alle Komponenten mit, um sofort und ohne KI-Vorkenntnisse mit der Anwendung starten zu können.

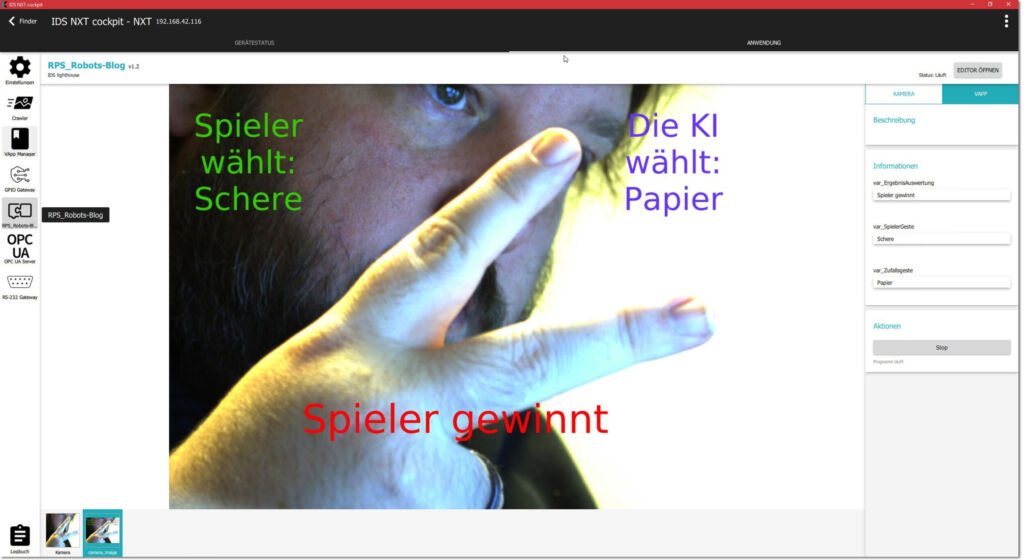

Trella spann den Gedanken weiter und entwickelte einen Roboter, der das Spiel ‚Schere, Stein, Papier‘ spielen sollte: Der (menschliche) Spieler wird aufgefordert, eine der Gesten vor der Kamera auszuführen. Der virtuelle Gegner hat zu diesem Zeitpunkt seine Geste schon zufällig bestimmt. Der Spielzug wird in Echtzeit ausgewertet und der Gewinner angezeigt.

Gestenerkennung mittels Bildverarbeitung

Trella begann mit der Umsetzung der Gestenerkennung mittels Bildverarbeitung. Mithilfe eines cloudbasierten KI-Vision-Studios (IDS Lighthouse) ließ sich das einfach realisieren. Neuronale Netze werden durch Anwendungsbilder mit dem notwendigen Wissen trainiert und in einen passenden Anwendungsablauf verpackt. Das funktioniert mit einer Erkennungsrate von ca. 95 Prozent.

Weiterverarbeitung der ausgewerteten Bilddaten

Die Weiterverarbeitung der erkannten Gesten erfolgt mittels einer eigens erstellten Vision App. Die App bildet die zweite Phase des Projekts und soll das Spielen gegen einen simulierten Computergegner ermöglichen. Sie baut auf der trainierten KI auf und verwendet deren Ergebnisse weiter. Dabei stellt sie den KI-Gegenspieler, der zufällig eine der drei vorgegebenen Handbewegungen ausgibt und vergleicht diese mit der des Spielers. Anschließend entscheidet sie, wer gewonnen hat oder, ob es ein Unentschieden-Ergebnis gibt. Die Vision App ist die Schnittstelle zum Spieler auf dem Computermonitor, die Kamera die Schnittstelle zum Erfassen der Spielergesten. Die Kamera erkennt präzise die Handzeichen, die Entscheidungslogik reagiert regelkonform und der Roboter setzt die entsprechende Bewegung um.

Feinjustierung: Robuste Gestenkennung

Mithilfe der Trainingsplattform, ließ sich das Modell problemlos erweitern. Neue Bilder wurden hinzugefügt, darunter Hände anderer Personen vor verschiedenen Hintergründen und unter wechselnden Lichtverhältnissen. Auch Details wie unterschiedliche Hauttöne oder Ringe flossen in das Training ein. Durch die gezielte Diversifizierung der Trainingsdaten verbesserte sich die Erkennungsleistung: Die KI reagierte nun stabil und zuverlässig, unabhängig davon, wer spielte oder in welcher Umgebung.

Wie spielt der Roboter?

Die Entscheidungen des Roboters sind zufällig. Er blufft nicht und er lernt nicht aus vorherigen Spielen. Doch genau das macht den Charme des Spiels aus: Mensch gegen Maschine, auf Augenhöhe.

![Die [me] - mechatronik & engineering wird digital 22 Die [me] – mechatronik & engineering wird digital](https://cdn.tedo.be/tedo-mu/wp_uploads/sites/20/2026/03/Unbenannt.jpeg)