Automatischer Koordinatenabgleich von Cobot und Vision-Sensor

Koordinatenfinder

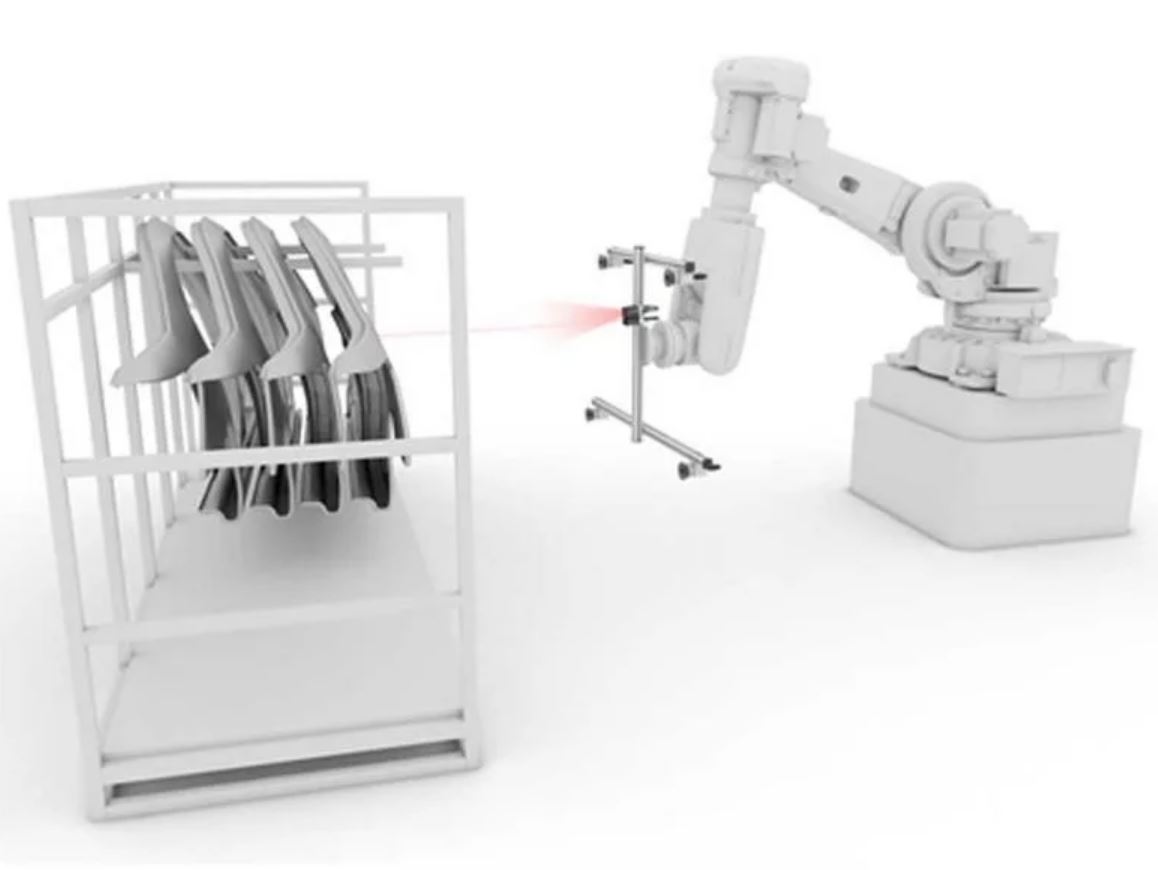

Die Ermittlung der Koordinatentransformation eines Vision-Sensors an einem Roboter wurde bisher als Hand/Auge-Kalibrierung durch das manuelle Positionieren des Cobots auf einem speziellen Kalibriertarget gelöst. Mit SmartGrid ermöglicht Baumer jetzt für die VeriSens-Vision-Sensoren eine automatische Kalibrierung.

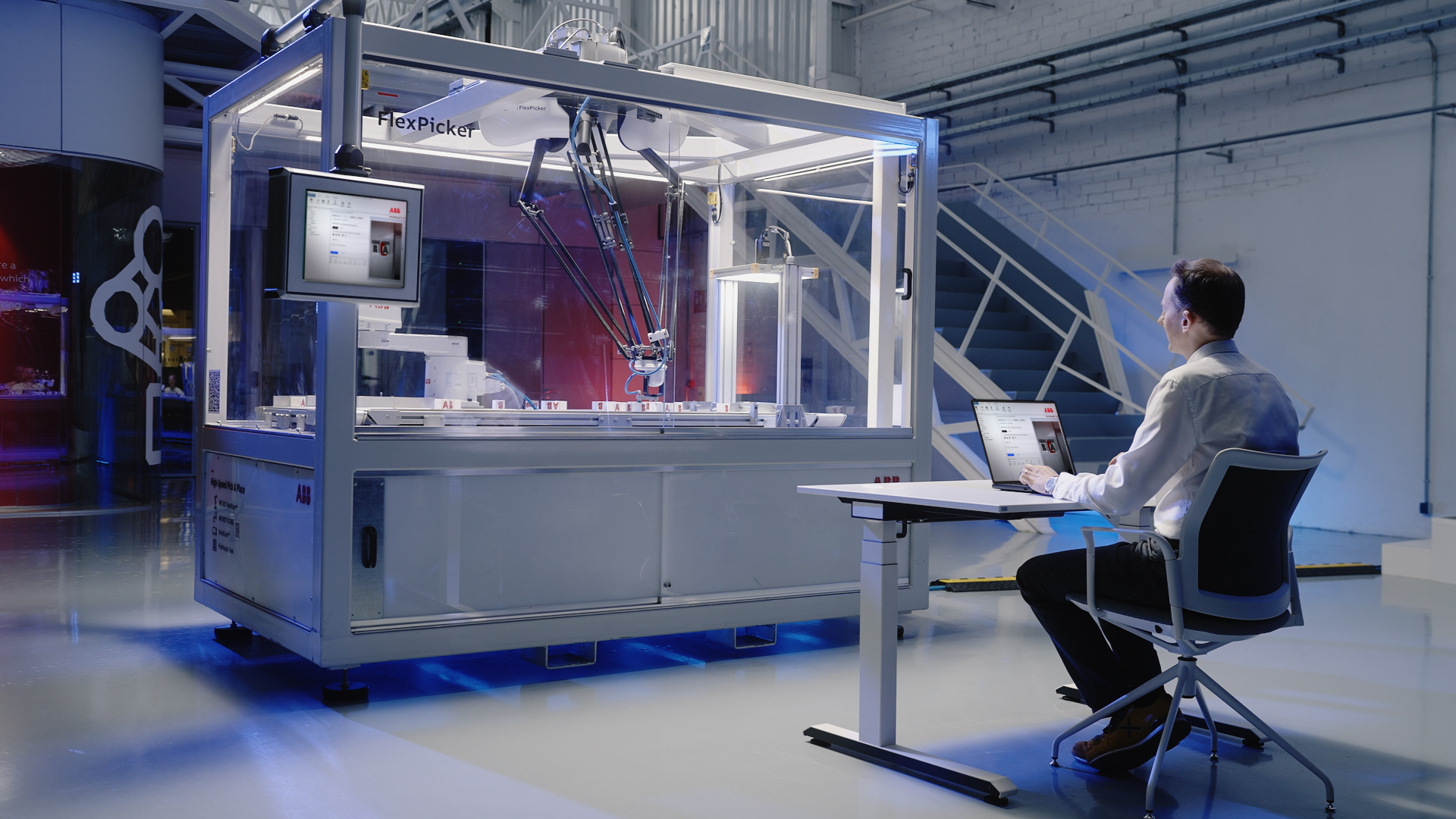

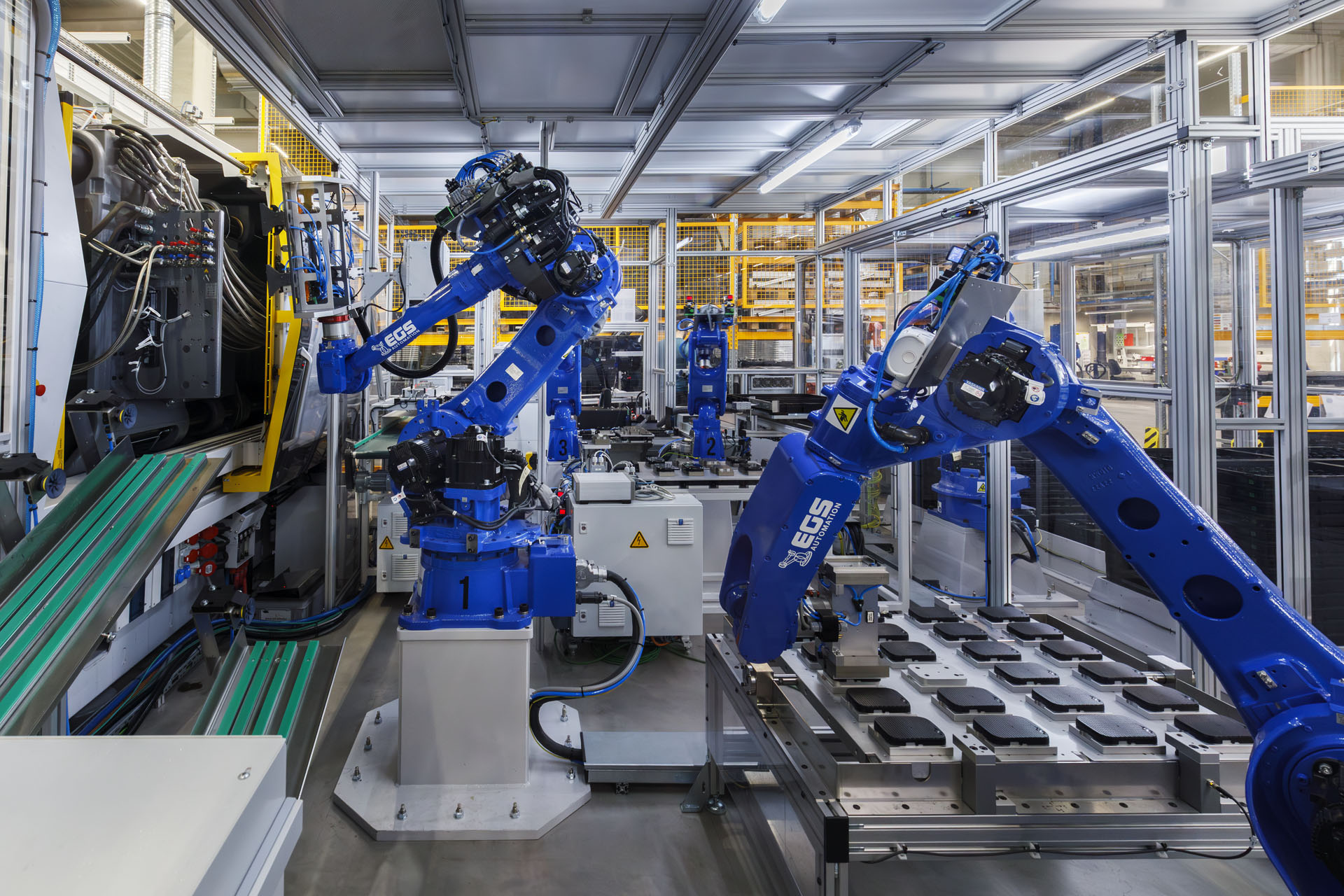

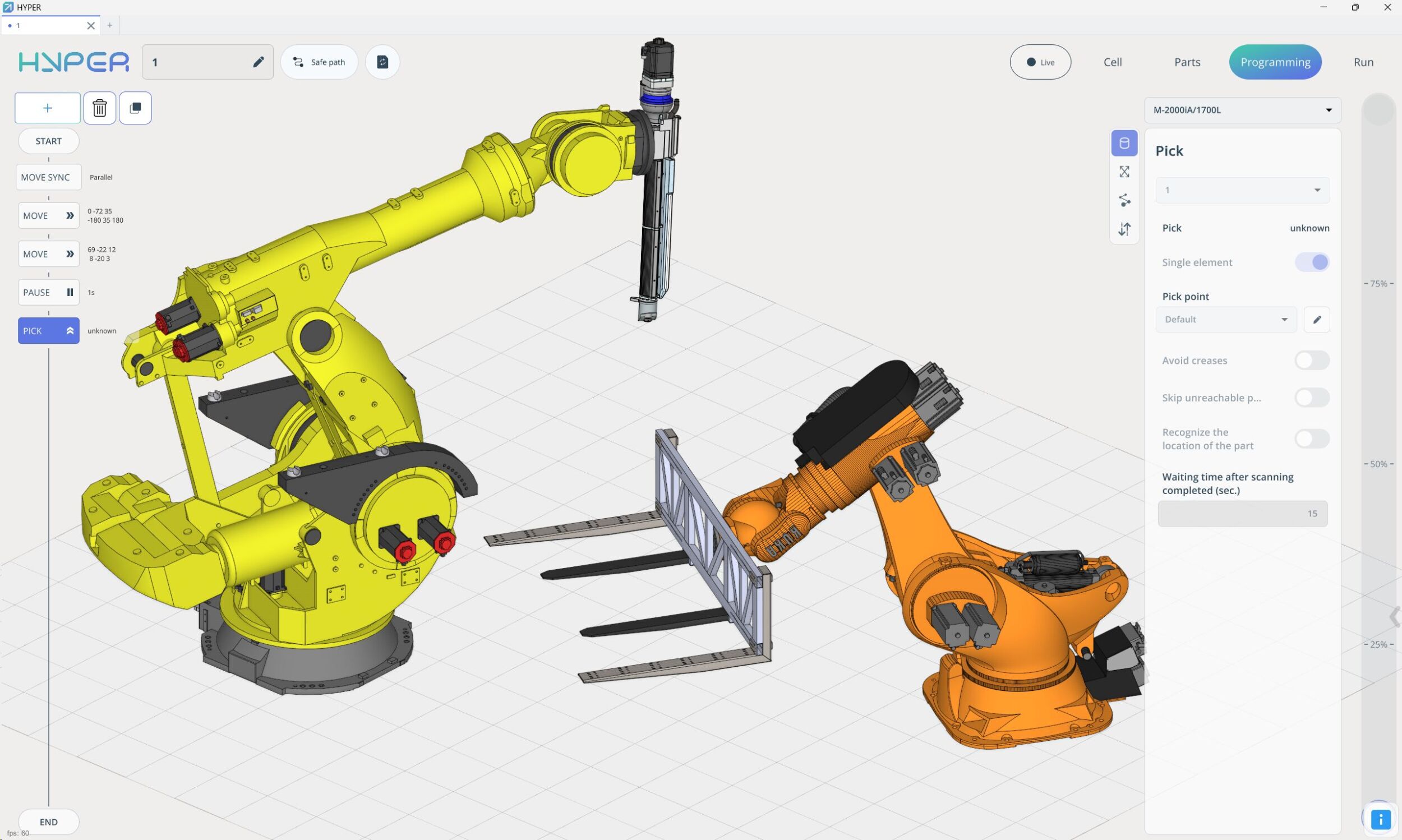

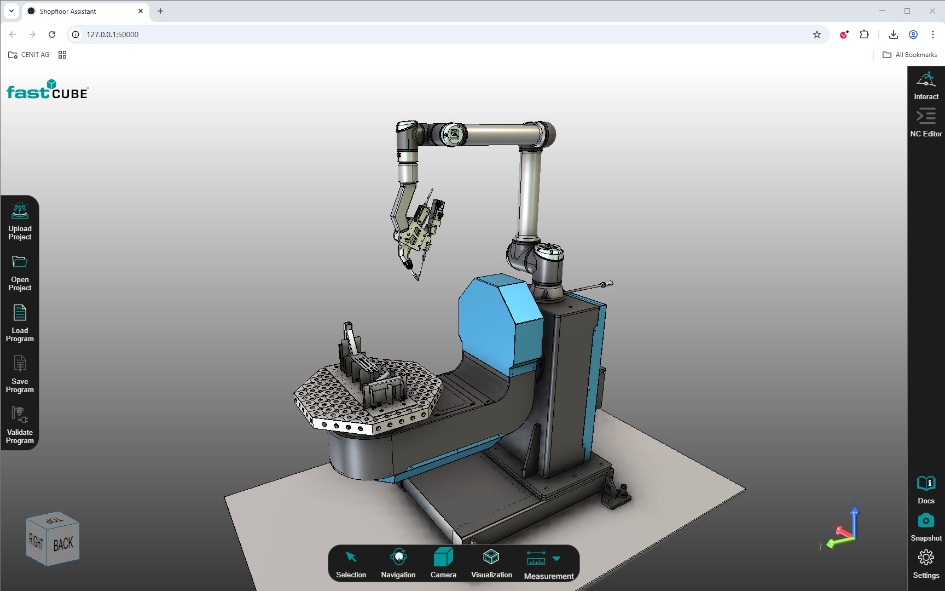

Ähnlich der von Smartphones bekannten Apps nutzt Universal Robots für zertifiziertes Zubehör sogenannte Caps: Software-Plug-ins, die Anbauten wie einen VeriSens-Vision-Sensor in der Programmierumgebung PolyScope nutzbar machen. Die Bildverarbeitungsaufgabe selbst wird komplett über die VeriSens Application Suite parametriert – unabhängig vom Cobot in der dafür am besten geeigneten Umgebung. Die Funktionen des VeriSens-URCaps sind generisch und adressieren alle denkbaren Applikationen einschließlich mitgeführter oder stationärer Anordnung des Vision-Sensors. Neben der im URCap abgebildeten Routine zur Installation werden für die Programmierung des UR-Roboters lediglich zwei zusätzliche Knoten (Kommandos) benötigt, mit denen die Bildverarbeitung Eingang in die Roboterprogrammierung findet. Für die Objektidentifizierung oder Qualitätskontrolle genügt bereits ein einziger Knoten, um im Roboterprogramm einen Bildverarbeitungsjob auf dem Vision-Sensor auszulösen und die Ergebnisse als Variable im Programmablauf zur Entscheidungsfindung bereitzustellen. Damit kann der Cobot bereits Objekte sortieren. Für das bildbasierte Greifen kommt ein zweiter Knoten hinzu, der die festen Wegpunkte durch dynamische, bildbasierte ergänzt. Automatisierte Fertigungsanlagen stellen höchste Anforderungen an Sicherheit, Taktleistung und Integration. Erfahren Sie in diesem Whitepaper, wie Maschinenschutztore normgerecht geplant und effizient in automatisierte Anlagen integriert werden. ‣ weiterlesen

Whitepaper

Maschinenschutztore in Anlagen integrieren

Automatische Kalibrierung

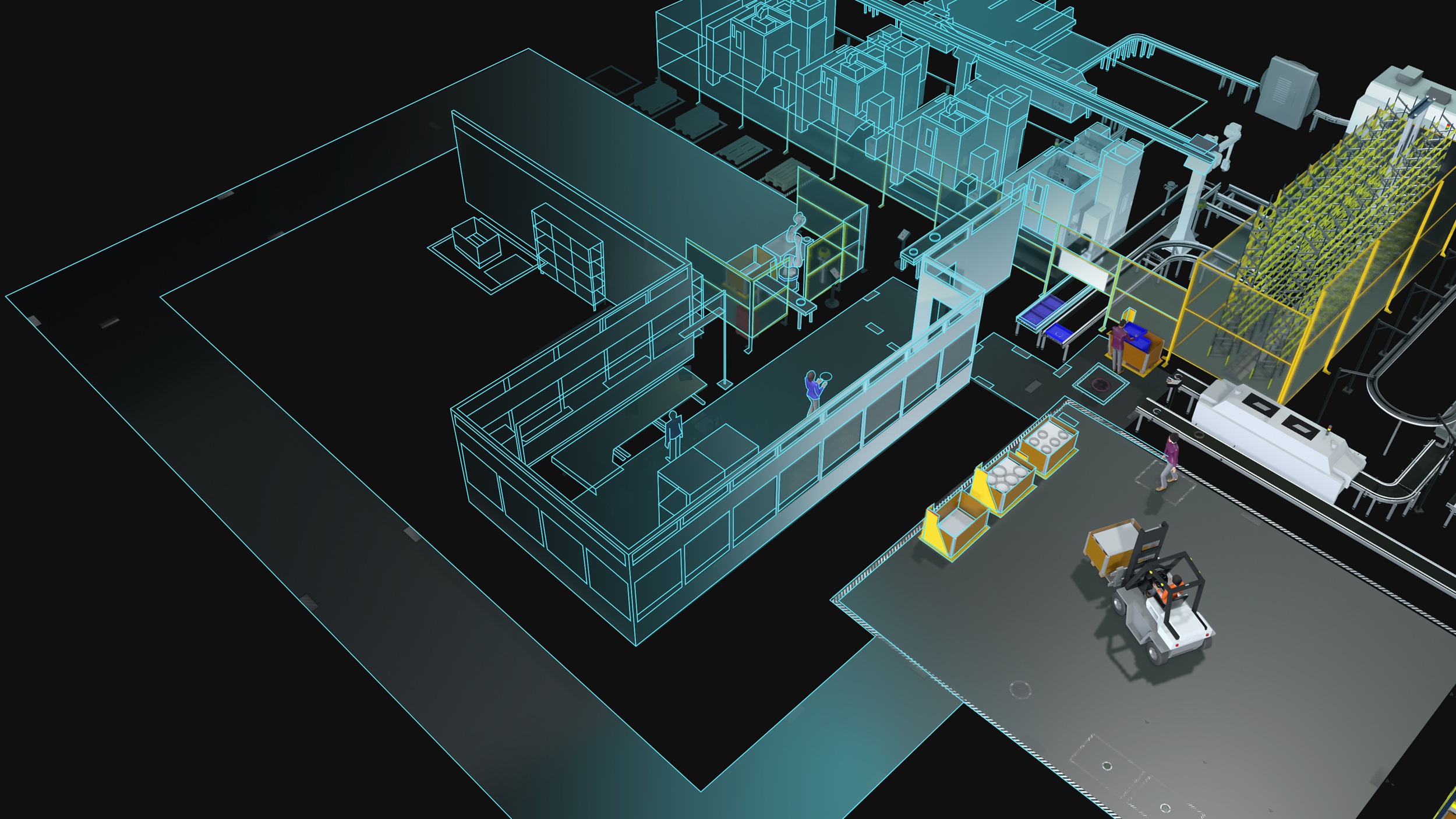

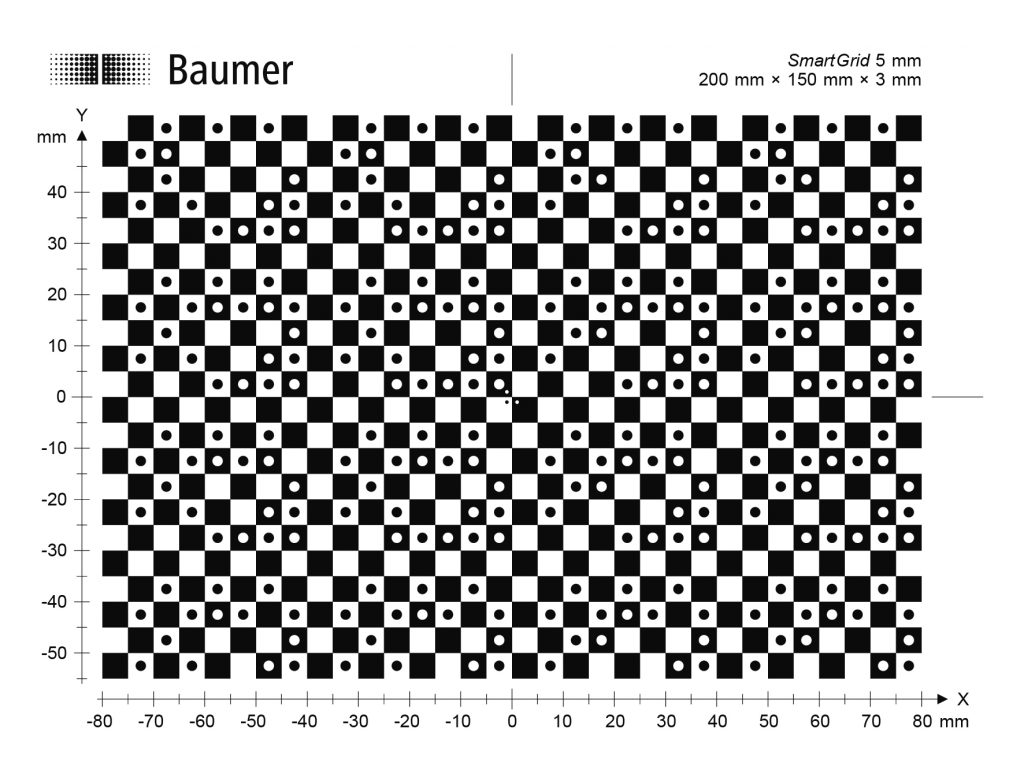

Roboter und Vision-Sensor arbeiten in eigenen Koordinatensystemen. Die Koordinaten des Vision-Sensors müssen umgerechnet werden, um dem Roboterkoordinatensystem zu entsprechen. Die Ermittlung der notwendigen Koordinatentransformation wurde bisher als Hand/Auge-Kalibrierung durch das mehrfache manuelle Positionieren des Cobots mit einer Tastspitze auf einem speziellen Kalibriertarget gelöst. In vielen Einzelschritten wird so eine vom Hersteller vorgegebene Prozedur durchlaufen. Das ist mühsam und durch den händischen Eingriff auch ungenau und fehleranfällig. Mit dem SmartGrid geht Baumer für seine VeriSens-Vision-Sensoren den neuen Weg einer automatischen Kalibrierung. Der Clou liegt im intelligenten Bitmuster, das sich im üblichen Schachbrettformat versteckt. Es liefert wertvolle Zusatzinformationen, die der Vision-Sensor lesen kann. Eine dieser Informationen ist die Position des Sensors über dem Muster. Da der Cobot seine Koordinaten immer kennt, genügen wenige Linear- und Rotationsbewegungen, um die Koordinatensysteme automatisch miteinander abzugleichen. Diese Prozedur ist nicht nur sehr genau und frei von manuellen Fehlern, sie ist auch einfach am Touchscreen des Cobots durchführbar.

Bilder in Echtzeit entzerren

Das Finden von Objekten ist aus Sicht der Koordinaten gelöst. Per SmartGrid wird jedoch mehr erreicht: Der Vision-Sensor nutzt das Raster, um ein ideales Bild zu lernen und anschließend aufgenommene Bilder in Echtzeit zu entzerren, um unter anderem die Objektivverzeichnung zu korrigieren. Da das Bitmuster auch Daten zur Größe vom jeweilig verwendeten SmartGrid liefert, liegen nun sogar alle Informationen zur Skalierung vor. Eine Umrechnung in Weltkoordinaten ist damit bereits automatisch eingestellt. Das SmartGrid unterstützt zusätzlich eine halbautomatische Z-Kalibrierung, mit der der Vision-Sensor seine Position im Raum lernt. Damit wird eine letzte Herausforderung für Vision Guided Robotics gelöst: Der 2D-Vision-Sensor muss einem 3D-Roboter Daten liefern. Es wäre nicht sehr nutzerfreundlich nur die Koordinaten einer einzigen Ebene, der Bildebene, nutzen zu können. Gerade ein Roboter benötigt auch Koordinaten in anderen Ebenen der Z-Achse, z.B. für den Greiferzugriff oder zur Erkennung wichtiger Markierungen. Durch die Z-Kalibrierung ist die automatische Anpassung der Koordinaten auch in anderen Höhen möglich.