Die Fortschritte auf dem Gebiet der künstlichen Intelligenz haben für den Softwarebereich große Veränderungen mit sich gebracht. So ermöglichen Large Language Models (LLMs) wie ChatGPT oder Llama2 ein beeindruckendes Verständnis und die Erzeugung natürlicher Sprache. Die Verkörperung der realen Welt ist die nächste Stufe für die KI. Eine dialogfähige und intuitive Mensch/Roboter-Interaktion wird das Einsatzspektrum von KI erheblich erweitern. LLMs erzeugen nicht nur kohärenten Text, sondern erstellen auch sogenannte Weltmodelle, die für eine Vielzahl von Aufgaben genutzt werden können. Trotz ständiger Fortschritte ist der Bereich der Robotik durch die traditionellen Trainingsmethoden – Reinforcement Learning (RL) und Imitation Learning (IL) – erheblich eingeschränkt. RL ist ein zeit- und ressourcenaufwändiger Versuch-und-Irrtum-Prozess, der eine enorme Anzahl von Versuchen erfordert, um Aufgaben zu perfektionieren. Andererseits erfordert IL, bei dem ein Roboter durch Beobachtung eines menschlichen Instrukteurs lernt, ein umfangreiches, von Menschen geführtes Training.

Einfache Interaktion mit Robotern

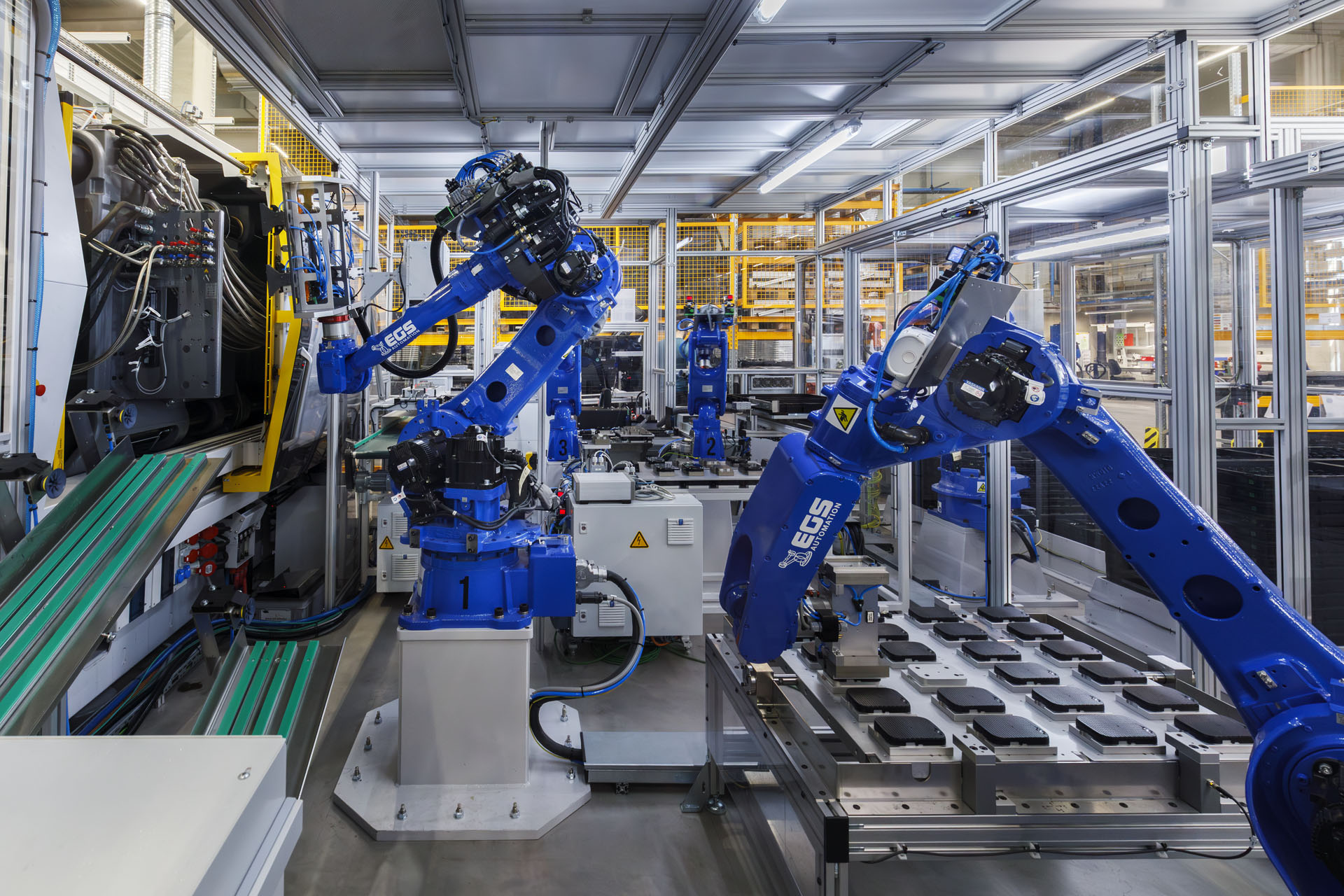

Herkömmliche Lernmethoden für Roboter sind nur schwer in der Lage, Aufgaben effizient auszuführen, die ein hohes Maß an Anpassungsfähigkeit erfordern, z. B. das Lernen aus dem Stand, langfristige Planung oder die Fähigkeit, mit neuartigen Situationen umzugehen. Diese Fähigkeiten sind für den Einsatz von Robotern in dynamischen Umgebungen aber von entscheidender Bedeutung – schließlich können sich die Positionen von Objekten ändern und neue Objekte hinzukommen. Es besteht also ein dringender Bedarf an neuen Methoden, die eine effizientere und anpassungsfähigere Entwicklung autonomer Roboter ermöglichen.

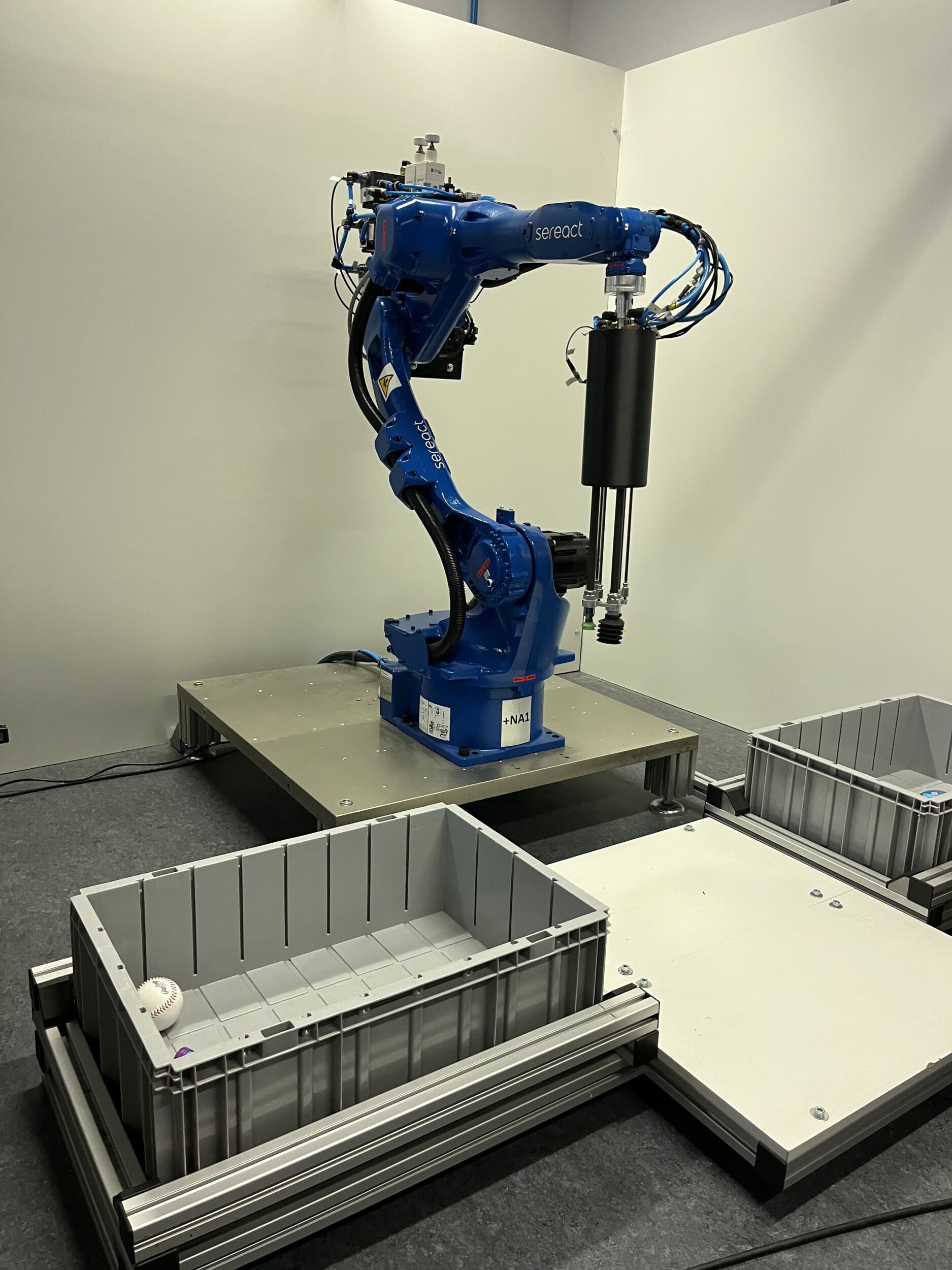

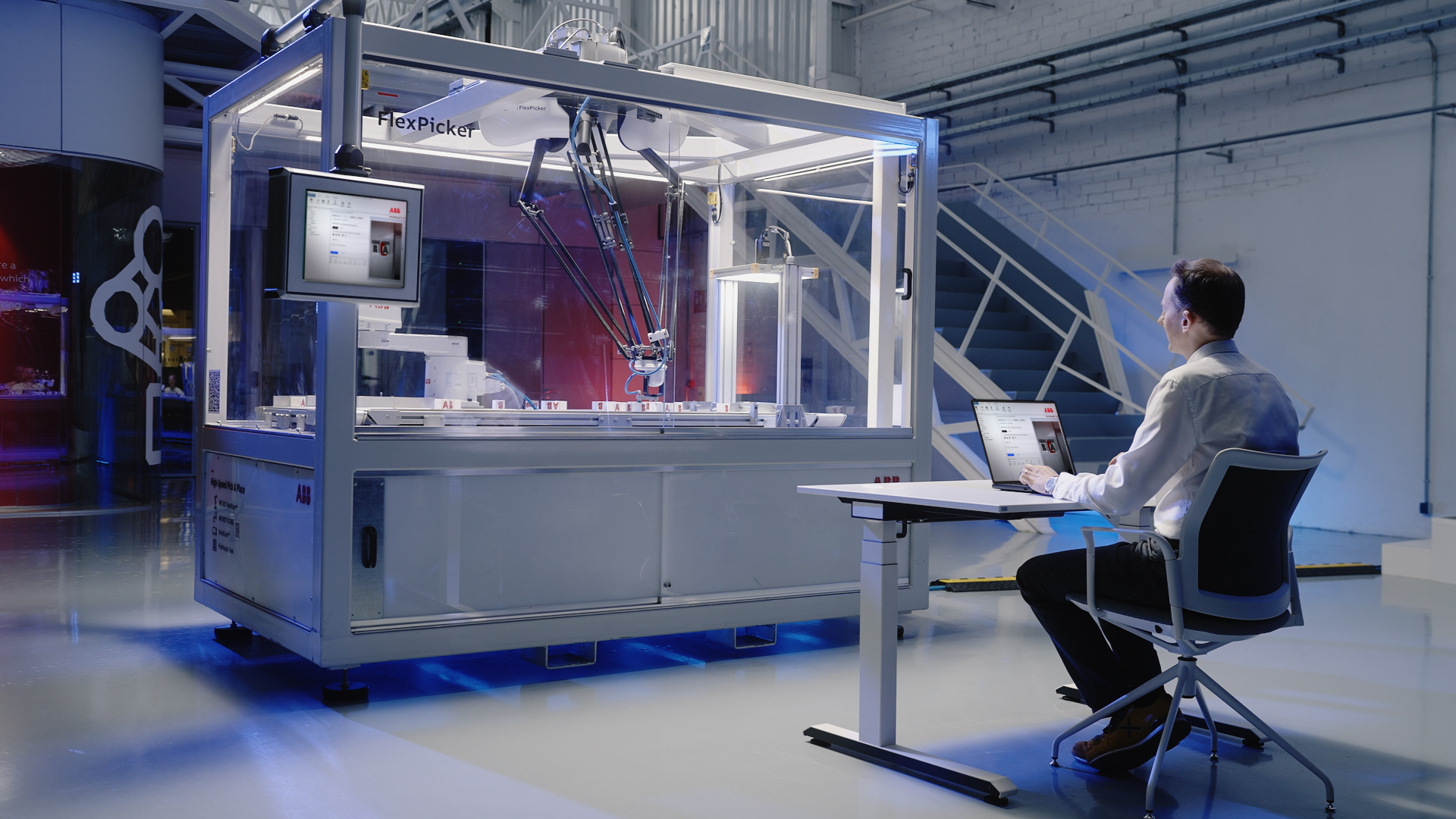

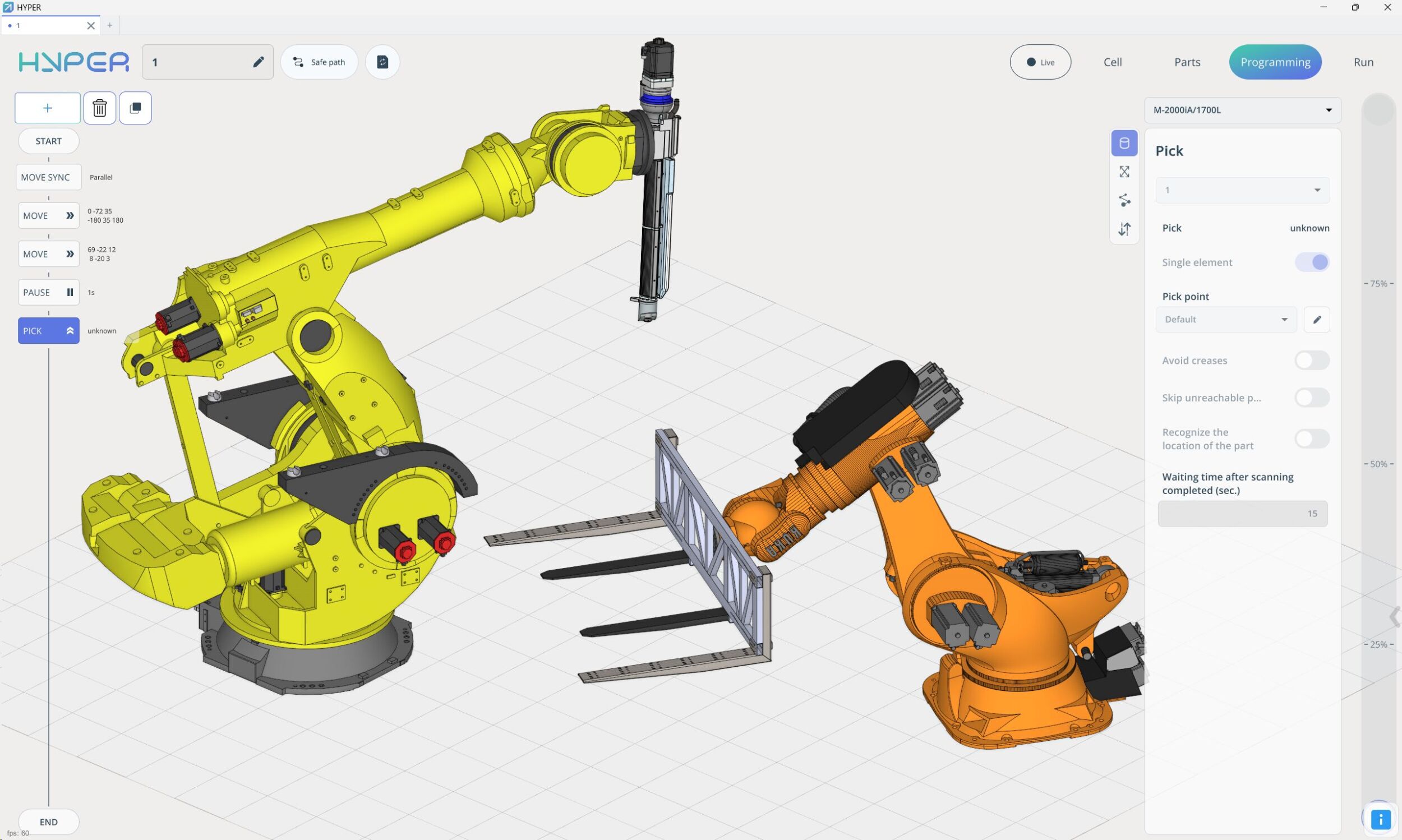

An dieser Stelle kommt PickGPT als Tool zur Instruktion und Programmierung von Robotern ins Spiel. Es erlaubt den Nutzern, Roboter ausschließlich per Sprache zu steuern, und legt den Schwerpunkt auf Einfachheit und Benutzerfreundlichkeit. Die Nutzung eines LLMs, das auf der Grundlage großer Mengen von Textdaten trainiert wurde, erleichtert nicht nur die Interaktion, sondern erlaubt auch komplexe Schlussfolgerungen und Planungen. Es ermöglicht dem Roboter zu verstehen, was der Benutzer will, wie es mit seinen visuellen Eingaben zusammenhängt und wie er handeln soll. Wenn man ihn beispielsweise bittet, eine Bestellung zu verpacken, erkennt er nicht nur die Gegenstände, wählt sie aus und legt sie in eine Box, sondern berücksichtigt auch die physikalischen Eigenschaften der Gegenstände, ohne dass er ausdrücklich dazu aufgefordert wird. Dieses Maß an komplexem Denken wurde nur durch den Einsatz großer Bildverarbeitungs- und Sprachmodelle möglich, die zuvor auf das Verständnis der realen Welt trainiert worden sind. Automatisierte Fertigungsanlagen stellen höchste Anforderungen an Sicherheit, Taktleistung und Integration. Erfahren Sie in diesem Whitepaper, wie Maschinenschutztore normgerecht geplant und effizient in automatisierte Anlagen integriert werden. ‣ weiterlesen

Whitepaper

Maschinenschutztore in Anlagen integrieren

Im Gegensatz zu traditionellen Modellen verwendet PickGPT eine Zero-Shot-Planung. Dadurch ist das Tool in der Lage, selbst in komplexen, dynamischen und unstrukturierten Umgebungen ohne vorheriges spezifisches Training Handlungssequenzen zu berechnen und auszuführen, um einen Zielzustand zu erreichen. PickGPT ist daher gut geeignet für die Einrichtung von Robotern in Umgebungen wie Lagern, in denen das Kommissionieren, Platzieren, Sortieren und Anpassen an Veränderungen zu den wichtigsten Anforderungen gehören.

Greifen von unbekannten Objekten

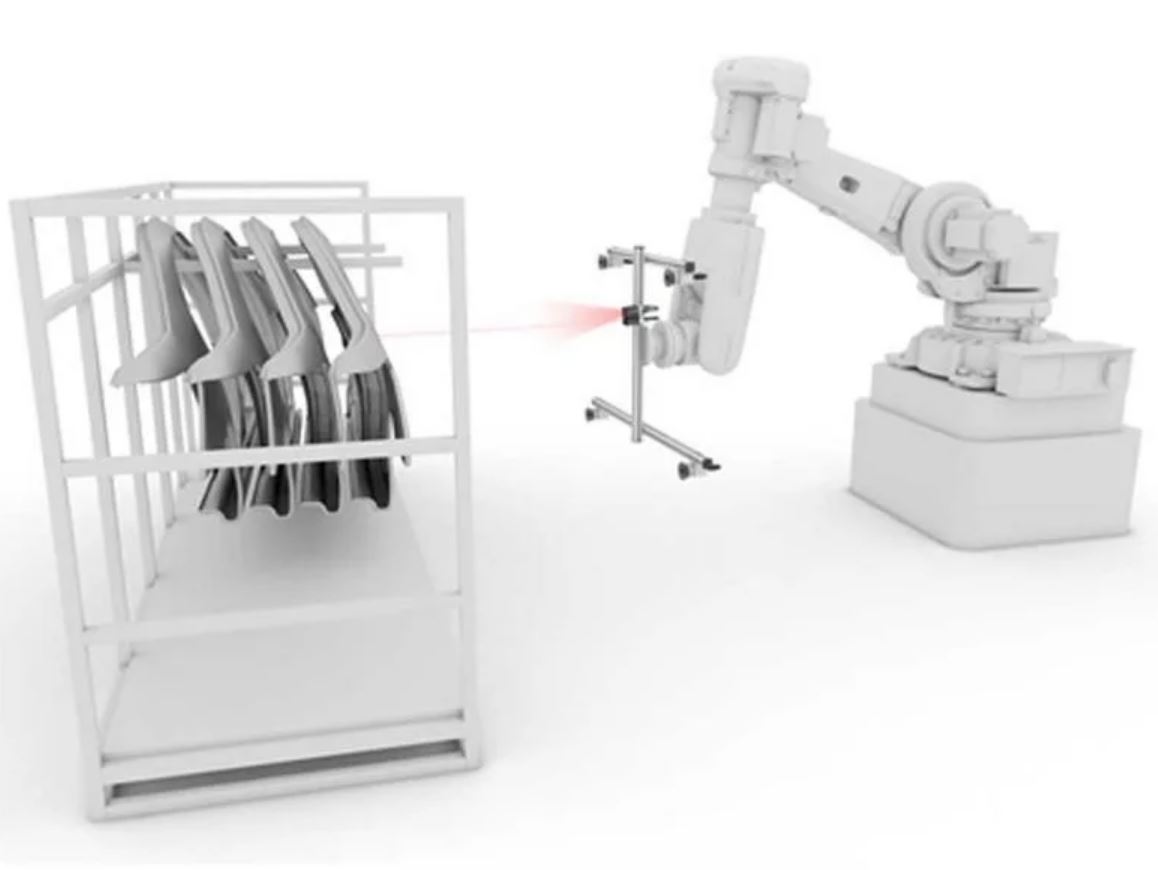

Der Einsatz von großen Bild- und Sprachmodellen, die auf Web-scale-Datensätzen trainiert wurden, ermöglicht auch die Generalisierung auf neue und bisher ungesehene Objekte. Vor diesem Ansatz war es notwendig, Repräsentationen für alle Objekte zu erstellen, mit denen der Roboter zum Testzeitpunkt interagieren konnte, was seine Anpassungsfähigkeit stark einschränkte. Durch Wissenstransfer kann PickGPT zusätzlich zu den synthetischen und realen Robotikdaten, denen es ausgesetzt war, eine ‚offene Menge‘ von Objekten erkennen und erfassen. Es ist in der Lage, jedes Objekt in einem Bild zu lokalisieren – ein Prozess, der als ‚visuelles Grounding‘ bekannt ist. Ermöglicht wird dies durch einen Cross-Attention-Mechanismus, der Bildausschnitte und Textkonzepte miteinander verbindet – eine Kernkomponente der Transformer-Architektur, die das Repräsentationslernen verbessert. Im Fall von PickGPT ermöglicht dieser Mechanismus auch die nahtlose Einbeziehung zusätzlicher Sensordaten, z.B. der Tiefe, um die Position des Objekts für das Greifen genauer vorherzusagen.

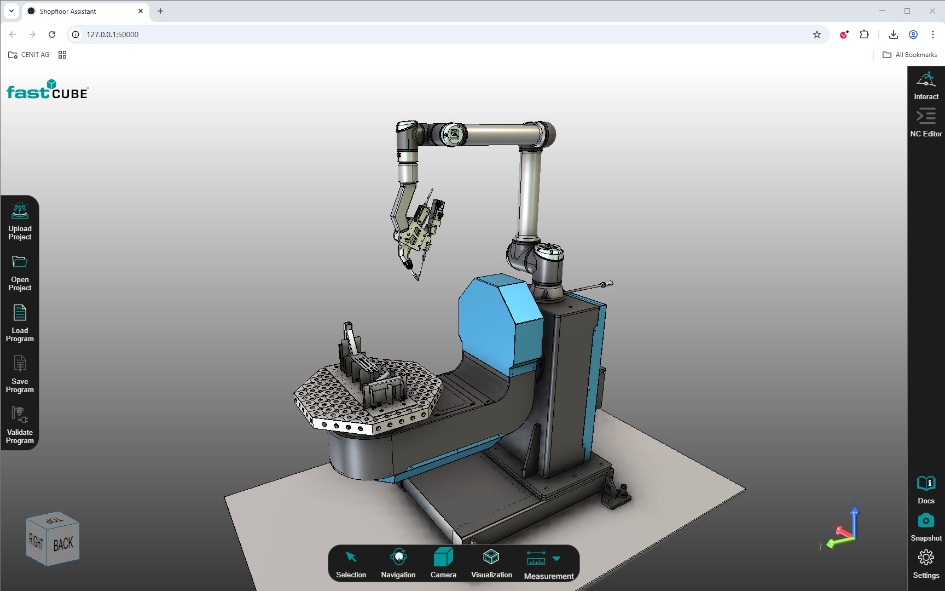

PickGPT fusioniert multimodale Sensordaten (RGB, Tiefe und andere) und speist sie in ein Large Language Model ein, kombiniert mit Anweisungen in natürlicher Sprache eines menschlichen Bedieners oder eines übergeordneten Systems. Die Sensordaten werden zunächst in Felder fester Größe aufgeteilt und linear und positionsbezogen eingebettet. Die resultierende Sequenz wird dann in einen Vision Transformer (ViT) eingespeist, der verschiedene Aufgaben wie Segmentierung, Szenenzerlegung und Sequenzierung durchführt. Der ViT wandelt diese anschließend in eine Token-Darstellung um. Das LLM nimmt zunächst eine Tokenisierung und Einbettung des Eingabetextes vor und wandelt ihn in numerische Repräsentationen um. Diese Einbettungen werden von einer Transformer-Architektur verarbeitet, die die kontextuelle Bedeutung jedes Worts gewichtet und dem Modell hilft, die Gesamtbedeutung zu verstehen.

Auf der Grundlage dieses Verständnisses erzeugt das Modell Antworten, indem es kontinuierlich das nächste Wort in der Sequenz vorhersagt, bis eine bestimmte Bedingung erfüllt ist. Die generative Ausgabe von PickGPT ist ein Text, der entweder direkt Aufgaben lösen oder Low-Level-Befehle für geometrische Planungs- oder Steuerungsaufgaben anleiten kann. Eingebettet in einen Regelkreis kann PickGPT Entscheidungen eines Roboters ausführen und Pläne auf der Grundlage neuer Beobachtungen anpassen, indem es als High-Level-Policy fungiert, die die Low-Level-Policy sequenziert und steuert. Darüber hinaus enthält PickGPT ausfallsichere Strategien, um unvorhergesehene Situationen zu bewältigen, was seine Zuverlässigkeit und Effektivität erhöht. Wenn z.B. der erste Versuch, ein Objekt zu greifen, fehlschlägt, gibt das Modell nicht einfach auf. Stattdessen ist es so konzipiert, dass es die Situation neu bewertet, seine Strategie anpasst und es erneut versucht. Diese eingebaute Widerstandsfähigkeit und Flexibilität stellt sicher, dass der Roboter effektiv navigieren sowie auf unerwartete Ereignisse oder Veränderungen in der Umgebung reagieren kann und seine betriebliche Effizienz beibehält.